💡

原文英文,约600词,阅读约需3分钟。

📝

内容提要

数据工程团队面临快速交付高质量数据的压力,但构建和操作数据管道变得更加困难。数据工程师大多时间用于处理工具的操作负担,而非编写代码。现有框架需要手动处理数据处理、质量和回填等任务,导致数据工程成为瓶颈。Spark声明式管道(SDP)通过声明整个管道,简化数据处理,提高生产力和成本效益,降低操作负担。

🎯

关键要点

- 数据工程团队面临快速交付高质量数据的压力,构建和操作数据管道变得更加困难。

- 数据工程师大部分时间用于处理工具的操作负担,而非编写代码。

- 现有框架需要手动处理数据处理、质量和回填等任务,导致数据工程成为瓶颈。

- Spark声明式管道(SDP)通过声明整个管道,简化数据处理,提高生产力和成本效益。

- SQL使得单个查询变得声明式,但数据工程需要处理多个相互依赖的数据集。

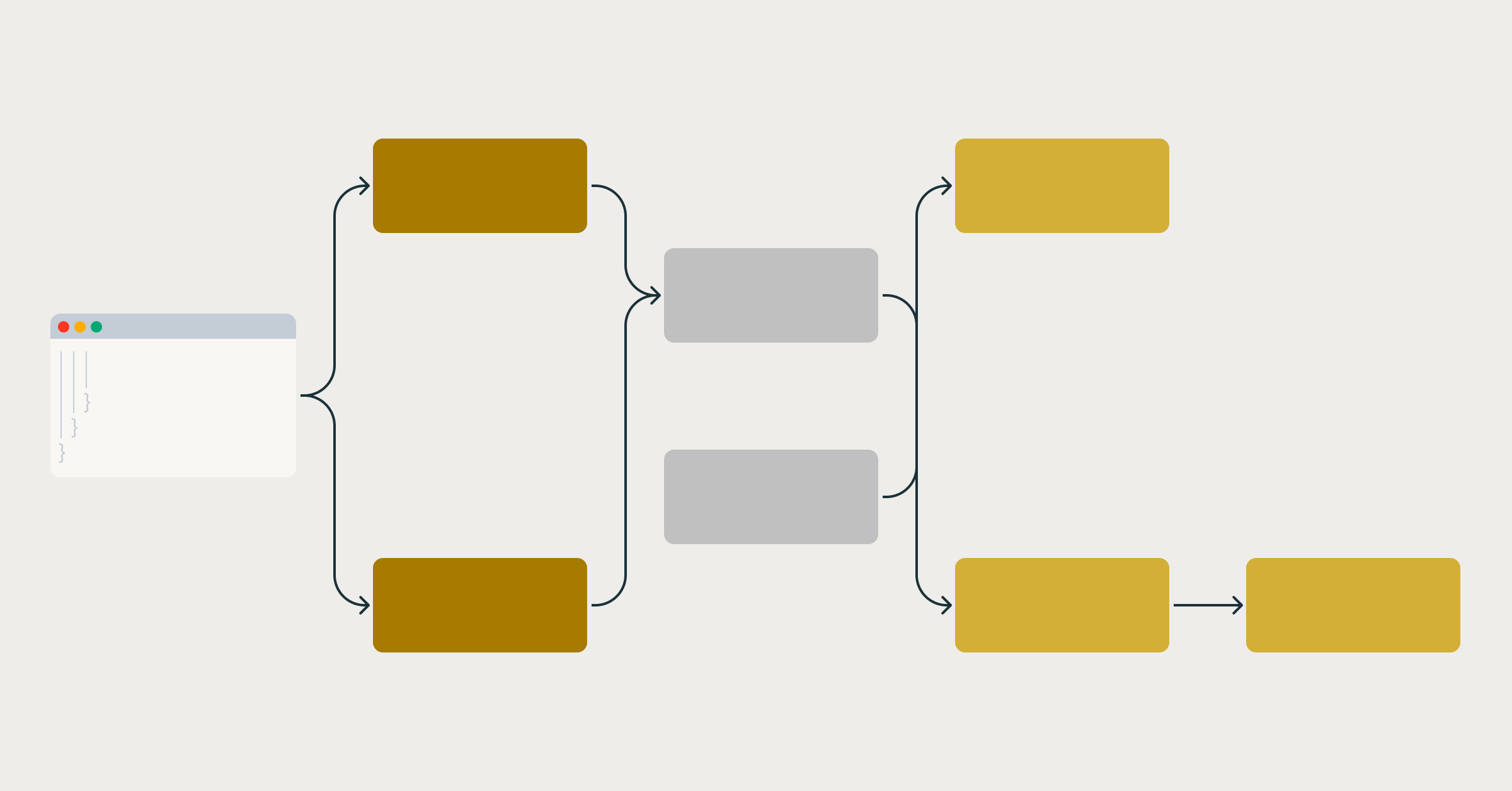

- SDP扩展了声明式数据处理,允许Apache Spark端到端地规划和执行管道。

- SDP自动处理新数据或变更数据,表达数据质量规则,并处理回填和延迟数据。

- SDP带来更高的生产力,数据工程师可以专注于编写业务逻辑。

- SDP降低了成本,自动处理编排和增量数据处理。

- SDP降低了操作负担,常见用例如回填、数据质量和重试被集成和自动化。

- 通过SDP重写管道可以探索其优势,简化执行顺序、增量处理和数据质量逻辑。

➡️