💡

原文中文,约2800字,阅读约需7分钟。

📝

内容提要

本文介绍了Intel针对卷积神经网络(CNN)的int8量化方案,旨在优化计算性能。该方案通过将浮点数转换为int8,提升卷积操作速度。主要方法包括直接转换、基于数据校准和训练微调。TensorRT采用线性量化,简化计算过程并使用CUDA加速。量化的关键在于确定缩放因子,以减少信息损失,确保量化前后的数据分布尽可能接近。

🎯

关键要点

- Intel针对卷积神经网络(CNN)提出了int8量化方案,以优化计算性能。

- 该方案通过将浮点数转换为int8,提升卷积操作速度,特别是在TensorRT中实现。

- 量化过程包括权重编码、输入编码、卷积操作和输出反编码,int8卷积性能优于fp32卷积。

- 量化方法主要有三种:直接转换、基于数据校准和基于训练微调,后两种方法能提高精度。

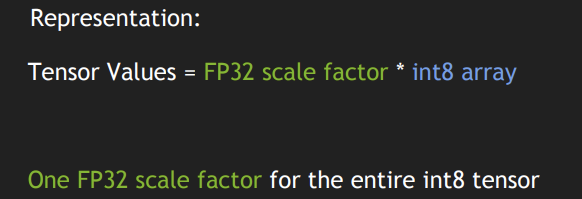

- TensorRT采用线性量化方案,使用单一缩放因子简化计算过程。

- 确定缩放因子是量化的关键,使用校准数据集和搜索算法来最小化信息损失。

- 通过KL散度衡量量化前后数据分布的接近程度,以确保量化效果。

❓

延伸问答

什么是TensorRT中的int8量化?

TensorRT中的int8量化是将浮点数转换为int8,以优化卷积神经网络的计算性能,提升卷积操作速度。

int8量化的主要方法有哪些?

int8量化的主要方法有直接转换、基于数据校准和基于训练微调。

如何确定int8量化中的缩放因子?

缩放因子通过校准数据集和搜索算法来确定,以最小化量化前后的信息损失。

为什么int8卷积性能优于fp32卷积?

int8卷积性能优于fp32卷积,因为int8计算速度更快,能够在抵消数据转换开销后仍然获得性能收益。

TensorRT是如何加速int8卷积操作的?

TensorRT通过使用CUDA的dp4a API来加速int8卷积操作,提高计算效率。

在实际工程中,如何选择量化方法?

在实际工程中,通常首先使用基于数据校准的方法,如果效果不理想,再尝试基于训练微调的方法。

➡️