💡

原文英文,约900词,阅读约需4分钟。

📝

内容提要

NVIDIA在最新的MLPerf基准测试中表现出色,GH200 Grace Hopper超级芯片在所有数据中心推理测试中表现出色,而HGX H100系统在每个MLPerf推理测试中提供了最高的吞吐量。NVIDIA还宣布了TensorRT-LLM,这是一个优化生成AI软件推理的开源库,以及L4 GPU,可在各方面提供出色的性能。NVIDIA的Jetson Orin系统模块在物体检测方面表现出84%的性能提升。MLPerf基准测试透明客观,有70多个组织支持。NVIDIA基准测试中使用的所有软件都可以从MLPerf存储库中获取。

🎯

关键要点

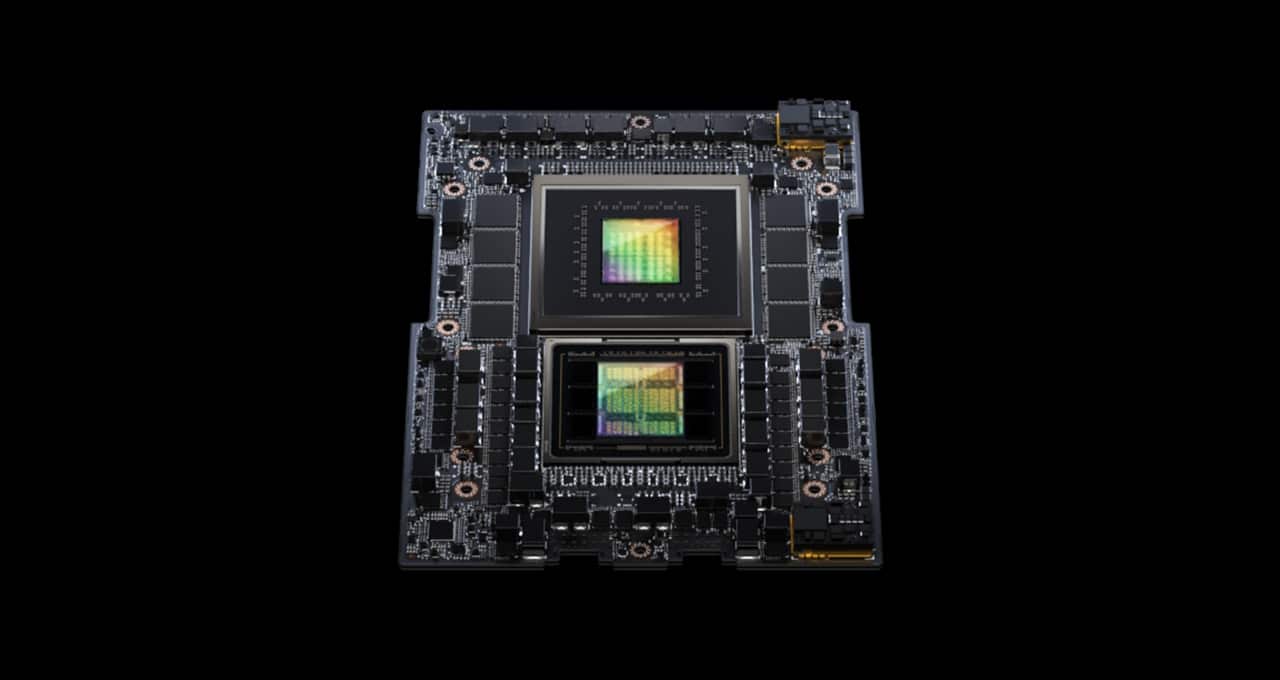

- NVIDIA GH200 Grace Hopper超级芯片在MLPerf基准测试中表现出色,扩展了NVIDIA H100 Tensor Core GPU的领先性能。

- GH200超级芯片结合了Hopper GPU和Grace CPU,提供更多内存和带宽,并能自动调整CPU和GPU之间的功率。

- NVIDIA HGX H100系统在每个MLPerf推理测试中提供了最高的吞吐量,涵盖计算机视觉、语音识别和医疗成像等多个领域。

- NVIDIA推出了TensorRT-LLM,这是一个优化生成AI推理的开源库,能将H100 GPU的推理性能提高一倍以上。

- L4 GPU在最新的MLPerf基准测试中表现出色,提供了比功耗更高的CPU高出6倍的性能。

- NVIDIA Jetson Orin系统模块在物体检测方面表现出84%的性能提升,展示了边缘计算的领导地位。

- MLPerf基准测试透明客观,得到70多个组织的支持,用户可以依赖其结果做出明智的购买决策。

- NVIDIA基准测试中使用的所有软件均可从MLPerf存储库中获取,确保用户能够获得同样的世界级结果。

➡️