💡

原文英文,约2500词,阅读约需9分钟。

📝

内容提要

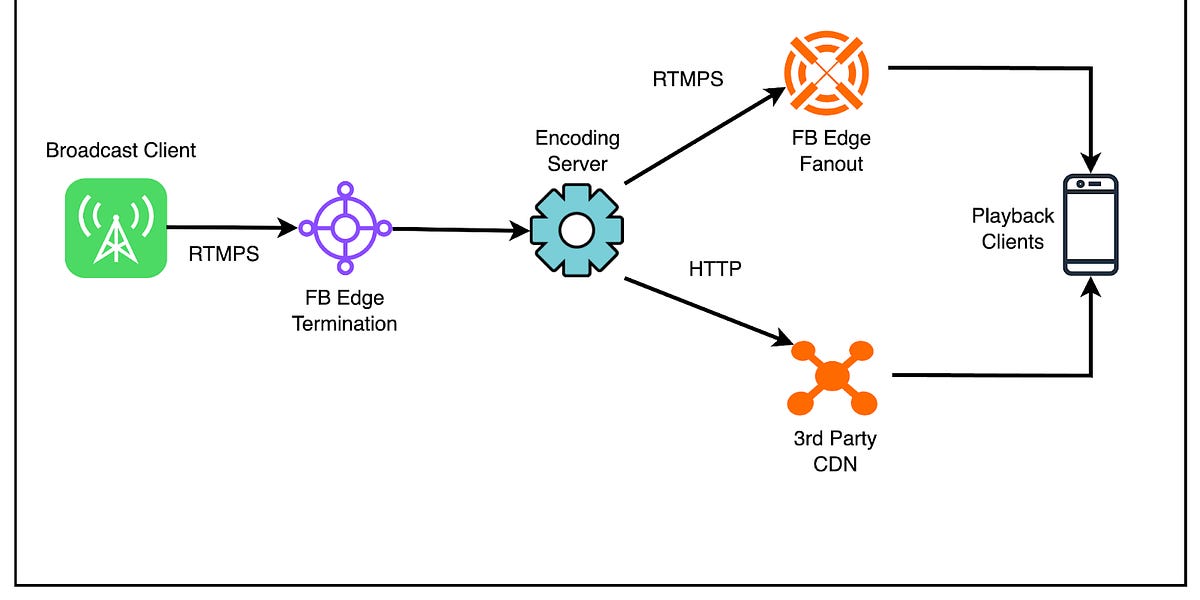

若用户流程测试覆盖率不足80%,可能导致漏洞。QA Wolf的AI服务可在15分钟内提供高效测试覆盖,助力工程团队加速开发。Facebook Live的架构设计应对高流量和实时性,确保视频流畅播放,具备低延迟和高可用性。

🎯

关键要点

- 用户流程测试覆盖率不足80%可能导致漏洞。

- QA Wolf的AI服务可在15分钟内提供高效测试覆盖,帮助工程团队加速开发。

- Facebook Live的架构设计应对高流量和实时性,确保视频流畅播放。

- Facebook Live的直播能力起源于一次黑客马拉松项目,经过四个月推出MVP。

- Facebook的视频基础设施支持从上传到全球实时播放的每个环节。

- 上传管道必须快速且具备弹性,以应对网络波动和设备问题。

- 编码过程通过并行处理视频块来降低延迟并提高可扩展性。

- 直播内容需要实时处理,架构必须应对实时创作的混乱。

- Facebook使用POPs和数据中心的组合来降低延迟和提高可靠性。

- 面对高并发流量和不可预测的观众激增,系统必须具备灵活性和适应性。

- 直播视频的缓存策略采用两级缓存模型,以支持实时内容的分发。

- 保持直播清单的新鲜度对于流畅播放至关重要,使用TTL和HTTP推送技术。

- Facebook Live的成功源于从一开始就设计为可扩展和可靠的架构。

- 在面对不可预见的情况时,系统必须具备应对能力,以确保持续服务。

❓

延伸问答

Facebook Live的架构设计是如何应对高流量的?

Facebook Live的架构设计通过使用POPs和数据中心的组合,确保低延迟和高可用性,以应对高流量和实时性需求。

Facebook Live的直播能力是如何发展的?

Facebook Live的直播能力起源于一次黑客马拉松项目,经过四个月推出MVP,最终在八个月内向所有用户开放。

Facebook Live如何处理实时视频流?

Facebook Live通过实时处理架构,确保直播内容能够快速传输并保持低延迟,支持实时创作的混乱。

Facebook Live的上传管道有哪些关键特性?

上传管道必须快速且具备弹性,支持网络波动和设备问题,采用分块上传以支持恢复和减少重试成本。

Facebook Live是如何应对不可预测的观众激增的?

Facebook Live通过灵活的系统设计,能够快速适应观众激增,动态调整带宽和负载均衡,确保服务持续稳定。

Facebook Live的缓存策略是怎样的?

Facebook Live采用两级缓存模型,POPs作为本地缓存层,数据中心作为源缓存,以支持实时内容的高效分发。

➡️