💡

原文中文,约4300字,阅读约需11分钟。

📝

内容提要

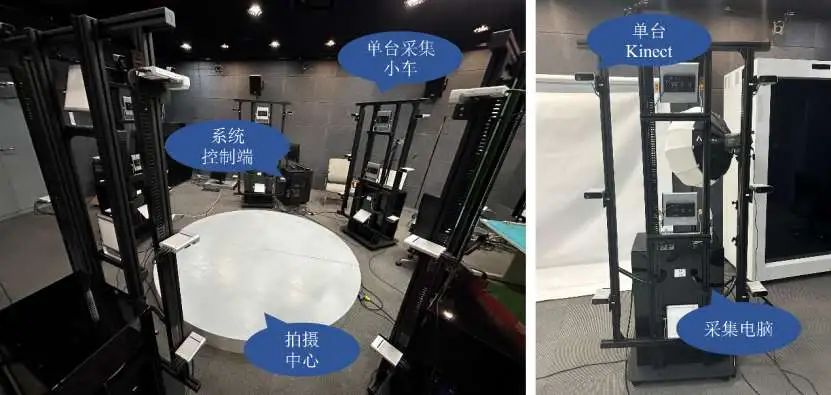

上海交通大学在ICIP 2024推出了一个新的人物交互数据集,包含38组30视角的多人或单人RGB-D视频序列,提供摄像机参数、前景掩码和SMPL模型等信息。视频由30台Kinect Azure摄像机以4K分辨率和25FPS拍摄,解决了现有数据集视角有限和分辨率低的问题,为神经视点合成研究提供了基准,旨在推动人物交互和NVS领域的发展。

🎯

关键要点

- 上海交通大学在ICIP 2024推出新的人物交互数据集,包含38组30视角的RGB-D视频序列。

- 数据集提供摄像机参数、前景掩码、SMPL模型等信息,解决了现有数据集视角有限和分辨率低的问题。

- 视频由30台Kinect Azure摄像机以4K分辨率和25FPS拍摄,视频时长为1至19秒。

- 新数据集旨在推动人物交互和神经视点合成(NVS)领域的发展。

- 现有数据集主要由有限视角的静态数据组成,阻碍了高质量人物交互研究的开展。

- 新数据集提供丰富的先验信息,有助于减轻复杂交互模式和遮挡问题的影响。

- 数据集包含前景掩码、点云、网格文件和SMPL模型,适用于人物交互模型的训练。

- 在数据集上评估了一些最新的NVS模型,建立了NVS基准。

- 数据集是唯一一个多视角、动态同步的4K RGB-D数据集,提供多人和物体之间的交互。

- 希望该工作能够激发更多关于人-物交互和NVS研究的探索。

❓

延伸问答

新的人物交互数据集包含哪些主要内容?

该数据集包含38组30视角的RGB-D视频序列,提供摄像机参数、前景掩码、SMPL模型、点云和网格文件等信息。

这个数据集如何解决现有数据集的不足?

新数据集提供多视角、高分辨率的视频序列,解决了现有数据集视角有限和分辨率低的问题,增强了人物交互研究的质量。

数据集的拍摄设备和参数是什么?

视频由30台Kinect Azure摄像机以4K分辨率和25FPS拍摄,视频时长为1至19秒。

新数据集对神经视点合成(NVS)研究有什么贡献?

新数据集为NVS研究提供了基准,并通过丰富的先验信息帮助减轻复杂交互模式和遮挡问题的影响。

数据集中提供了哪些辅助信息?

数据集提供前景掩码、点云、网格文件和SMPL模型,这些信息可用于人物交互模型的训练。

如何评估数据集上的NVS模型性能?

使用峰值信噪比(PSNR)、结构相似性指数(SSIM)和学习感知图像块相似性(LPIPS)来评估预测图像的质量。

🏷️

标签

➡️