原文中文,约2300字,阅读约需6分钟。

📝

内容提要

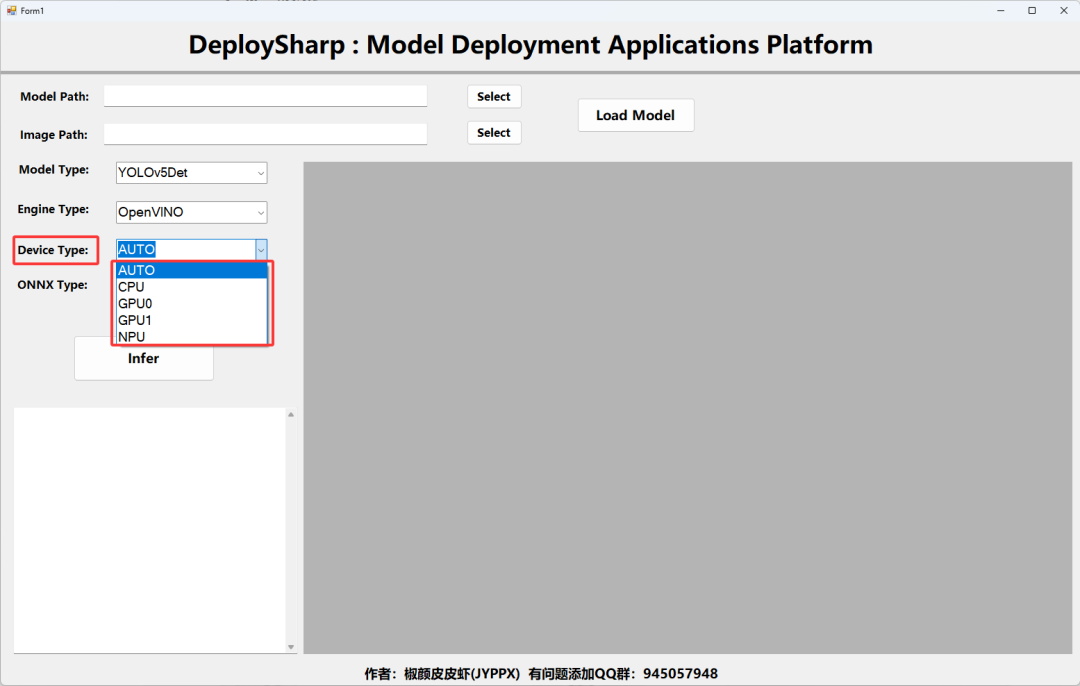

本文介绍了一个深度学习模型部署测试平台,支持YOLOv5至YOLOv13模型,兼容OpenVINO和ONNX Runtime推理引擎,简化了模型部署流程,提供图形化界面,适合算法验证和性能评估。

🎯

关键要点

-

介绍了一个深度学习模型部署测试平台,支持YOLOv5至YOLOv13模型。

-

兼容OpenVINO和ONNX Runtime推理引擎,简化模型部署流程。

-

提供图形化界面,适合算法验证和性能评估。

-

项目是一个面向.NET开发的深度学习模型部署框架。

-

支持多种任务类型,包括目标检测、实例分割、旋转框检测和人体姿态估计。

-

自由切换推理引擎及推理设备,支持多种硬件加速。

-

项目特点包括多模型兼容、多引擎支持和设备自动识别。

-

已预配置OpenVINO运行时,降低入门门槛。

-

在Intel Core Ultra 9 288V平台上进行了性能测试,结果显示显著优于CPU模式。

-

项目提供了一条从模型到应用的高效路径,展现出良好的实用价值。

❓

延伸问答

这个深度学习模型部署平台支持哪些YOLO模型?

该平台支持YOLOv5至YOLOv13模型。

这个平台如何简化模型部署流程?

平台提供图形化界面,用户可以快速加载模型、选择推理设备并查看结果,降低了部署的复杂性。

该平台兼容哪些推理引擎?

该平台兼容OpenVINO和ONNX Runtime推理引擎。

在性能测试中,YOLOv8s-det的表现如何?

在IGPU上,YOLOv8s-det使用OpenVINO可达67.74 FPS,显著优于CPU模式。

这个平台适合哪些任务类型?

平台支持目标检测、实例分割、旋转框检测和人体姿态估计等多种任务类型。

如何获取该深度学习模型部署平台的源码?

可以通过命令git clone xxx.git和cd xx/applications获取源码。

🏷️