💡

原文中文,约17700字,阅读约需43分钟。

📝

内容提要

本文介绍了基于Amazon EKS和NVIDIA NIM的混合云大模型推理架构,强调本地GPU优先和云上弹性扩展的策略。通过KEDA和Karpenter实现自动扩缩容,优化成本和性能,满足中国客户需求。该方案解决了延迟、数据本地化和成本问题,提供统一监控和最佳实践,帮助企业有效利用现有GPU资源。

🎯

关键要点

- 基于 Amazon EKS 和 NVIDIA NIM 构建混合云大模型推理架构,实现本地 GPU 优先和云上弹性扩展。

- 通过 KEDA 和 Karpenter 实现自动扩缩容,优化成本和性能,满足中国客户需求。

- 方案解决了延迟、数据本地化和成本问题,提供统一监控和最佳实践。

- 客户需求包括延迟敏感、数据本地化、成本考量和已有 GPU 投资的利用。

- 采用双集群架构,结合本地和云上资源,实现智能路由和负载均衡。

- NVIDIA NIM 提供优化的推理引擎,显著提升性能和降低冷启动时间。

- 弹性伸缩策略实现了本地优先、云上兜底的资源管理,确保成本控制。

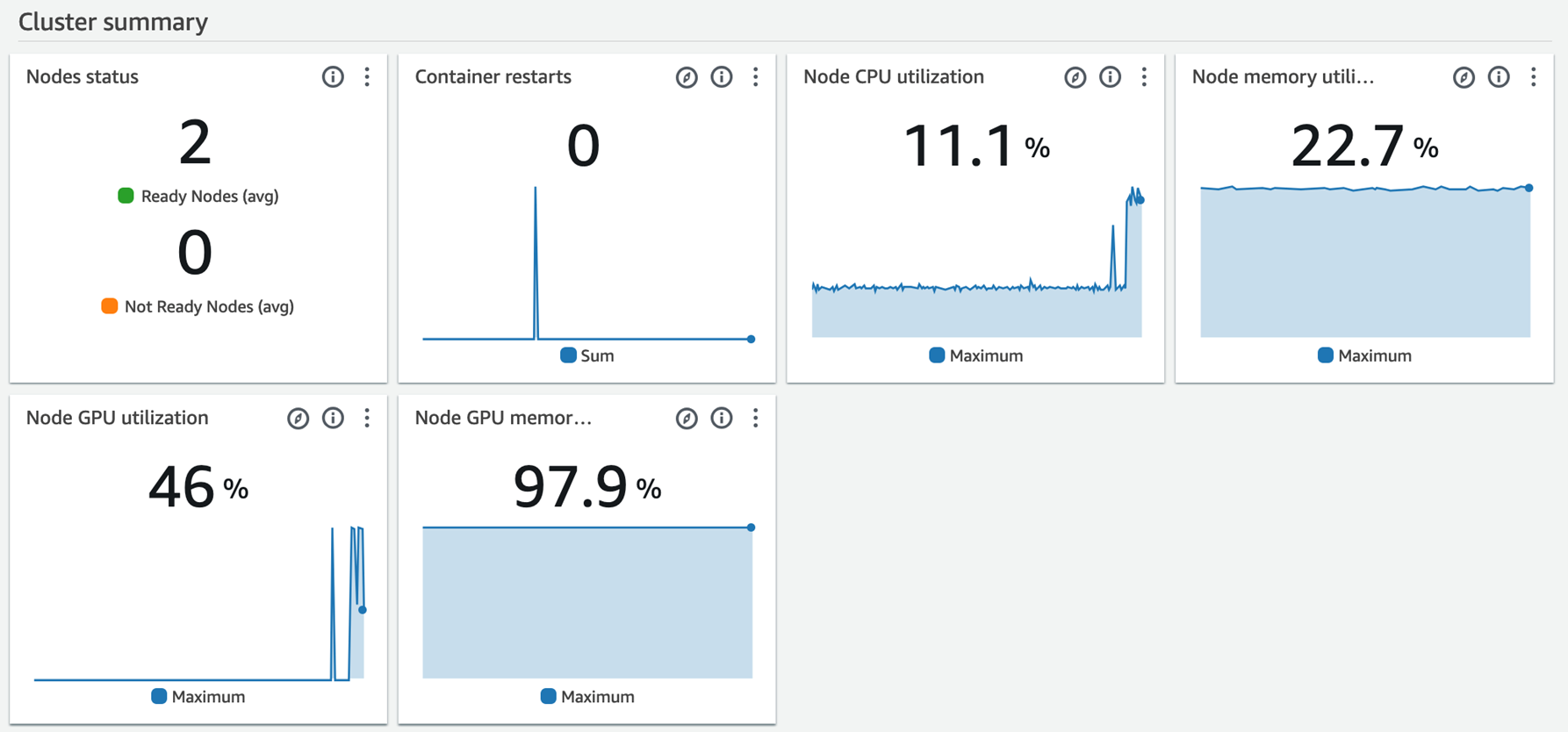

- 通过统一监控体系,实时跟踪推理服务的性能和资源使用情况。

- 针对中国客户的场景,方案在制造业和已有 GPU 投资复用方面具有独特价值。

- 总结了实施过程中的最佳实践和常见问题,帮助企业更好地部署混合云架构。

❓

延伸问答

如何实现基于 Amazon EKS 的混合云大模型推理架构?

通过构建双集群架构,结合本地 IDC 的 Kubernetes 集群和 AWS 上的 Amazon EKS 集群,实现本地 GPU 优先和云上弹性扩展。

KEDA 和 Karpenter 在弹性伸缩中起什么作用?

KEDA 负责根据自定义指标触发 Pod 扩容,而 Karpenter 则负责动态创建和销毁 GPU 工作节点,实现自动扩缩容。

NVIDIA NIM 的优势是什么?

NVIDIA NIM 提供预优化的推理引擎,支持标准 OpenAI API,具有更高的吞吐量和更低的冷启动时间,适合弹性伸缩场景。

如何解决混合云推理中的延迟和数据本地化问题?

通过本地推理服务处理实时请求,确保低延迟,同时满足数据本地化需求,减少敏感数据的网络传输。

该方案如何优化成本?

通过使用 Spot 实例和设置 KEDA 的 minReplicaCount 为 0,实现流量高峰时按需付费,流量回落时零成本待机。

在中国客户场景中,该方案的独特价值是什么?

方案能够有效利用已有的 GPU 投资,提供弹性扩展能力,满足制造业等对实时性和数据本地化的高要求。

➡️