AAAI 2026 | 美团技术团队学术论文精选

美团技术团队

·

HyperAI超神经 x CCF ODTC丨vLLM助力大模型推理性能革新

HyperAI超神经

·

<span class=“js_title_inner“>LLM 推理经济学</span>

OneFlow深度学习框架

·

在 AWS Graviton 上运行大语言模型:CPU 推理性能实测与调优指南

亚马逊AWS官方博客

·

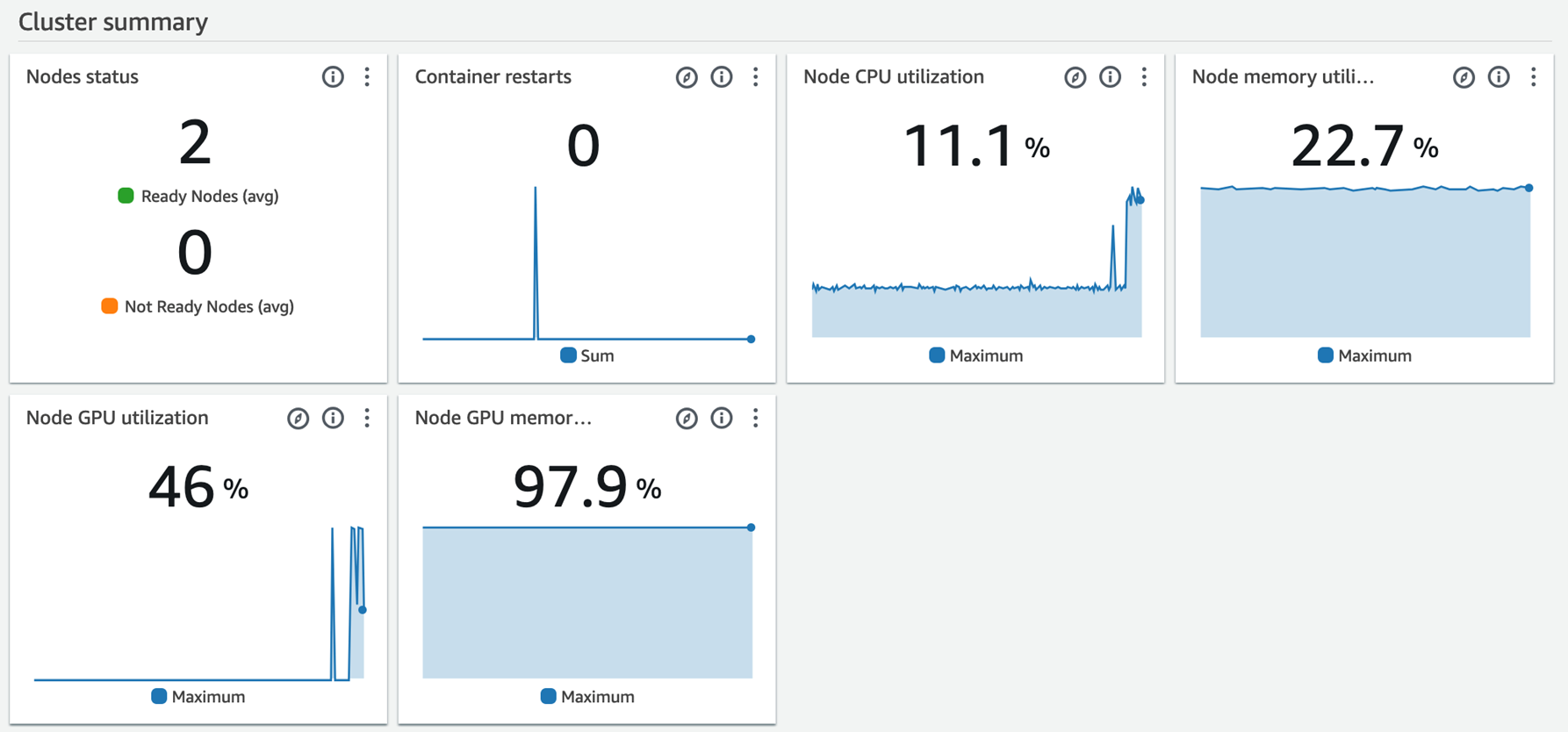

大模型推理有妙招:Amazon SageMaker 让你事半功倍,伸缩自如

亚马逊AWS官方博客

·