原文中文,约4600字,阅读约需11分钟。

📝

内容提要

文章介绍了使用RTX 4070显卡和ollama工具部署大模型的过程。RTX 4070适合中小型模型的训练,支持实时推理。ollama作为模型管理器,提供简单的命令行操作和API接口,便于模型的创建与管理。文中还提到嵌入模型的应用及函数调用概念,展示如何通过外部函数获取动态信息。

🎯

关键要点

-

RTX 4070显卡适合中小型模型的训练,支持实时推理。

-

使用nvidia-smi工具监控GPU资源消耗。

-

ollama是一个模型管理器,提供简单的命令行操作和API接口。

-

ollama支持在本地、K8s集群和虚拟机上部署开源大模型。

-

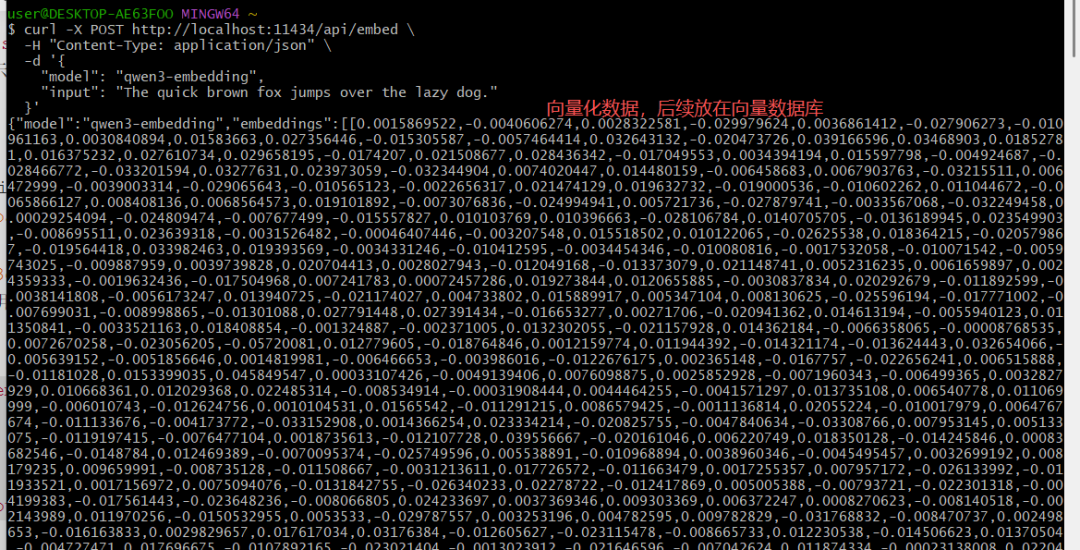

嵌入模型用于将文本和图像数据向量化,适用于语义搜索和检索。

-

function calling允许模型调用外部工具并将结果合并到对话响应中。

-

通过function calling,LLM可以获取动态信息并进行推理。

❓

延伸问答

RTX 4070显卡适合什么类型的模型训练?

RTX 4070显卡适合中小型模型的训练,支持实时推理。

ollama工具的主要功能是什么?

ollama是一个模型管理器,提供简单的命令行操作和API接口,帮助用户在本地、K8s集群和虚拟机上部署开源大模型。

如何使用nvidia-smi监控GPU资源?

使用nvidia-smi工具可以监控GPU的资源消耗,包括显存使用量、GPU计算能力等。

什么是嵌入模型,它的应用场景有哪些?

嵌入模型用于将文本和图像数据向量化,适用于语义搜索和检索。

什么是函数调用,它在模型推理中有什么作用?

函数调用允许模型调用外部工具并将结果合并到对话响应中,使得模型能够获取动态信息并进行推理。

如何通过ollama部署大模型?

通过命令行使用ollama run命令可以启动大模型,并通过ollama serve命令将其作为web服务运行。

🏷️