使用Scikit-LLM与开源语言模型

MachineLearningMastery.com

·

使用本地小型语言模型构建AI代理

MachineLearningMastery.com

·

从“开源英雄”到“社区公敌”,Ollama 到底做错了什么?

Tony Bai

·

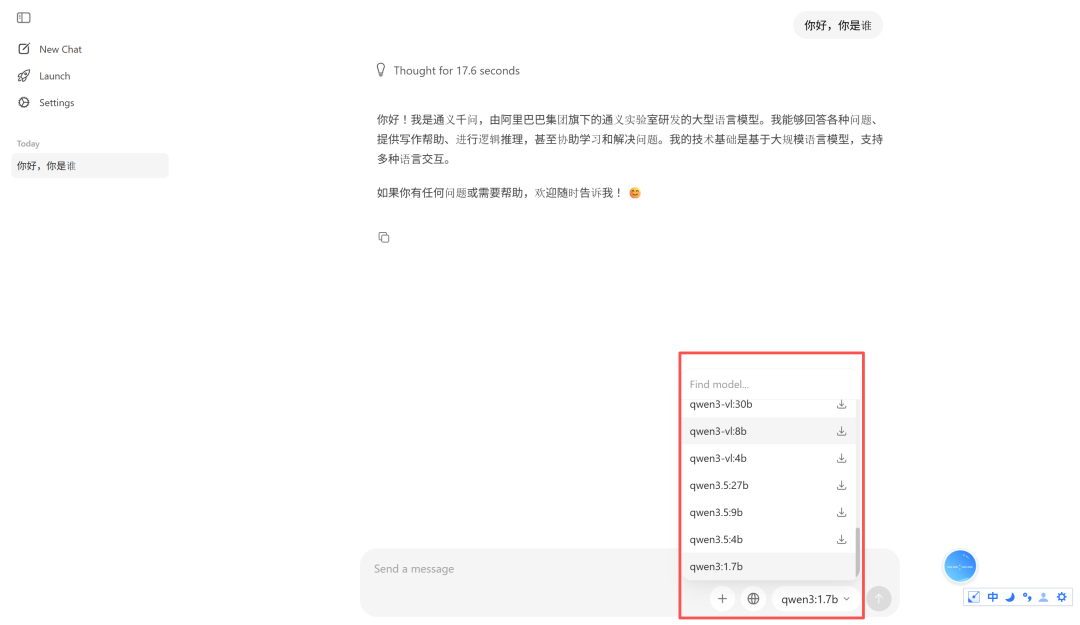

Agent Framework 接入 Ollama(本地模型实践记录)

dotNET跨平台

·