💡

原文中文,约10300字,阅读约需25分钟。

📝

内容提要

本文介绍如何在NVIDIA DGX Spark上部署Ollama、Open WebUI和ComfyUI,以创建本地AI工作站。用户可以通过Open WebUI进行聊天,并利用ComfyUI生成图像。文章详细说明了前置准备、部署步骤及模型选择,确保用户能够顺利搭建和使用该系统。

🎯

关键要点

- 本文介绍如何在NVIDIA DGX Spark上部署Ollama、Open WebUI和ComfyUI,创建本地AI工作站。

- DGX Spark是NVIDIA推出的桌面级AI超级计算机,适合运行大语言模型和图像生成工作负载。

- 前置准备包括确保DGX Spark完成初始设置和Docker权限配置。

- 通过Docker命令可以快速部署Open WebUI和Ollama,用户可通过浏览器访问聊天界面。

- 推荐的聊天模型包括deepseek-r1、qwen3.5等,用户可根据需求选择合适的模型。

- ComfyUI作为图像生成后端,可以通过Docker或源码安装,支持多种模型和节点管理。

- 在Open WebUI中配置ComfyUI后,用户可以在聊天界面直接生成图像。

- 常用操作包括更新Open WebUI、停止服务和清理数据,确保系统正常运行。

- 常见问题解答提供了关于节点缺失、连接问题和生成速度的解决方案。

❓

延伸问答

如何在NVIDIA DGX Spark上部署Ollama和Open WebUI?

可以通过Docker命令快速部署Ollama和Open WebUI,用户需确保DGX Spark完成初始设置并配置Docker权限。

ComfyUI的主要功能是什么?

ComfyUI是一个基于节点的图像生成引擎,支持Stable Diffusion和FLUX工作流,可以与Open WebUI集成进行图像生成。

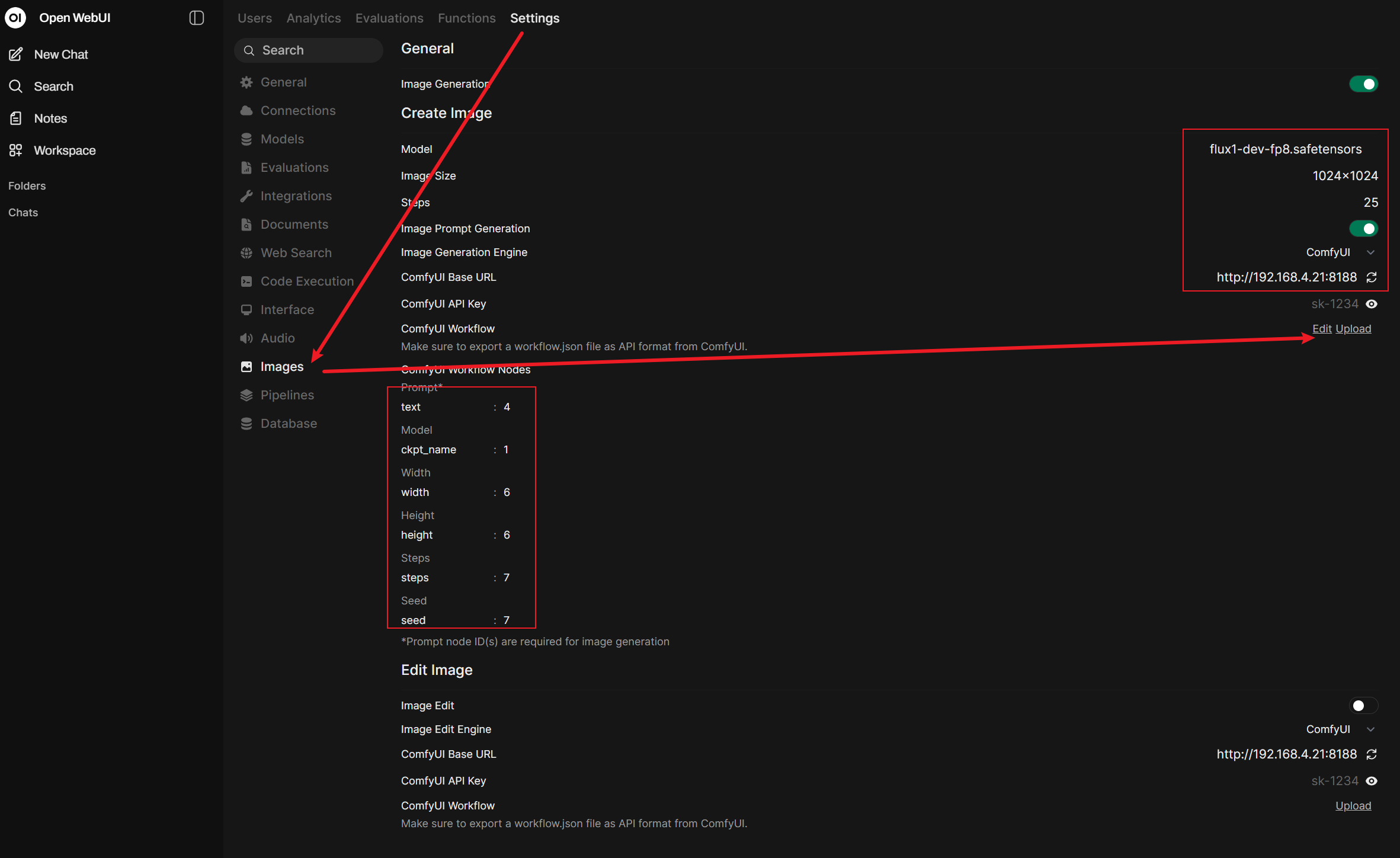

在Open WebUI中如何配置ComfyUI进行图像生成?

在Open WebUI的设置中,将图像生成引擎设置为ComfyUI,并配置ComfyUI的Base URL和其他参数。

推荐的聊天模型有哪些?

推荐的聊天模型包括deepseek-r1、qwen3.5等,用户可根据需求选择合适的模型。

如何解决Open WebUI无法连接ComfyUI的问题?

确认ComfyUI监听的是0.0.0.0而非127.0.0.1,并检查Base URL是否使用DGX Spark的局域网IP。

在使用ComfyUI时如何添加更多模型?

可以通过ComfyUI Manager浏览和安装各种模型,或手动将.safetensors模型文件放到ComfyUI的models子目录中。

➡️