内容提要

Ollama 是一个本地运行大模型的工具,适合处理敏感数据和成本敏感的项目。安装后,Ollama 启动本地服务,用户可通过 API 调用模型。将 Ollama 集成到 Agent Framework 后,可以灵活地在本地完成 AI 调用链路,增强数据控制和可控性。

关键要点

-

Ollama 是一个本地运行大模型的工具,适合处理敏感数据和成本敏感的项目。

-

安装 Ollama 后,本机会启动一个服务,用户可以通过 API 调用模型,而不依赖云服务。

-

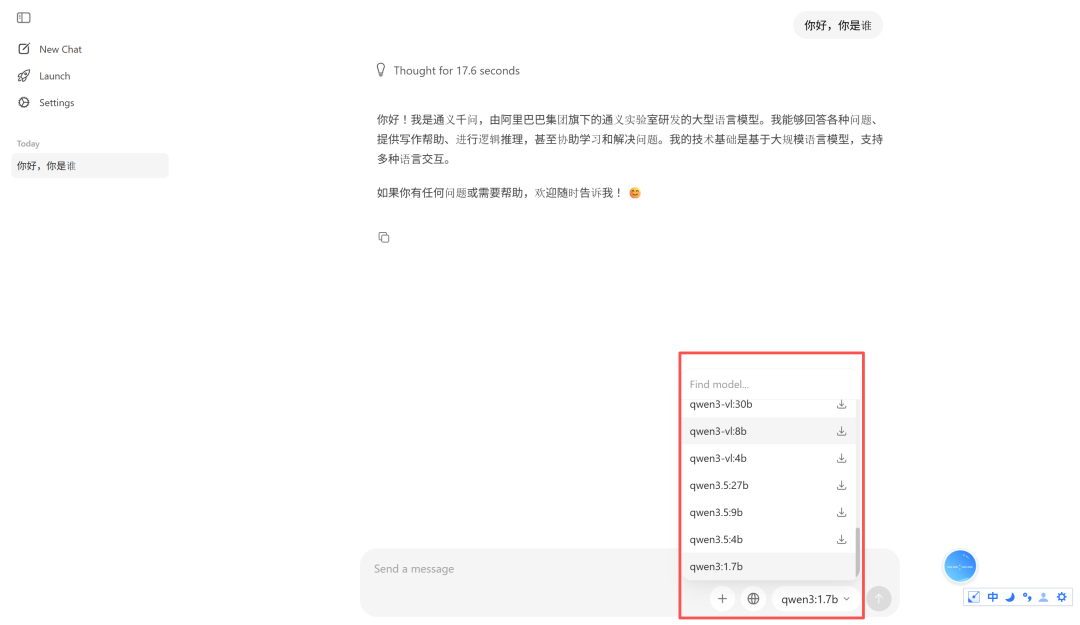

使用 Ollama 前需要下载模型,模型体积通常较大,从几 GB 到十几 GB。

-

Ollama 可以集成到 Agent Framework 中,用户可以通过本地服务地址与模型交互。

-

Ollama 主要解决本地运行模型的问题,而 Agent Framework 负责将模型能力组织成 Agent 使用。

-

结合 Ollama 和 Agent Framework,可以在本地完成简单的 AI 调用链路,增强数据控制和可控性。

延伸问答

Ollama 是什么?

Ollama 是一个本地运行大模型的工具,适合处理敏感数据和成本敏感的项目。

如何安装 Ollama?

安装 Ollama 后,系统会启动一个服务,用户可以通过 API 调用模型,安装过程简单,Windows 下基本是一路“下一步”。

Ollama 如何与 Agent Framework 集成?

将 Ollama 接入 Agent Framework 后,可以通过本地服务地址与模型交互,配置该地址即可直接调用本地模型。

使用 Ollama 前需要注意什么?

使用 Ollama 前需要先下载模型,模型体积通常较大,从几 GB 到十几 GB。

Ollama 的服务地址是什么?

Ollama 在本地启动的服务地址是 http://localhost:11434。

结合 Ollama 和 Agent Framework 有什么优势?

结合 Ollama 和 Agent Framework,可以在本地完成简单的 AI 调用链路,增强数据控制和可控性,适合敏感数据场景。