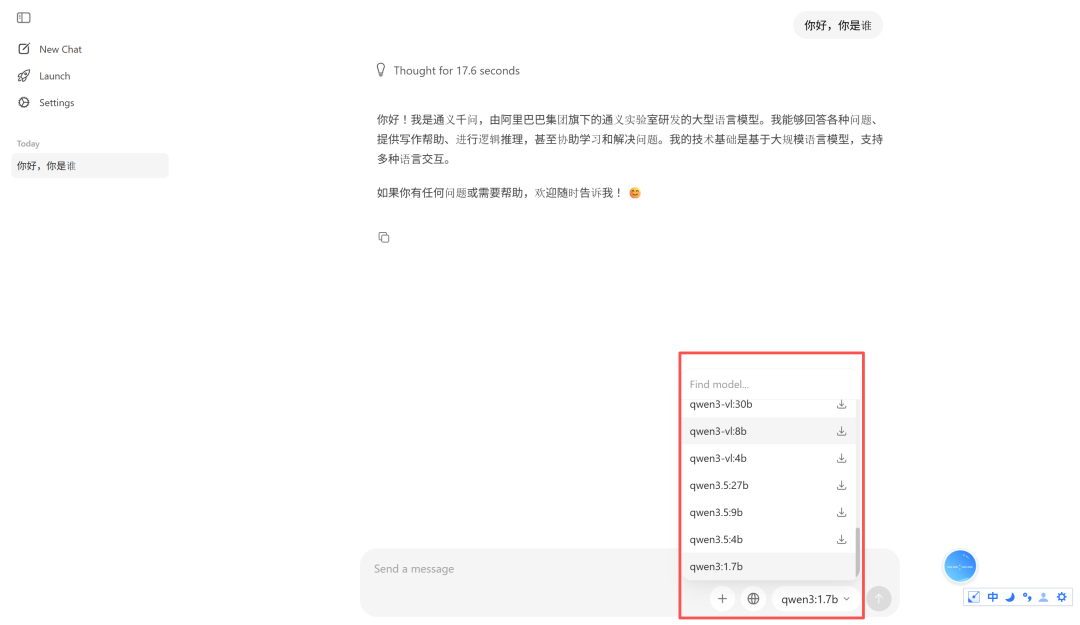

Agent Framework 接入 Ollama(本地模型实践记录)

dotNET跨平台

·

![技术速递|oBeaver —— 一只可以在你本地机器上运行大语言模型的海狸 [特殊字符]](https://i-blog.csdnimg.cn/img_convert/70160dba46b0d7686e2570f24396f6a9.png)

技术速递|oBeaver —— 一只可以在你本地机器上运行大语言模型的海狸 [特殊字符]

dotNET跨平台

·

如何使用Ollama在本地运行和自定义大型语言模型(LLMs)

freeCodeCamp.org

·

如何在本地运行LLM以与您的文档进行交互

freeCodeCamp.org

·

你错过的七大开源AI编码模型

KDnuggets

·

你所需要的就是Ollama的新应用

KDnuggets

·

我看到的5个本地环境错误及其正确解决方法

DEV Community

·

使用Act在本地运行GitHub Actions:开发者指南 🛠️

DEV Community

·