💡

原文中文,约2700字,阅读约需7分钟。

📝

内容提要

本文介绍了如何在Ubuntu系统上本地部署Ollama与Qwen 3.5 (9B)模型,并结合Open WebUI实现AI对话系统。步骤包括安装Ollama、运行Qwen 3.5模型、使用Docker部署Open WebUI,以及配置与使用界面。用户可通过浏览器访问本地服务,注册账号并选择模型,确保隐私与无Token费用。

🎯

关键要点

- 本文介绍了如何在Ubuntu系统上本地部署Ollama与Qwen 3.5 (9B)模型,并结合Open WebUI实现AI对话系统。

- 步骤包括安装Ollama、运行Qwen 3.5模型、使用Docker部署Open WebUI,以及配置与使用界面。

- Ollama是Linux平台上部署本地模型的简单工具,用户可以通过终端一键安装。

- Qwen 3.5 (9B)模型在性能和显存占用之间取得了平衡,用户可以通过命令行与模型对话。

- 使用Docker部署Open WebUI可以获得最佳的用户体验,并支持多用户和文档解析。

- 用户可以通过浏览器访问本地服务,注册账号并选择模型,确保隐私与无Token费用。

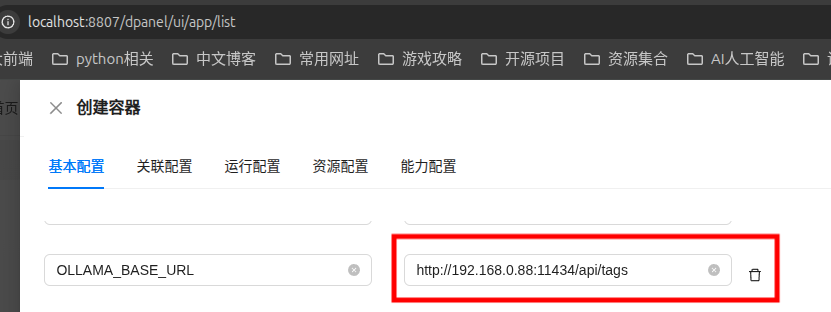

- 为了实现远程访问,需要修改Ollama的环境变量,并确保Docker容器能够访问本地Ollama服务。

- 运行9B模型建议至少16GB内存和大于8GB显存,以获得更好的性能。

❓

延伸问答

如何在Ubuntu上安装Ollama?

在终端执行命令:curl -fsSL https://ollama.com/install.sh | sh,安装完成后检查服务状态:systemctl status ollama。

Qwen 3.5 (9B)模型的性能如何?

Qwen 3.5 (9B)模型在性能和显存占用之间取得了平衡,适合在本地运行。

如何使用Docker部署Open WebUI?

安装Docker后,运行命令:docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main。

如何确保Ollama服务可以被远程访问?

需要修改Ollama的环境变量,添加Environment="OLLAMA_HOST=0.0.0.0",然后重启服务。

使用Qwen 3.5模型需要什么样的硬件配置?

建议至少16GB内存和大于8GB显存,以获得更好的性能。

如何通过浏览器访问本地的AI对话系统?

在浏览器中输入http://localhost:3000即可访问,并注册账号选择模型。

🏷️

标签

➡️