💡

原文中文,约4800字,阅读约需12分钟。

📝

内容提要

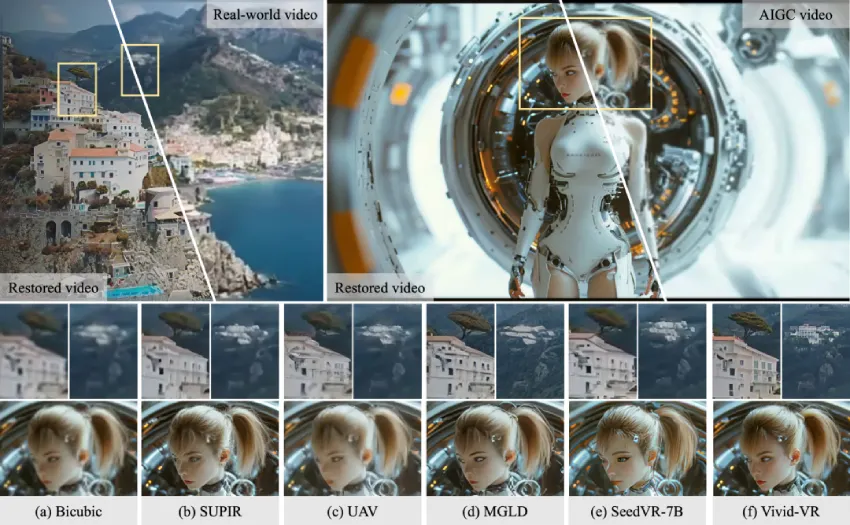

本文介绍了淘天音团队提出的Vivid-VR生成式视频复原算法,解决了现有方法的“分布漂移”问题。该算法通过“概念蒸馏”训练策略,在纹理真实感、视觉生动性和时序一致性方面显著优于现有技术,已被ICLR 2026收录。

🎯

关键要点

-

淘天音团队提出了Vivid-VR生成式视频复原算法,解决了分布漂移问题。

-

Vivid-VR算法在纹理真实感、视觉生动性和时序一致性方面显著优于现有技术。

-

该算法已被顶级会议ICLR 2026收录,属于生成式大模型的视频复原领域。

-

Vivid-VR采用了概念蒸馏训练策略,将T2V基座模型的概念理解能力迁移至复原任务中。

-

控制特征投影器和双分支连接器的设计增强了生成的可控性。

-

实验结果表明,Vivid-VR在合成视频和真实视频上均表现出色,具有强大的泛化能力。

-

Vivid-VR的推理成本较高,未来将致力于提升算法效率以实现更快的推理速度。

-

淘天音视频技术团队致力于音视频技术创新,推动学术研究与商业应用的融合。

❓

延伸问答

Vivid-VR算法解决了什么问题?

Vivid-VR算法解决了现有视频复原方法中的“分布漂移”问题,避免了纹理失真和时序不一致。

Vivid-VR在视频复原方面有哪些优势?

Vivid-VR在纹理真实感、视觉生动性和时序一致性方面显著优于现有技术。

Vivid-VR采用了什么训练策略?

Vivid-VR采用了“概念蒸馏”训练策略,将T2V基座模型的概念理解能力迁移至复原任务中。

Vivid-VR的推理成本如何?

Vivid-VR的推理成本较高,未来将致力于提升算法效率以实现更快的推理速度。

Vivid-VR的实验结果如何?

实验结果表明,Vivid-VR在合成视频和真实视频上均表现出色,具有强大的泛化能力。

ICLR 2026会议的背景是什么?

ICLR是机器学习领域的顶级学术会议,重点关注深度学习相关的前沿研究,每年举办一次。

➡️