💡

原文英文,约1800词,阅读约需7分钟。

📝

内容提要

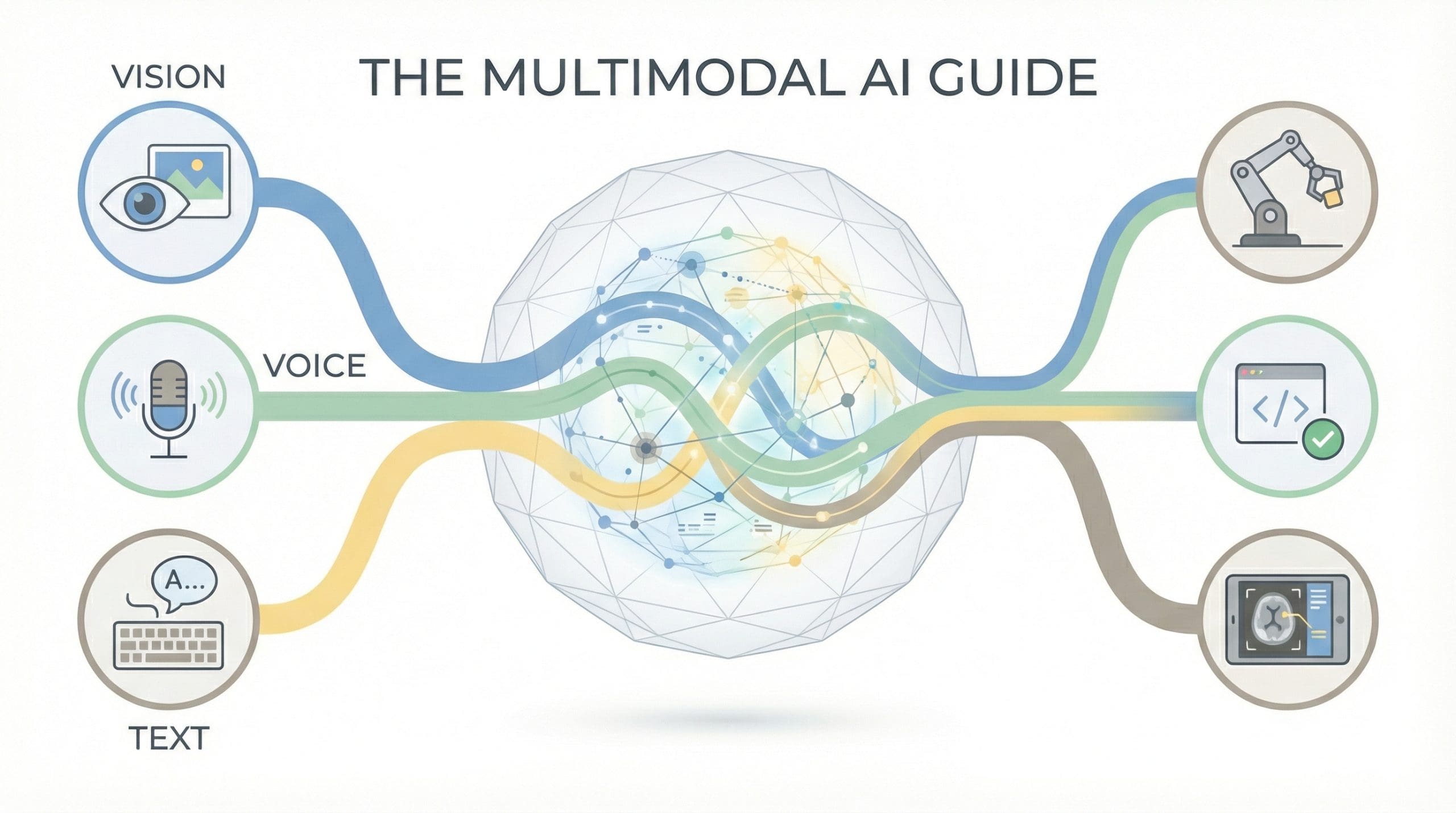

多模态人工智能(AI)能够同时处理图像、语音和文本等多种数据,改变了人机交互方式,提升了工作效率。新兴AI系统在视觉、语音和文本整合方面取得显著进展,推动了医疗、创意和无障碍等领域的应用。

🎯

关键要点

- 多模态人工智能(AI)能够同时处理图像、语音和文本等多种数据,改变了人机交互方式。

- 多模态AI系统能够直接理解信息,消除了传统人机交互中的转换层。

- 多模态AI包括图像、音频、视频和结构化数据等多种数据类型的处理和生成。

- 视觉AI从基本的图像分类发展到真正的视觉理解,能够分析复杂的视觉上下文。

- 语音AI超越了简单的转录,能够理解语气、情感和上下文。

- 文本集成是多模态AI的核心,语言模型提供推理和生成能力。

- 多模态AI的应用正在快速扩展,包括3D空间理解和结构化数据处理。

- 多模态AI已经从研究转向实际应用,解决了内容分析、医疗成像和无障碍工具等实际问题。

- 新基础设施正在形成,支持多模态开发,降低了技术门槛。

- 多模态AI改变了人机交互模式,未来的AI将自然理解视觉、语音和文本。

❓

延伸问答

什么是多模态人工智能?

多模态人工智能是指能够同时处理和生成多种类型数据(如图像、语音和文本)的系统。

多模态人工智能如何改变人机交互方式?

它通过直接理解信息的原始形式,消除了传统人机交互中的转换层,简化了工作流程。

多模态人工智能的应用领域有哪些?

应用领域包括医疗、创意设计、无障碍工具、内容分析等。

视觉AI与语音AI的主要区别是什么?

视觉AI专注于图像理解和空间推理,而语音AI则处理语音识别和情感理解。

多模态AI如何处理结构化数据?

多模态AI能够直接理解表格和数据库,而无需将其转换为文本,从而提高数据分析的效率。

未来多模态人工智能的发展趋势是什么?

未来将更加注重自然理解视觉、语音和文本,推动更自然的人机交互方式。

➡️