💡

原文英文,约1200词,阅读约需5分钟。

📝

内容提要

本文讨论了将Apache Airflow迁移到Databricks的Lakeflow Jobs,重点在于执行细节和常见模式的转换。提供了迁移指南,包括任务值、触发器和参数化回填的处理。强调了在Lakeflow中使用条件任务和动态任务映射的最佳实践,建议逐步迁移。

🎯

关键要点

- 本文讨论了将Apache Airflow迁移到Databricks的Lakeflow Jobs,重点在于执行细节和常见模式的转换。

- 提供了迁移指南,包括任务值、触发器和参数化回填的处理。

- 强调在Lakeflow中使用条件任务和动态任务映射的最佳实践。

- 建议逐步迁移,而不是一次性替换Airflow。

- 在Lakeflow Jobs中,任务值用于控制元数据,实际数据应存储在Unity Catalog表中。

- 使用文件到达触发器替代Airflow中的文件传感器,简化了触发状态管理。

- 在Lakeflow中,执行日期应建模为参数,以便于回填操作。

- 使用条件任务处理数据驱动的分支逻辑,使用for-each任务处理运行时的任务映射。

❓

延伸问答

如何将Apache Airflow迁移到Databricks的Lakeflow Jobs?

迁移可以通过逐步替换Airflow的任务值、触发器和参数化回填来实现,建议从一个依赖传感器、XComs或动态任务映射的DAG开始。

在Lakeflow Jobs中,如何处理任务值和数据存储?

在Lakeflow Jobs中,任务值用于控制元数据,而实际数据应存储在Unity Catalog表中。

Lakeflow Jobs中如何替代Airflow的文件传感器?

可以使用文件到达触发器替代Airflow中的文件传感器,简化触发状态管理。

在Lakeflow中,如何进行条件任务处理?

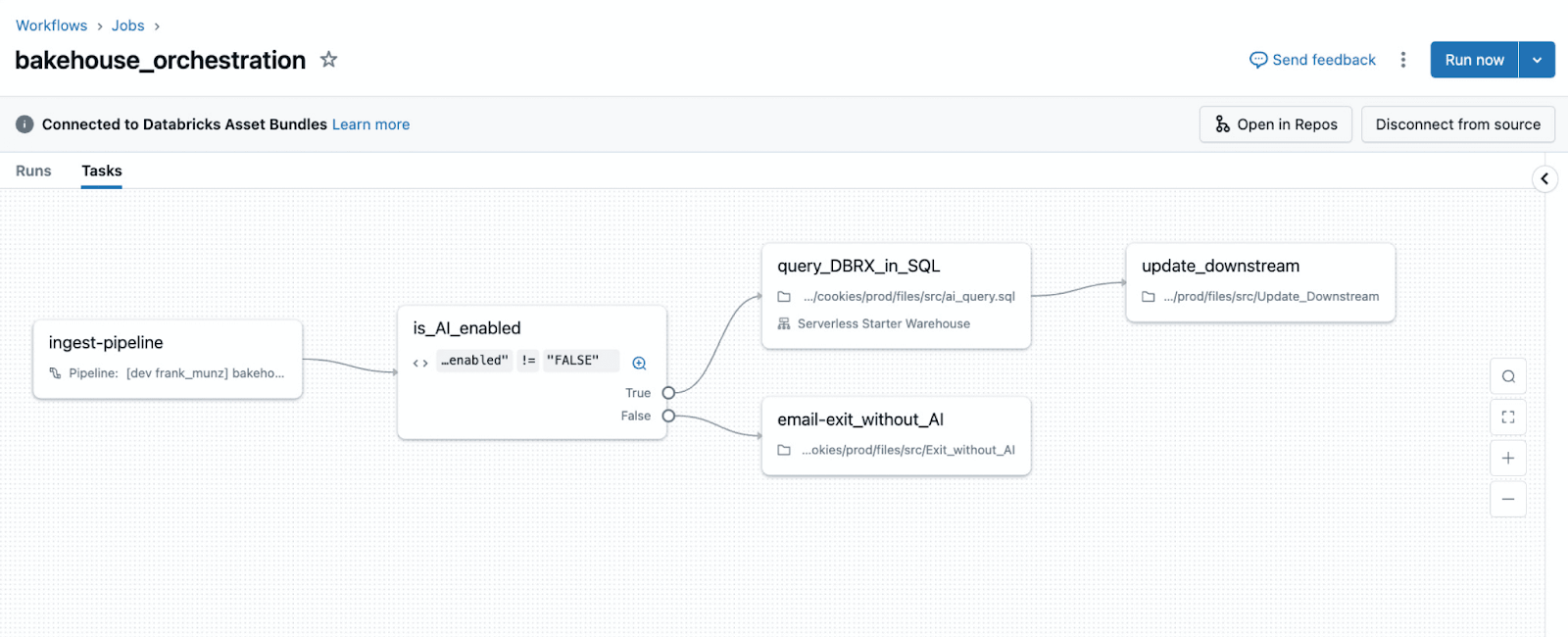

Lakeflow使用条件任务来处理数据驱动的分支逻辑,允许根据任务值的布尔表达式决定执行路径。

迁移到Lakeflow Jobs时,如何处理回填操作?

在Lakeflow中,执行日期应建模为参数,以便于回填操作,使用参数化回填而不是依赖调度器的时间概念。

在Lakeflow Jobs中,动态任务映射是如何实现的?

动态任务映射在Lakeflow中通过for-each任务实现,当任务数量依赖于运行时数据时使用此方法。

➡️