💡

原文英文,约1100词,阅读约需4分钟。

📝

内容提要

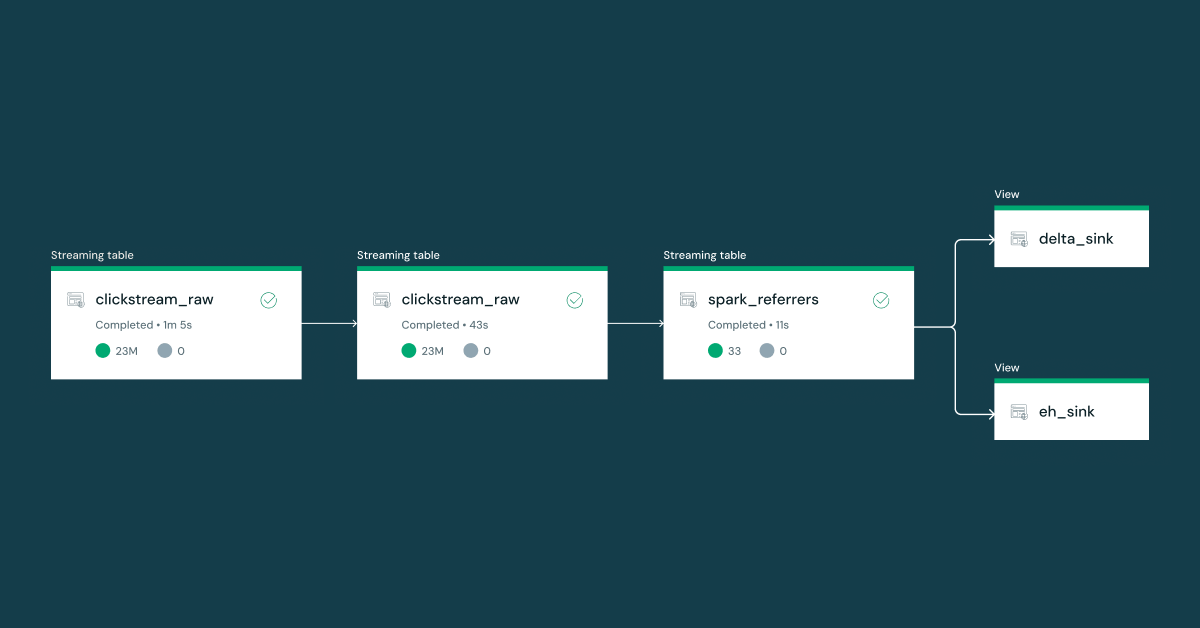

Delta Live Tables (DLT) 是一个强大的数据处理管道平台。新推出的 Sinks API 允许用户将处理后的数据写入外部事件流(如 Kafka)和 Delta 表,增强了 DLT 的功能。通过 create_sink() API,用户可以配置不同的输出格式和选项,以支持实时分析和事件驱动架构。

🎯

关键要点

- Delta Live Tables (DLT) 是一个强大的数据处理管道平台。

- 新推出的 Sinks API 允许用户将处理后的数据写入外部事件流(如 Kafka)和 Delta 表。

- 通过 create_sink() API,用户可以配置不同的输出格式和选项。

- DLT 管道简化了流处理、数据转换和管理的复杂性,提供可扩展性和效率。

- 新 Sinks API 使用户能够将数据写入外部系统,扩展了 DLT 的功能。

- Sink API 允许用户定义 sink 名称、格式规范和选项。

- @append_flow API 现已增强,允许将数据写入特定的 sinks。

- 使用 Medallion Architecture 组织数据以提高质量和处理效率。

- 可以使用 create_sink API 配置 Event Hubs 和 Delta sinks。

- applyInPandasWithState 函数支持在 DLT 中进行有状态处理。

- 新功能支持实时分析和事件驱动架构,确保数据管道高效处理流数据。

- DLT Sinks 功能现已在公共预览中向所有 Databricks 客户开放。

❓

延伸问答

什么是 Delta Live Tables (DLT)?

Delta Live Tables (DLT) 是一个用于构建可靠、可维护和可测试的数据处理管道的平台。

DLT 的 Sinks API 有什么新功能?

新推出的 Sinks API 允许用户将处理后的数据写入外部事件流(如 Kafka)和 Delta 表,扩展了 DLT 的功能。

如何使用 create_sink() API 配置输出格式?

通过 create_sink() API,用户可以定义 sink 名称、格式规范(如 'kafka' 或 'delta')和选项,以配置输出格式。

DLT 管道如何支持实时分析?

DLT 管道通过 Sinks API 支持将数据流写入 Kafka 和 Delta 表,从而实现实时分析和事件驱动架构。

如何配置 Azure Event Hubs Sink?

使用 create_sink API 配置 Event Hubs Sink 时,需要确保有一个可操作的 Kafka 或 Event Hubs 流,并更新连接属性和密钥。

applyInPandasWithState 函数在 DLT 中的作用是什么?

applyInPandasWithState 函数支持在 DLT 中进行有状态处理,允许用户使用 Pandas 进行复杂的数据转换和聚合。

➡️