💡

原文英文,约2600词,阅读约需10分钟。

📝

内容提要

本文介绍了开放式大型语言模型排行榜Open LLM Leaderboard中的一个评估标准——Massive Multitask Language Understanding(MMLU),以及该标准在不同实现中的差异。作者通过对三种不同实现的MMLU评估方法进行比较,发现它们给出的评估结果存在较大差异,甚至会改变模型在排行榜上的排名。作者指出,评估结果的差异与实现细节密切相关,因此开放、标准化、可重现的基准测试非常重要。最后,作者表示Open LLM Leaderboard将继续使用社区维护的评估库,并更新了MMLU的评估方法,以使其与原始实现相似。

🎯

关键要点

- Open LLM Leaderboard中的评估标准Massive Multitask Language Understanding(MMLU)存在不同实现的差异。

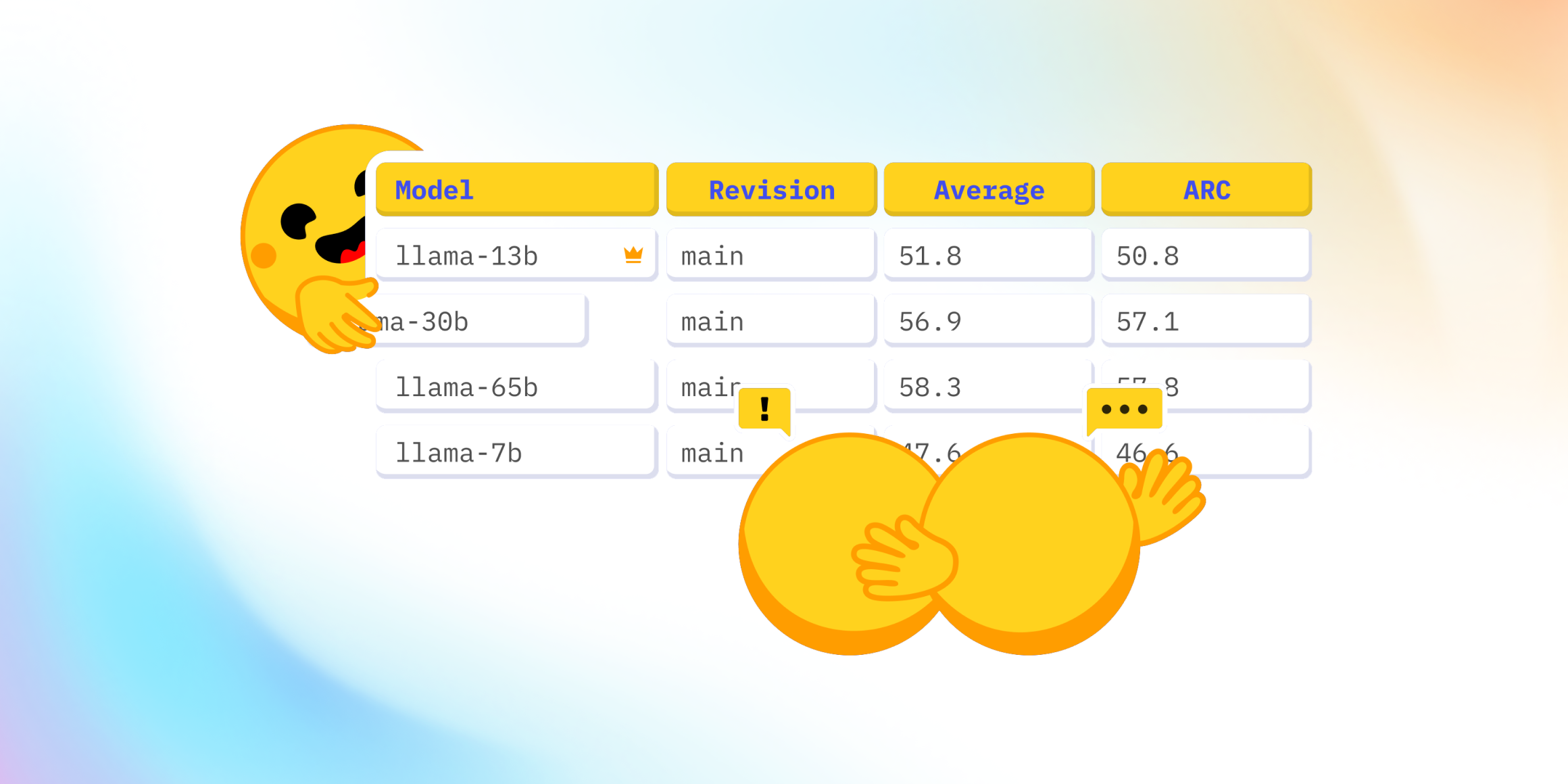

- LLaMA模型在排行榜上的MMLU评估结果显著低于其论文中发布的数字。

- 评估结果的差异与实现细节密切相关,强调了开放、标准化和可重现基准测试的重要性。

- Open LLM Leaderboard使用Eleuther AI LM Evaluation Harness进行评估,并存储结果。

- 三种不同的MMLU实现(原始实现、HELM实现和Harness实现)在评估结果上存在显著差异,甚至改变模型排名。

- MMLU是一个多项选择题测试,涵盖57个知识领域,评估模型的能力。

- 不同实现的评估方法在输入提示、输出期望和比较方式上存在差异,影响最终得分。

- 评估模型的最佳方法并不明确,不同模型在不同评估方法下的表现可能不同。

- 社区维护的评估库将继续用于Open LLM Leaderboard,并更新MMLU评估方法以与原始实现相似。

➡️