💡

原文中文,约2300字,阅读约需6分钟。

📝

内容提要

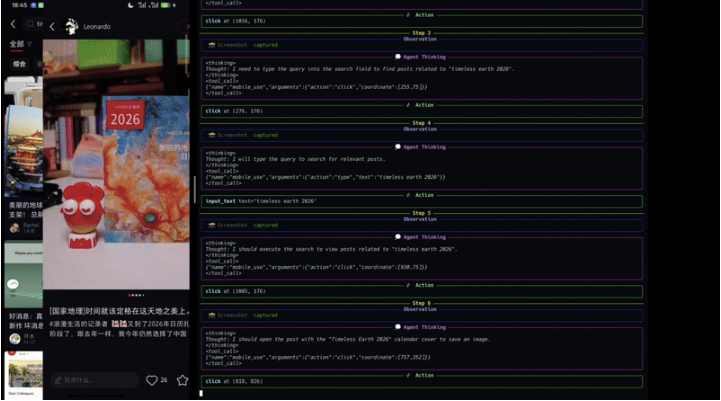

阿里通义实验室推出开源项目MAI-UI,旨在实现AI对手机的直接操控。该项目在GUI定位和任务执行方面表现出色,能够识别屏幕内容并完成复杂操作。MAI-UI支持多种参数变体,具备主动询问用户信息和与外部应用集成的能力,适应动态环境。目前已开源2B和8B版本,用户可通过GitHub获取体验。

🎯

关键要点

- 阿里通义实验室推出开源项目MAI-UI,旨在实现AI对手机的直接操控。

- MAI-UI在GUI定位和任务执行方面表现出色,超越了Gemini-3-Pro和Seed1.8。

- 项目包含多种参数变体,如2B、8B、32B和235B-A22B。

- MAI-UI具备高水平的屏幕识别能力和复杂任务执行能力。

- 在AndroidWorld基准测试中,MAI-UI创造了76.7%的成功率记录。

- MAI-UI设计了原生人机互动机制,能主动询问用户信息。

- 通过MCP工具,MAI-UI能够与外部应用和真实世界数据深度集成。

- 独创的设备-云混合协作架构,智能决定任务处理方式。

- MAI-UI通过在线强化学习框架不断进化,适应动态环境。

- 目前已开源2B和8B版本,用户可通过GitHub获取体验。

❓

延伸问答

MAI-UI的主要功能是什么?

MAI-UI能够识别手机屏幕内容并完成复杂操作,支持主动询问用户信息和与外部应用集成。

MAI-UI与其他AI模型相比有什么优势?

MAI-UI在GUI定位和任务执行方面表现优越,成功率超过Gemini-3-Pro和Seed1.8。

如何获取和使用MAI-UI?

用户可以通过GitHub克隆MAI-UI的2B和8B版本,并按照说明启动API服务。

MAI-UI如何处理复杂任务?

MAI-UI通过原生人机互动机制和MCP工具,能够主动询问用户并与外部应用深度集成。

MAI-UI的成功率如何?

在AndroidWorld基准测试中,MAI-UI创造了76.7%的成功率记录。

MAI-UI的设计理念是什么?

MAI-UI旨在打破AI助手的局限,使其能够直接操控手机并适应动态环境。

➡️