💡

原文中文,约6800字,阅读约需16分钟。

📝

内容提要

Google发布了开放模型Gemma 2,提供9B和27B两种参数规模的选择,支持8192 tokens的上下文长度。用户可以在Hugging Face和Kaggle上免费获取模型权重,并通过多种主流框架进行模型部署。Gemma 2还支持模型的fine-tuning,与主流训练框架完全兼容。Google Cloud提供高级解决方案,帮助用户大规模、自动化地训练开放模型。

🎯

关键要点

- Google发布了开放模型Gemma 2,提供9B和27B两种参数规模的选择。

- Gemma 2支持8192 tokens的上下文长度,使用旋转位置编码(RoPE)。

- 用户可以在Hugging Face和Kaggle上免费获取模型权重。

- Gemma 2支持多种主流框架的模型部署,包括Hugging Face Transformers、Keras NLP、Pytorch等。

- 用户可以选择本地或云端部署Gemma 2模型,建议先下载到本地以提高效率。

- Gemma 2支持模型的fine-tuning,用户可以利用私有数据进行微调。

- fine-tuning方式包括全参数微调、Lora微调和QLora微调。

- 全参数微调需要重新训练所有参数,Lora和QLora则通过低秩矩阵和量化处理提高效率。

- 演示中使用对话数据集对Gemma 2-27B进行fine-tuning,观察模型训练效果。

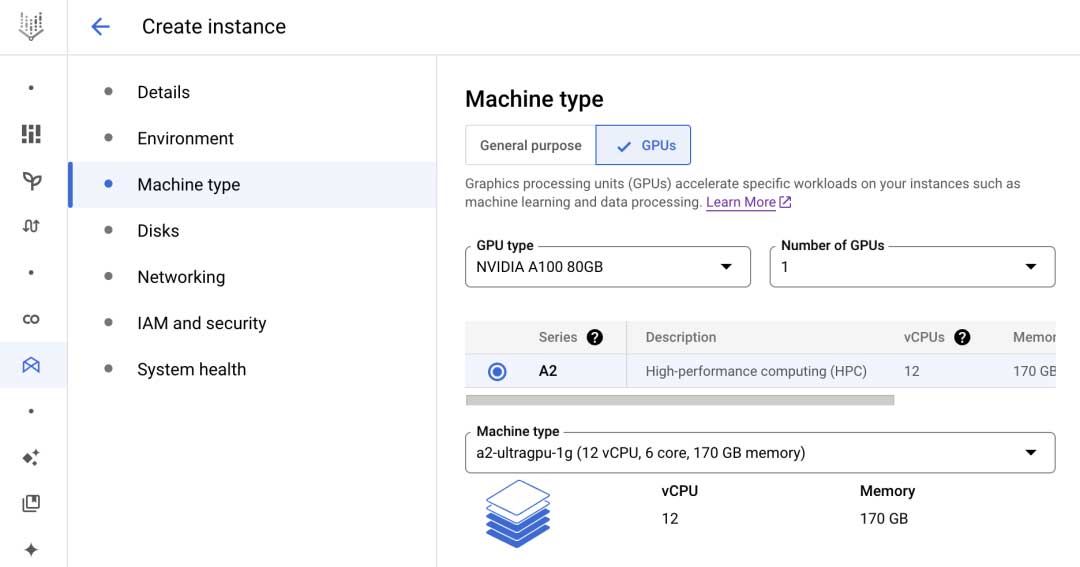

- Google Cloud提供Vertex AI Workbench,支持企业级Jupyter Notebook服务,便于模型训练和监控。

- 训练任务通过Deepspeed框架实现分布式训练,使用Hugging Face SFTTrainer进行模型训练。

- 训练结束后,模型能够生成更加流畅自然的对话。

- Google Cloud还提供高级解决方案,帮助用户大规模、自动化地训练开放模型。

❓

延伸问答

Gemma 2模型有哪些参数规模可供选择?

Gemma 2模型提供9B和27B两种参数规模的选择。

如何获取Gemma 2模型的权重?

用户可以在Hugging Face和Kaggle上免费获取Gemma 2模型的权重。

Gemma 2支持哪些主流框架进行模型部署?

Gemma 2支持Hugging Face Transformers、Keras NLP、Pytorch等多种主流框架进行模型部署。

Gemma 2的fine-tuning方式有哪些?

Gemma 2的fine-tuning方式包括全参数微调、Lora微调和QLora微调。

如何在Google Cloud上进行Gemma 2的模型训练?

用户可以通过Vertex AI Workbench创建实例,使用Hugging Face SFTTrainer和Deepspeed框架进行Gemma 2的模型训练。

Gemma 2的上下文长度是多少?

Gemma 2支持8192 tokens的上下文长度。

➡️