💡

原文英文,约1100词,阅读约需4分钟。

📝

内容提要

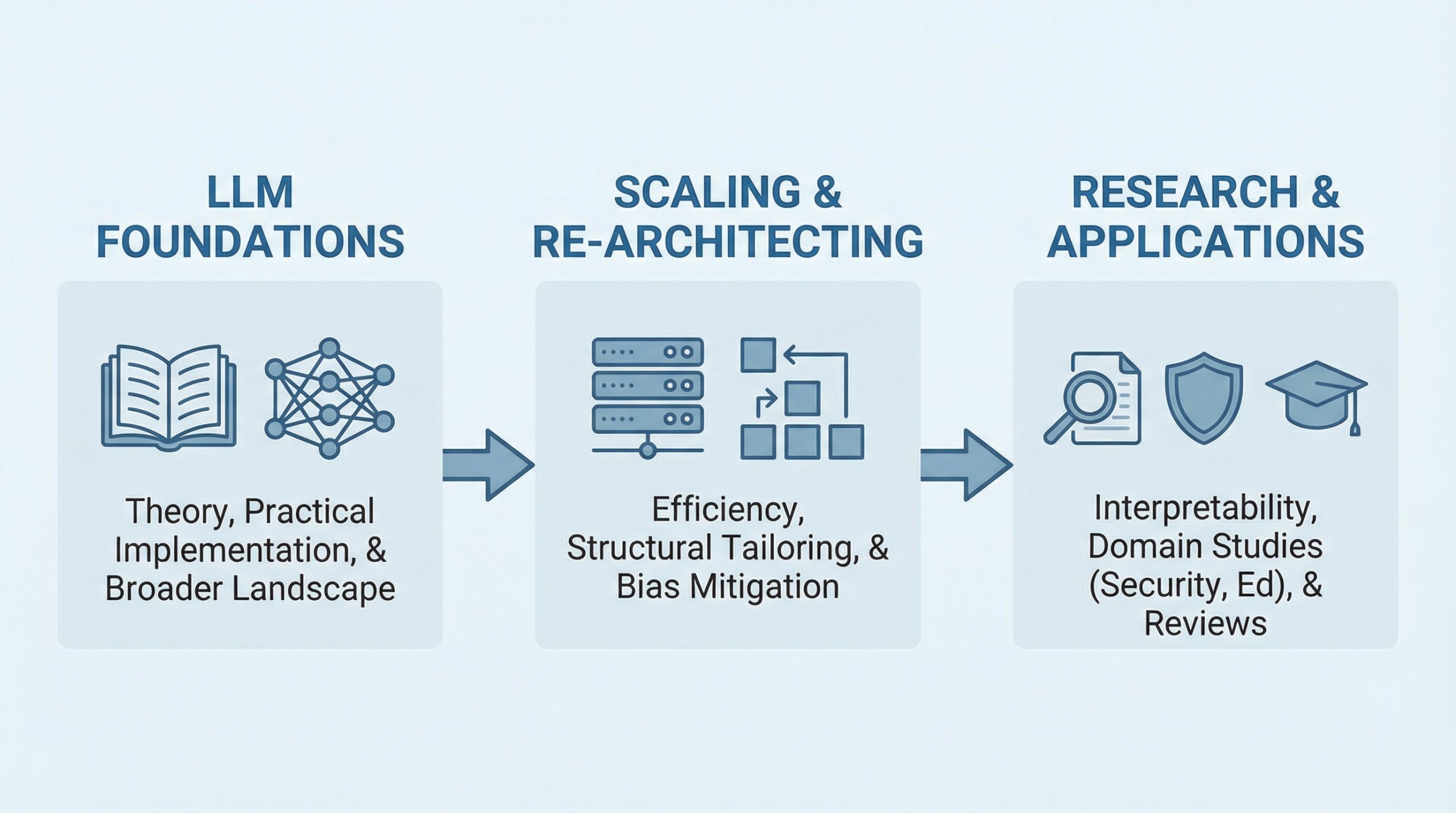

本文为2026年大型语言模型(LLMs)初学者提供阅读清单,涵盖基础概念、扩展与重构方法及应用实例。推荐资源包括《大型语言模型基础》电子书、Pere Martra的实践课程和Dan Jurafsky的《语音与语言处理》。此外,讨论了模型的可扩展性和重构技术,帮助读者深入理解LLMs。

🎯

关键要点

- 本文为2026年大型语言模型(LLMs)初学者提供阅读清单,涵盖基础概念、扩展与重构方法及应用实例。

- 推荐资源包括《大型语言模型基础》电子书、Pere Martra的实践课程和Dan Jurafsky的《语音与语言处理》。

- 文章分为三个部分:概念与实践基础、LLMs的扩展与重构、重要研究与应用导向文本。

- 概念与实践基础部分强调了Tong Xiao和Jingbo Zhu的电子书、Pere Martra的课程和Dan Jurafsky的书籍。

- 扩展与重构部分讨论了可扩展性和重构技术的重要性,推荐了Google DeepMind的资源和Pere Martra的新书。

- 最后,文章提到了一些研究导向的文本,探讨了LLMs在网络安全和教育等领域的应用。

❓

延伸问答

2026年大型语言模型初学者应该阅读哪些书籍?

推荐阅读《大型语言模型基础》电子书、Pere Martra的实践课程和Dan Jurafsky的《语音与语言处理》。

大型语言模型的扩展与重构有什么重要性?

扩展与重构有助于构建可扩展的模型,并适应特定需求或应对挑战。

如何获取大型语言模型的基础知识?

可以通过阅读Tong Xiao和Jingbo Zhu的电子书以及Pere Martra的课程来获取基础知识。

大型语言模型在教育领域的应用有哪些?

大型语言模型在学习环境中有广泛应用,相关研究提供了全面的回顾。

有哪些资源可以帮助理解大型语言模型的可扩展性?

Google DeepMind的《如何扩展你的模型》是一个重要的资源,涵盖了多种实用方面。

大型语言模型的偏见问题如何解决?

可以通过优化内部神经元激活和使用修剪等策略来应对偏见问题。

➡️