💡

原文中文,约16800字,阅读约需40分钟。

📝

内容提要

本文介绍了在Kubernetes中调度和使用GPU资源的方法,包括准备GPU环境、在Docker容器中使用GPU资源以及在Kubernetes集群中调度GPU资源。通过这些方法,用户可以充分利用GPU资源进行深度学习等任务。

🎯

关键要点

-

GPU 在人工智能和深度学习中变得越来越重要。

-

在 Kubernetes 中调度和使用 GPU 资源需要准备相应的环境。

-

可以通过阿里云的共享型 GPU 实例进行实验,价格便宜。

-

安装 NVIDIA 驱动时需注意实例规格,计算型实例需要手动安装驱动。

-

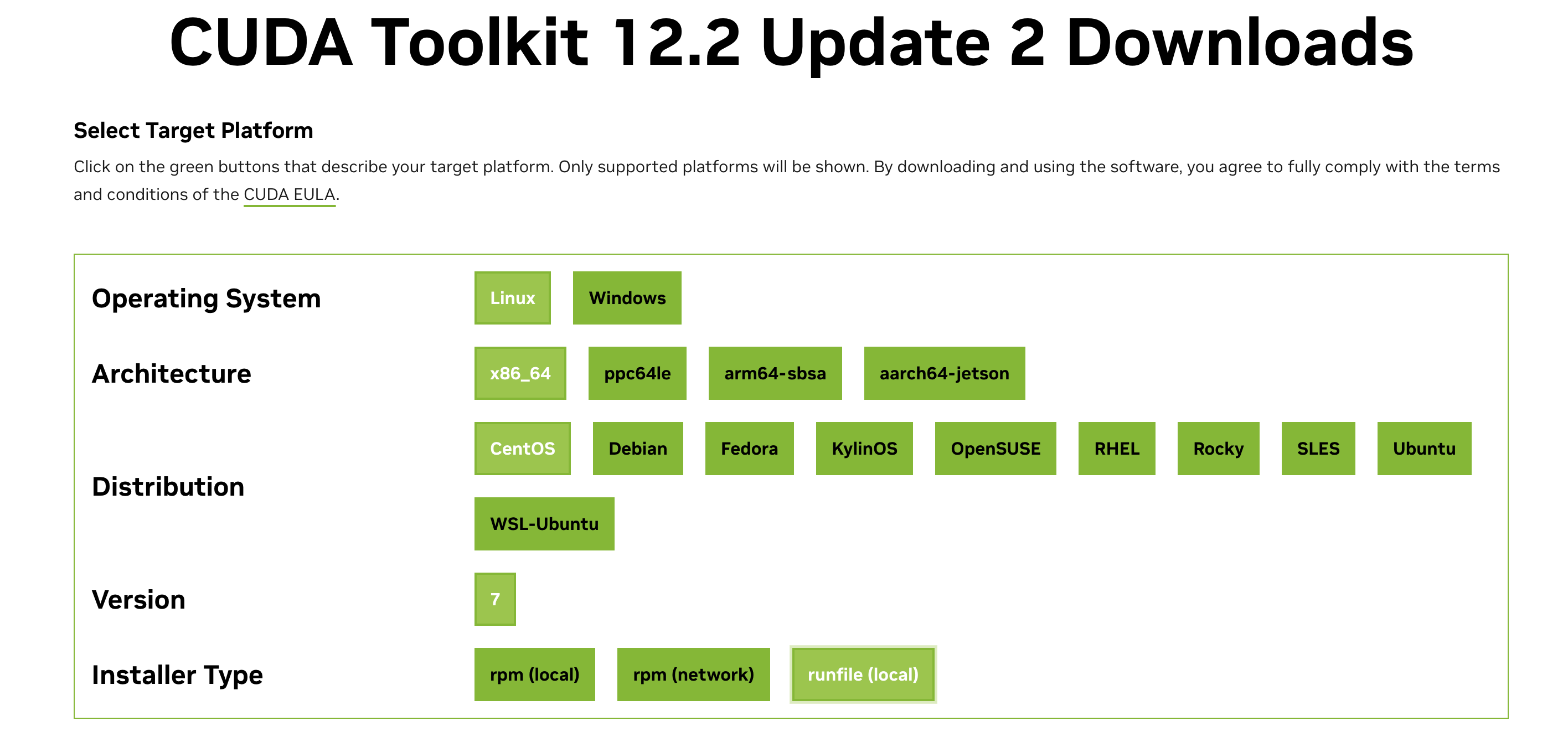

CUDA 是 NVIDIA 提供的并行计算平台,通常与 NVIDIA 驱动一起安装。

-

在 Docker 容器中使用 GPU 资源需要安装 nvidia-container-runtime 运行时。

-

Docker 19.03 版本后支持 --gpus 参数,可以方便地在容器中使用 GPU。

-

在 Kubernetes 中调度 GPU 资源需要安装 nvidia-container-runtime 和 NVIDIA 设备插件。

-

NVIDIA 设备插件可以管理和调度容器中的 GPU 资源。

-

创建 Pod 时需指定 GPU 资源的使用,Kubernetes 会根据可用资源调度 Pod。

➡️