💡

原文英文,约1800词,阅读约需7分钟。

📝

内容提要

AI工具面临新的安全挑战,尤其是“提示注入”攻击,这种攻击可能导致敏感信息泄露。为保护用户,OpenAI实施了多层防御措施,包括安全培训、监控和用户控制,以防止AI受到恶意指令的影响。

🎯

关键要点

- AI工具面临新的安全挑战,尤其是提示注入攻击,可能导致敏感信息泄露。

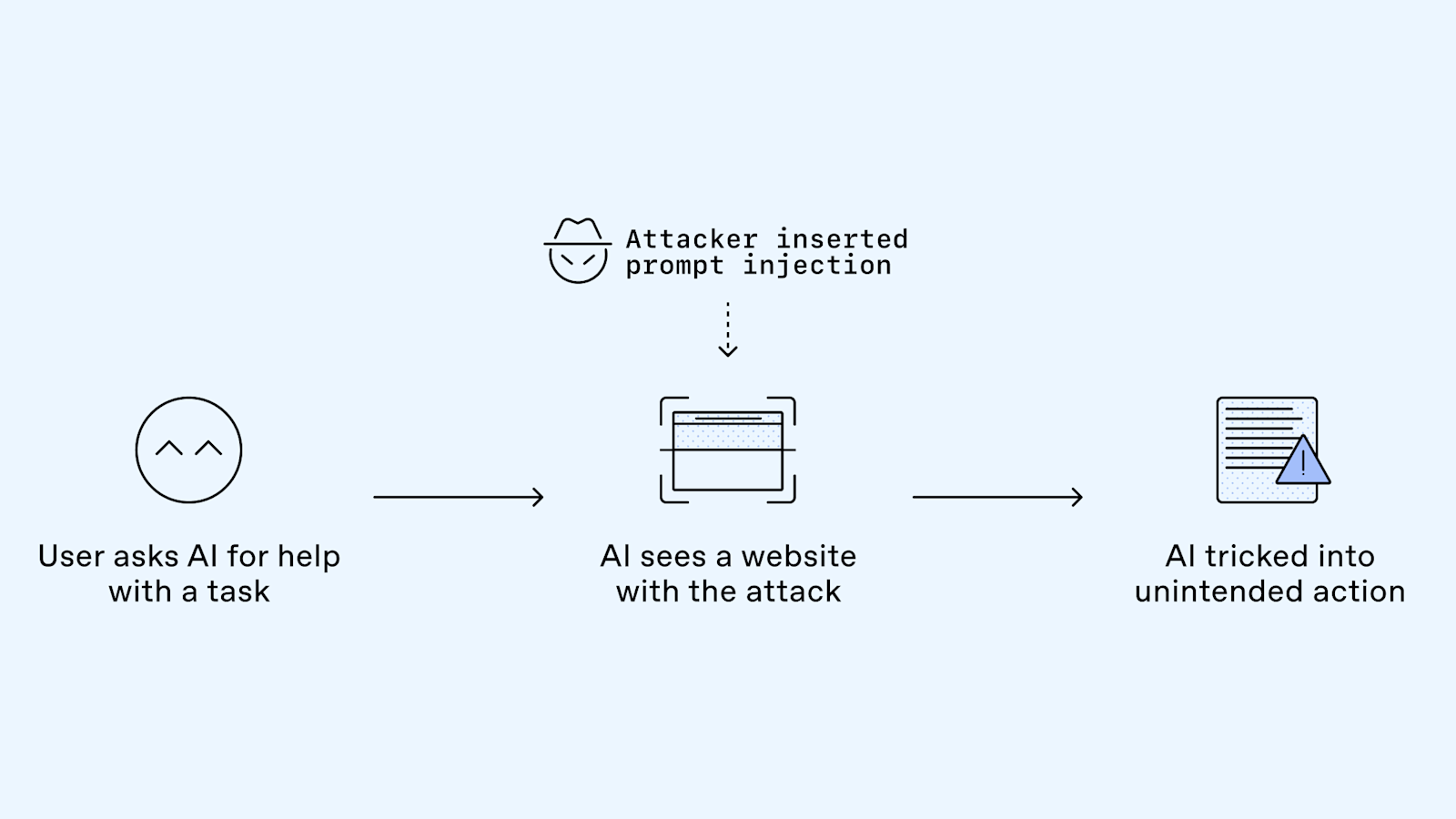

- 提示注入是一种针对对话AI的社会工程攻击,攻击者通过注入恶意指令误导AI。

- 随着AI访问更多敏感数据并承担更多任务,提示注入的风险增加。

- OpenAI采取多层防御措施来保护用户,包括安全培训、监控和用户控制。

- 安全培训旨在使AI识别提示注入并不受其影响,研究了指令层次结构以区分可信和不可信的指令。

- 监控系统能够快速识别和阻止提示注入攻击,保护用户数据。

- 产品和基础设施设计了多重安全保护措施,以保障用户数据安全。

- 用户控制功能允许用户在敏感操作前进行确认,增强安全性。

- 进行广泛的红队测试以模拟攻击者行为,发现并修复安全漏洞。

- 通过漏洞奖励计划鼓励独立安全研究人员发现新的提示注入技术。

- 教育用户使用某些功能的风险,以便他们做出明智的决策。

- 用户应采取措施保护自己,例如限制代理访问敏感数据和仔细检查代理的确认请求。

- 提示注入是一个持续演变的安全挑战,OpenAI将继续投资于安全研究和产品改进。

❓

延伸问答

什么是提示注入攻击?

提示注入是一种针对对话AI的社会工程攻击,攻击者通过注入恶意指令误导AI,可能导致敏感信息泄露。

OpenAI如何保护用户免受提示注入攻击?

OpenAI采取多层防御措施,包括安全培训、监控系统和用户控制功能,以保护用户数据安全。

提示注入攻击的风险如何增加?

随着AI访问更多敏感数据并承担更多任务,提示注入的风险随之增加。

用户可以采取哪些措施来保护自己?

用户应限制代理访问敏感数据,并仔细检查代理的确认请求,以增强安全性。

OpenAI如何进行安全漏洞测试?

OpenAI进行广泛的红队测试,以模拟攻击者行为,发现并修复安全漏洞。

提示注入攻击的未来趋势是什么?

提示注入仍然是一个持续演变的安全挑战,OpenAI将继续投资于安全研究和产品改进,以应对新出现的攻击。

➡️