💡

原文中文,约1700字,阅读约需4分钟。

📝

内容提要

MinMo模型通过多阶段训练结合语音和文本,显著提升了语音理解和生成能力,尤其在多语言和情感识别方面表现优于现有模型。该模型拥有约80亿参数,响应延迟约600毫秒,为未来研究设定了新基准。

🎯

关键要点

- MinMo模型通过多阶段训练结合语音和文本,提升语音理解和生成能力。

- MinMo在多语言和情感识别方面表现优于现有模型。

- 该模型拥有约80亿参数,响应延迟约600毫秒。

- 当前语音交互系统面临语音和文本序列差异、有限预训练等挑战。

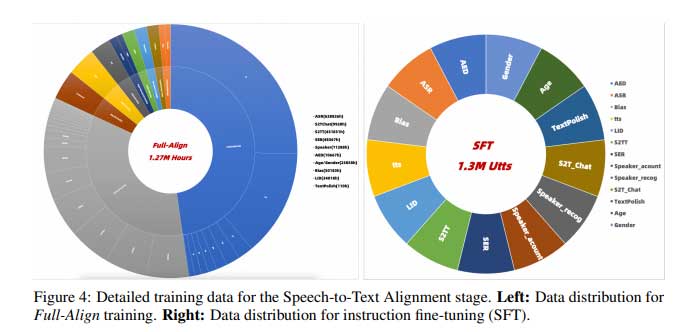

- MinMo在140万小时的语音数据上进行训练,避免了文本LLM功能的灾难性遗忘。

- MinMo无缝集成语音和文本,增强了情感识别、说话人分析和多语言语音识别功能。

- 模型采用AR流式Transformer语音解码器,提高性能并减少延迟。

- 在多个基准测试中,MinMo表现优于大多数模型,尤其在多语言语音识别任务中。

- MinMo在语音转文本增强、语音情感识别和音频事件理解方面表现出色。

- 尽管在语音转语音任务中表现有所下降,但在对话任务和逻辑推理方面表现良好。

- MinMo为自然语音交互设定了新的基准,未来可集中在改进发音处理和开发完全集成的系统上。

❓

延伸问答

MinMo模型的主要特点是什么?

MinMo模型结合了语音和文本,通过多阶段训练提升了语音理解和生成能力,拥有约80亿参数,响应延迟约600毫秒。

MinMo在多语言和情感识别方面的表现如何?

MinMo在多语言和情感识别方面表现优于现有模型,尤其在多语言语音识别任务中取得了最佳性能。

MinMo是如何解决语音交互中的挑战的?

MinMo通过多阶段训练和AR流式Transformer语音解码器,克服了语音和文本序列差异及灾难性遗忘等挑战。

MinMo在语音转文本和语音生成方面的表现如何?

MinMo在语音转文本增强和语音生成方面表现出色,尤其在语音情感识别和音频事件理解任务中。

MinMo模型的训练数据量有多大?

MinMo在超过140万小时的语音数据上进行训练,以提高其语音理解和生成能力。

未来MinMo的发展方向是什么?

未来的发展可以集中在改进发音处理和开发完全集成的系统上,以进一步提升自然语音交互的能力。

➡️