💡

原文英文,约1500词,阅读约需6分钟。

📝

内容提要

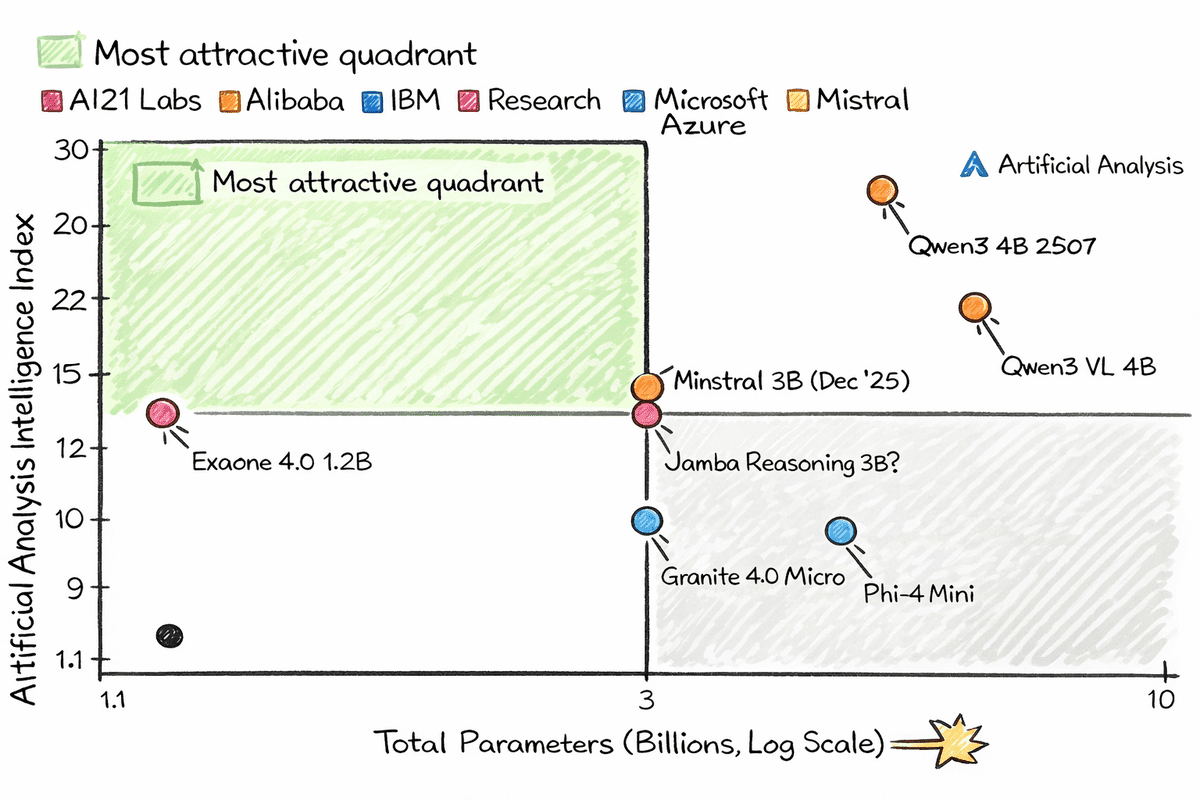

本文介绍了七种适合低功耗设备(如树莓派)的小型AI模型,这些模型体积小但性能强大,能够进行文本生成、视觉理解和工具调用。其中,Qwen3系列表现突出,适合本地AI实验,展示了小型AI的潜力。

🎯

关键要点

- 本文介绍了适合低功耗设备的小型AI模型,特别是树莓派。

- 现代架构和量化技术使得1到2亿参数的模型可以在小型设备上运行。

- 这些小型模型在文本生成、视觉理解和工具调用方面表现出色。

- Qwen3系列模型在指令跟随、逻辑推理和多语言支持方面表现突出。

- Qwen3-4B-Instruct-2507模型具有4亿参数,支持256K上下文长度,适合处理长文档。

- Qwen3-VL-4B-Instruct是先进的视觉语言模型,支持256K上下文,能够处理视频和图像。

- EXAONE 4.0 1.2B模型支持快速响应和复杂问题解决,适合低资源部署。

- Ministral-3-3B-Instruct-2512是高效的小型多模态语言模型,支持256K上下文窗口。

- Jamba-Reasoning-3B模型采用混合架构,支持长上下文处理,适合移动设备。

- Granite-4.0-Micro模型专为企业级助手设计,支持128K上下文窗口和多语言。

- Phi-4-mini-instruct是轻量级的语言模型,支持128K上下文,强调推理能力。

- 小型模型的能力已不再受限于其大小,Qwen 3系列表现尤为突出。

- EXAONE 4.0和Ministral 3B模型在推理和通用性能方面也值得关注。

- 本地推理在小型硬件上已不再是妥协,许多模型表现令人印象深刻。

❓

延伸问答

哪些小型AI模型适合树莓派使用?

适合树莓派的小型AI模型包括Qwen3系列、EXAONE 4.0、Ministral 3B、Jamba Reasoning 3B、Granite 4.0 Micro和Phi-4 Mini。

Qwen3系列模型的特点是什么?

Qwen3系列模型在指令跟随、逻辑推理和多语言支持方面表现突出,具有高达256K的上下文长度,适合处理长文档。

EXAONE 4.0模型的优势是什么?

EXAONE 4.0模型支持快速响应和复杂问题解决,适合低资源部署,并具备多语言能力。

Ministral 3B模型适合什么样的应用场景?

Ministral 3B模型适合边缘计算和低资源部署,特别是在实时聊天和指令跟随任务中表现出色。

Jamba Reasoning 3B模型的创新之处在哪里?

Jamba Reasoning 3B模型采用混合Transformer-Mamba架构,能够高效处理长上下文,且在智能基准测试中表现优异。

小型AI模型在性能上是否受到限制?

小型AI模型的能力已不再受限于其大小,许多模型在性能上与大型模型相当,尤其是Qwen 3系列。

➡️