💡

原文英文,约600词,阅读约需2分钟。

📝

内容提要

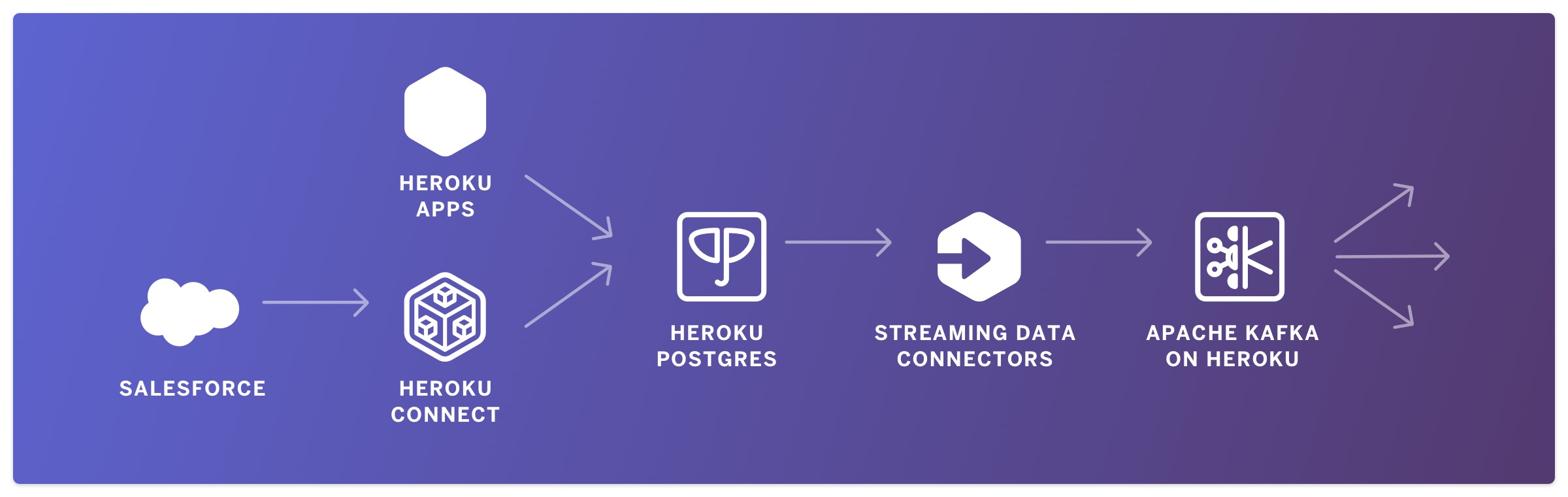

Heroku发布了Postgres与Apache Kafka的流数据连接器,支持Private和Shield Spaces客户。该连接器实时监控Postgres表的变更,并将数据传输至Kafka,助力开发者构建微服务架构和数据湖。

🎯

关键要点

- Heroku发布了Postgres与Apache Kafka的流数据连接器,支持Private和Shield Spaces客户。

- 该连接器实时监控Postgres表的变更,并将数据传输至Kafka。

- 开发者希望在Postgres和Kafka之间实现无缝集成,避免完全重写应用程序。

- Heroku Data团队认为数据使用案例日益复杂,单一数据库技术无法解决所有问题。

- Apache Kafka是新兴数据架构的关键技术。

- Heroku CDC通过监控Postgres表的写入、更新和删除,实现轻松的数据变更捕获。

- 使用Kafka Connect和Debezium将静态数据转化为动态数据。

- 连接器是完全托管的,提供简单而强大的用户体验。

- 用户可以通过CLI插件创建连接器,指定Postgres源和Kafka存储。

- 连接器自动将Heroku Postgres的变更流式传输到Apache Kafka。

- 用户可以利用该连接器重构单体应用为微服务,实施事件驱动架构,构建数据湖等。

- Heroku欢迎用户反馈和功能请求。

❓

延伸问答

Heroku的流数据连接器有什么功能?

Heroku的流数据连接器可以实时监控Postgres表的变更,并将数据传输至Apache Kafka。

如何在Heroku上创建Postgres与Kafka的连接器?

用户可以通过CLI插件使用命令创建连接器,指定Postgres源和Kafka存储,并选择要包含的表。

这个连接器支持哪些客户?

该连接器支持Heroku的Private Spaces和Shield Spaces客户。

使用这个连接器有什么好处?

使用该连接器可以实现Postgres与Kafka的无缝集成,帮助开发者重构单体应用为微服务,实施事件驱动架构。

Heroku CDC是如何工作的?

Heroku CDC通过监控Postgres表的写入、更新和删除,将每个变更写入Apache Kafka主题,实现数据变更捕获。

为什么开发者需要将Postgres与Kafka集成?

开发者希望通过集成实现更复杂的数据架构,避免完全重写应用程序,以适应日益复杂的数据使用案例。

➡️