内容提要

谷歌发布的Gemma 4开源模型在视觉理解和代码生成方面表现优异,尤其是26B版本。尽管小模型在视觉处理上有所欠缺,但在文本理解和代码生成方面依然表现良好,突显了表达能力在AI应用中的重要性。

关键要点

-

谷歌发布的Gemma 4开源模型在视觉理解和代码生成方面表现优异,尤其是26B版本。

-

小模型在视觉处理上有所欠缺,但在文本理解和代码生成方面表现良好,突显了表达能力在AI应用中的重要性。

-

Gemma 4是一次架构级跃迁,打破了大模型=大参数的传统认知。

-

Gemma 4采用Apache 2.0协议,完全免费商用,支持多模态功能。

-

测试使用的Gemma 4 26B模型适合在消费级显卡上运行,参数量为252亿。

-

测试环境配置为Intel i5-13600K CPU和NVIDIA GeForce RTX 4070 Ti GPU。

-

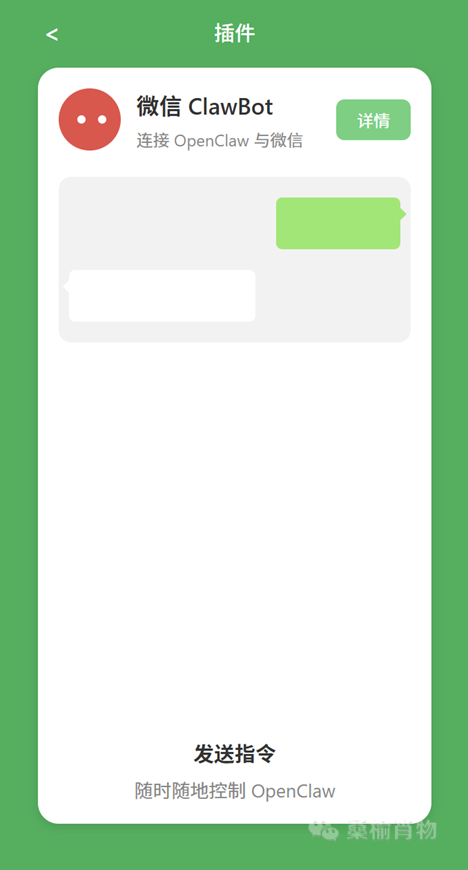

Gemma 4在视觉理解和代码生成任务中表现出色,能够准确还原设计元素。

-

与Qwen 3.5的对比显示,Gemma 4在速度上更具优势,但细节处理上稍逊一筹。

-

小模型在视觉任务上表现不佳,主要原因是视觉编码器参数量较少。

-

Gemma 4的视觉能力强大,尤其是26B A4B版本,强调了表达能力的重要性。

延伸问答

Gemma 4模型的主要特点是什么?

Gemma 4模型在视觉理解和代码生成方面表现优异,尤其是26B版本,采用Apache 2.0协议,完全免费商用,并支持多模态功能。

Gemma 4与Qwen 3.5相比有什么优势?

Gemma 4在速度上更具优势,但在细节处理上稍逊于Qwen 3.5。

Gemma 4的视觉编码器参数量是多少?

Gemma 4的视觉编码器参数量约为5.5亿。

小模型在视觉处理上表现不佳的原因是什么?

小模型在视觉处理上表现不佳,主要是因为其视觉编码器的参数量较少。

Gemma 4的测试环境配置是什么?

测试环境配置为Intel i5-13600K CPU和NVIDIA GeForce RTX 4070 Ti GPU。

Gemma 4的上下文支持能力如何?

Gemma 4支持最高256K的上下文,能够轻松应对整本手册或大型代码库。