💡

原文中文,约1800字,阅读约需5分钟。

📝

内容提要

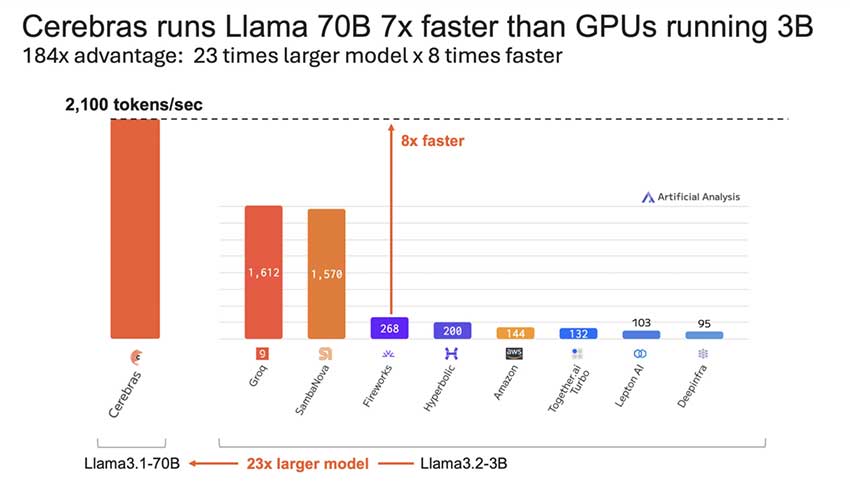

Cerebras Systems 实现了推理速度提升三倍,使用 Llama 3.1-70B 模型每秒处理 2,100 个 Token,速度比最快 GPU 快 16 倍。通过优化算法和异步计算,显著提升了 AI 在医疗和实时通信等领域的应用效率。

🎯

关键要点

- Cerebras Systems 实现推理速度提升三倍,使用 Llama 3.1-70B 模型每秒处理 2,100 个 Token。

- Cerebras 的速度比目前最快的 GPU 快 16 倍,性能飞跃类似于 GPU 技术的一代升级。

- Cerebras 的速度提升不仅适用于大型模型,小型模型的速度也显著提高。

- 技术创新包括优化矩阵乘法、异步晶圆 I/O 计算和高级推测解码,确保速度提升不损害模型准确性。

- Cerebras 的推理速度提升对医疗、娱乐和实时通信等领域的应用具有深远影响。

- 葛兰素史克表示,Cerebras 的进步使药物发现过程更快、更有效。

- LiveKit 平台的性能显著提升,实现了实时语音和视频处理能力,推理步骤提高了多达 10 倍。

- Cerebras 通过软件和硬件优化,推动 AI 超越以前的极限,设定新的基准。

❓

延伸问答

Cerebras Systems 的推理速度提升了多少?

Cerebras Systems 的推理速度提升了三倍。

Cerebras 使用了哪个模型来实现速度提升?

Cerebras 使用了 Llama 3.1-70B 模型。

Cerebras 的速度比最快的 GPU 快多少倍?

Cerebras 的速度比目前最快的 GPU 快 16 倍。

Cerebras 的技术创新包括哪些方面?

技术创新包括优化矩阵乘法、异步晶圆 I/O 计算和高级推测解码。

Cerebras 的推理速度提升对哪些领域有影响?

推理速度提升对医疗、娱乐和实时通信等领域有深远影响。

Cerebras 如何确保速度提升不损害模型准确性?

Cerebras 保持了原始模型权重的 16 位精度,确保速度提升不损害准确性。

🏷️

标签

➡️