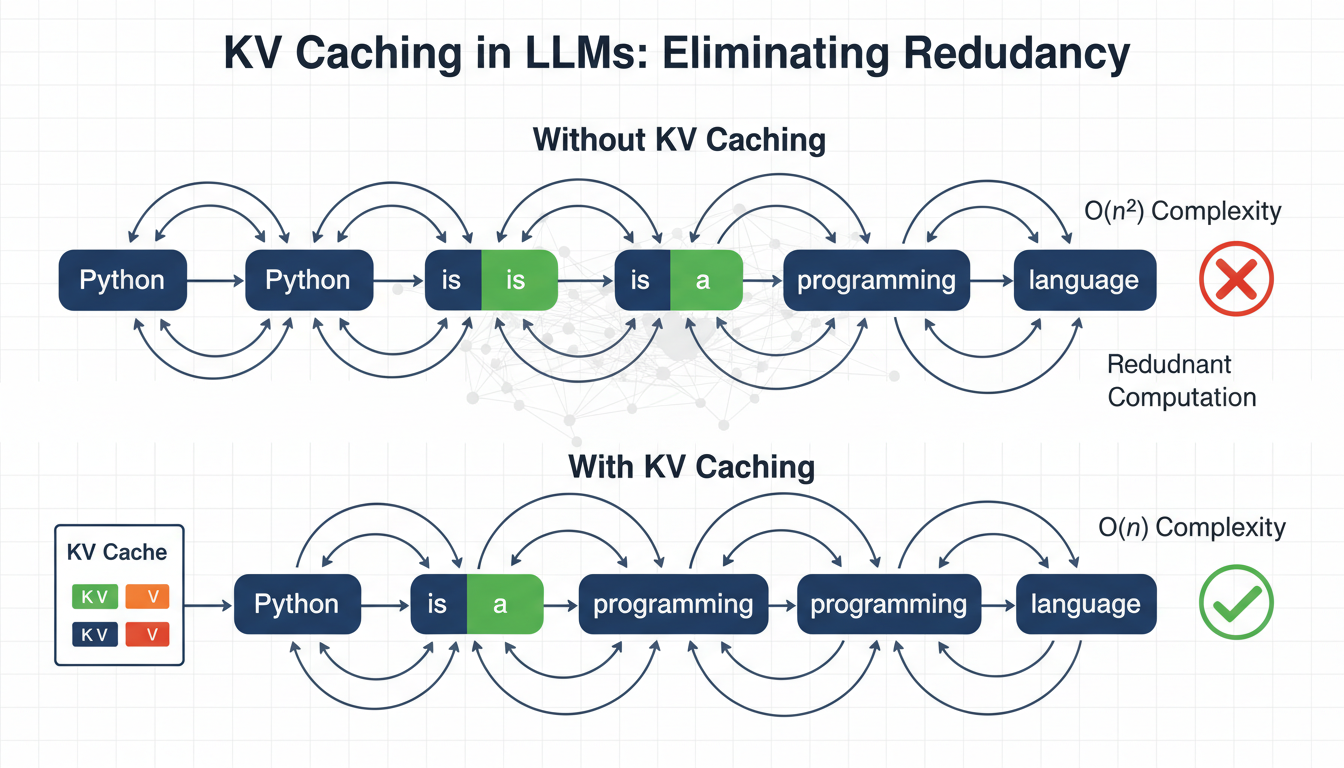

LLMs中的KV缓存:开发者指南

MachineLearningMastery.com

·

机器学习从业者的推测解码指南

MachineLearningMastery.com

·

将您的机器学习模型导出为ONNX格式

MachineLearningMastery.com

·

vLLM-Omni扩散缓存加速

vLLM Blog

·

SAM 3为现代视觉工作流程引入了更强大的分割架构

InfoQ

·

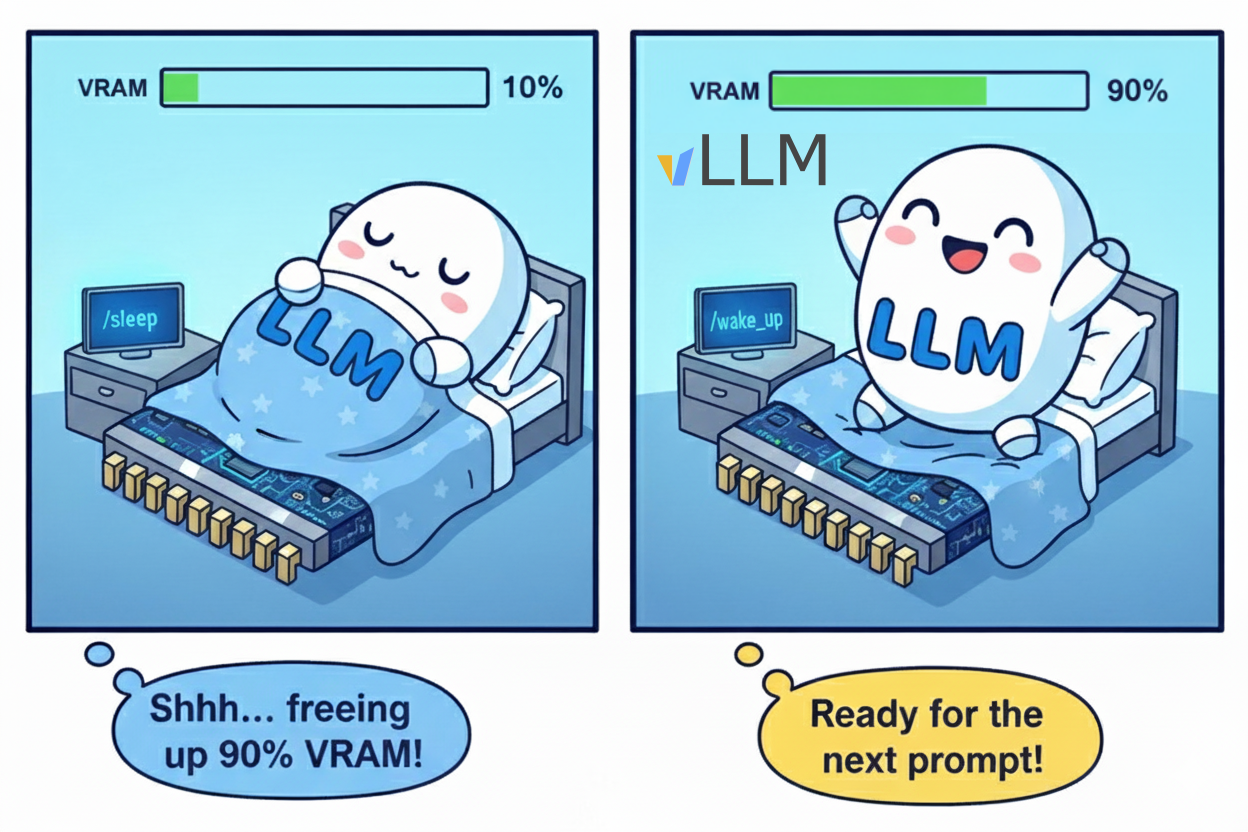

vLLM睡眠模式下的零重载模型切换

vLLM Blog

·