💡

原文英文,约2300词,阅读约需9分钟。

📝

内容提要

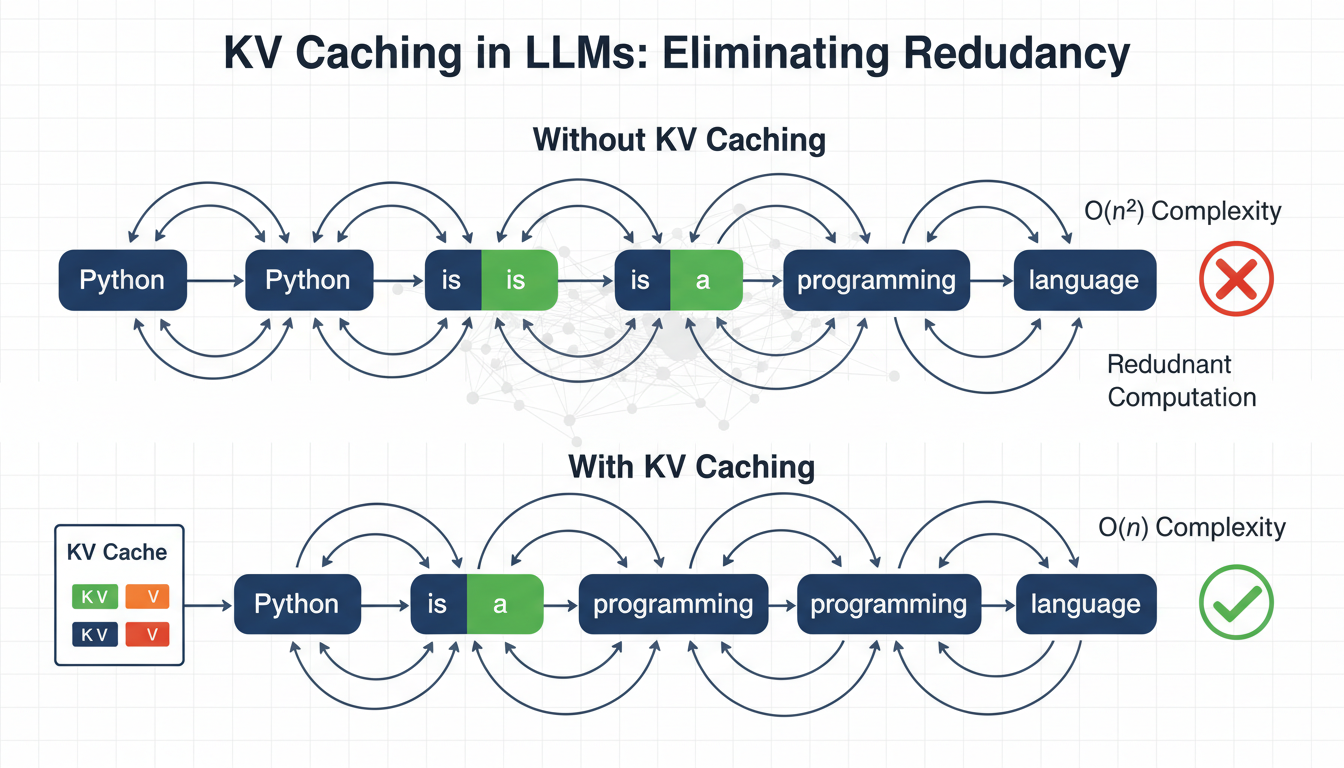

本文介绍了自回归变换器推理中键值(KV)缓存的作用,如何通过缓存已计算的键和值来消除冗余计算,从而显著提高生成速度,推理速度提升可达3-5倍。尽管内存使用增加,但在实际应用中,这种提升是值得的。理解KV缓存为进一步优化推理提供了基础。

🎯

关键要点

- 自回归生成的计算复杂度为O(n^2),每生成一个新token都需要重新处理所有之前的token。

- KV缓存通过缓存已计算的键和值,消除了冗余计算,从而显著提高生成速度,推理速度提升可达3-5倍。

- 在推理过程中,只有当前token的查询(Q)会变化,而之前token的键(K)和值(V)可以被缓存并重用。

- KV缓存的实现需要在注意力层中维护缓存状态,只有新token的K和V会被计算并添加到缓存中。

- KV缓存解决了自回归文本生成中的一个基本限制,显著加快了大语言模型的推理速度,尽管内存使用增加,但在实际应用中这种提升是值得的。

❓

延伸问答

KV缓存如何提高自回归生成的速度?

KV缓存通过缓存已计算的键和值,消除了冗余计算,从而使推理速度提升可达3-5倍。

自回归生成的计算复杂度是什么?

自回归生成的计算复杂度为O(n^2),每生成一个新token都需要重新处理所有之前的token。

KV缓存的实现需要注意哪些方面?

KV缓存的实现需要在注意力层中维护缓存状态,只有新token的K和V会被计算并添加到缓存中。

KV缓存的内存使用情况如何?

尽管KV缓存会增加内存使用,但在实际应用中,这种提升是值得的。

KV缓存如何解决自回归文本生成的限制?

KV缓存通过缓存之前token的键和值,避免了重复计算,从而显著加快了推理速度。

KV缓存的使用对生成文本的影响是什么?

KV缓存使得生成文本的过程更高效,计算量保持恒定,推理速度显著提升。

➡️