💡

原文中文,约14300字,阅读约需34分钟。

📝

内容提要

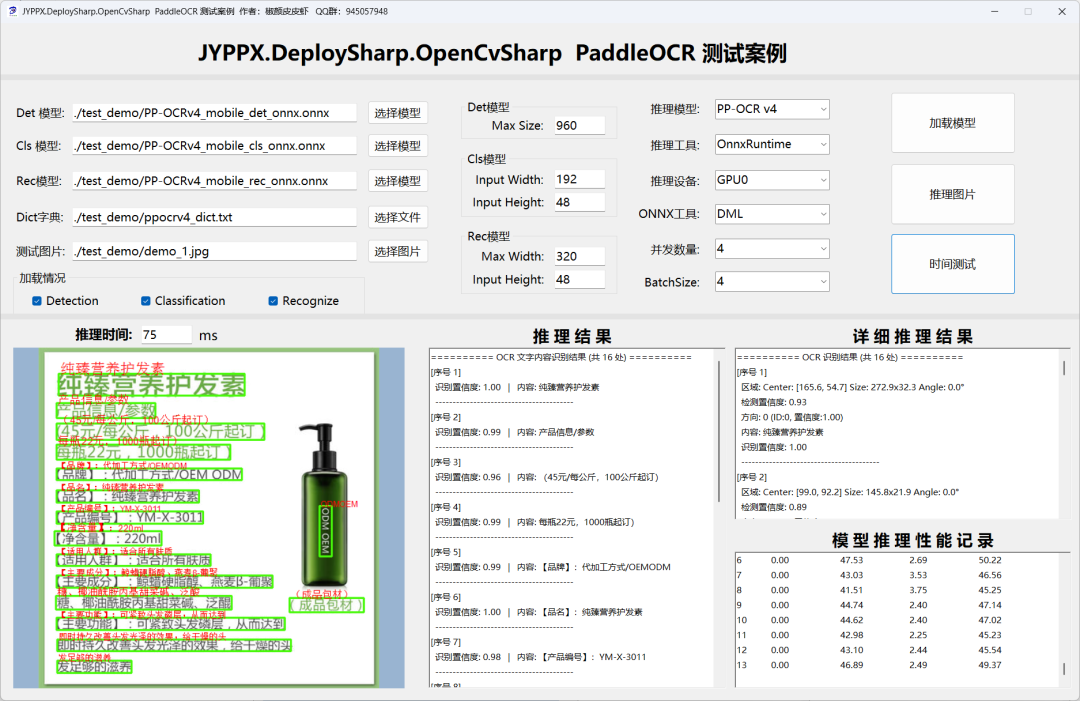

DeploySharp 0.0.8 版本升级,支持 PP-OCR v4/v5 模型,RTX 3060 上推理速度可达 23ms。该框架为 C# 开发者提供跨平台模型部署解决方案,集成 OpenVINO、TensorRT 和 ONNX Runtime,简化模型加载和推理,提高开发效率。

🎯

关键要点

- DeploySharp 0.0.8 版本升级,支持 PP-OCR v4/v5 模型,推理速度可达 23ms。

- DeploySharp 为 C# 开发者提供跨平台模型部署解决方案,集成 OpenVINO、TensorRT 和 ONNX Runtime。

- DeploySharp 设计思路清晰,模块化分层,支持多种推理引擎。

- 支持的推理引擎包括 OpenVINO、ONNX Runtime 和 TensorRT,适用于不同硬件配置。

- PP-OCR 是一种光学字符识别技术,支持文本检测、分类和识别。

- PP-OCR v4 和 v5 的主要区别在于精度和输入尺寸,v5 精度更高。

- DeploySharp 提供简单的配置方式,支持一键切换模型和推理引擎。

- 性能测试显示,RTX 3060 上的推理速度非常快,优化后可达 23ms。

- 提供了详细的案例演示和使用指南,方便开发者快速上手。

- DeploySharp 项目已开源,欢迎开发者参与和反馈。

❓

延伸问答

DeploySharp 0.0.8 版本有哪些新特性?

DeploySharp 0.0.8 版本支持 PP-OCR v4/v5 模型,推理速度可达 23ms,并集成了 OpenVINO、TensorRT 和 ONNX Runtime 三大推理引擎。

PP-OCR v4 和 v5 有什么区别?

PP-OCR v5 在精度上更高,输入尺寸为 80x160,而 v4 的输入尺寸为 48x192,速度和体积基本持平。

DeploySharp 如何支持多种推理引擎?

DeploySharp 通过统一接口设计,允许开发者在 OpenVINO、TensorRT 和 ONNX Runtime 之间自由切换,简化了模型加载和推理过程。

如何在 RTX 3060 上使用 DeploySharp 进行推理?

在 RTX 3060 上使用 DeploySharp 时,选择 TensorRT 或 ONNX Runtime,可以实现推理速度优化至 23ms。

DeploySharp 的开源许可证是什么?

DeploySharp 遵循 Apache 2.0 许可协议,允许开发者自由使用和修改。

如何快速开始使用 DeploySharp?

快速开始使用 DeploySharp 只需克隆项目、准备模型文件并修改代码中的模型路径,然后编译运行即可。

➡️