内容提要

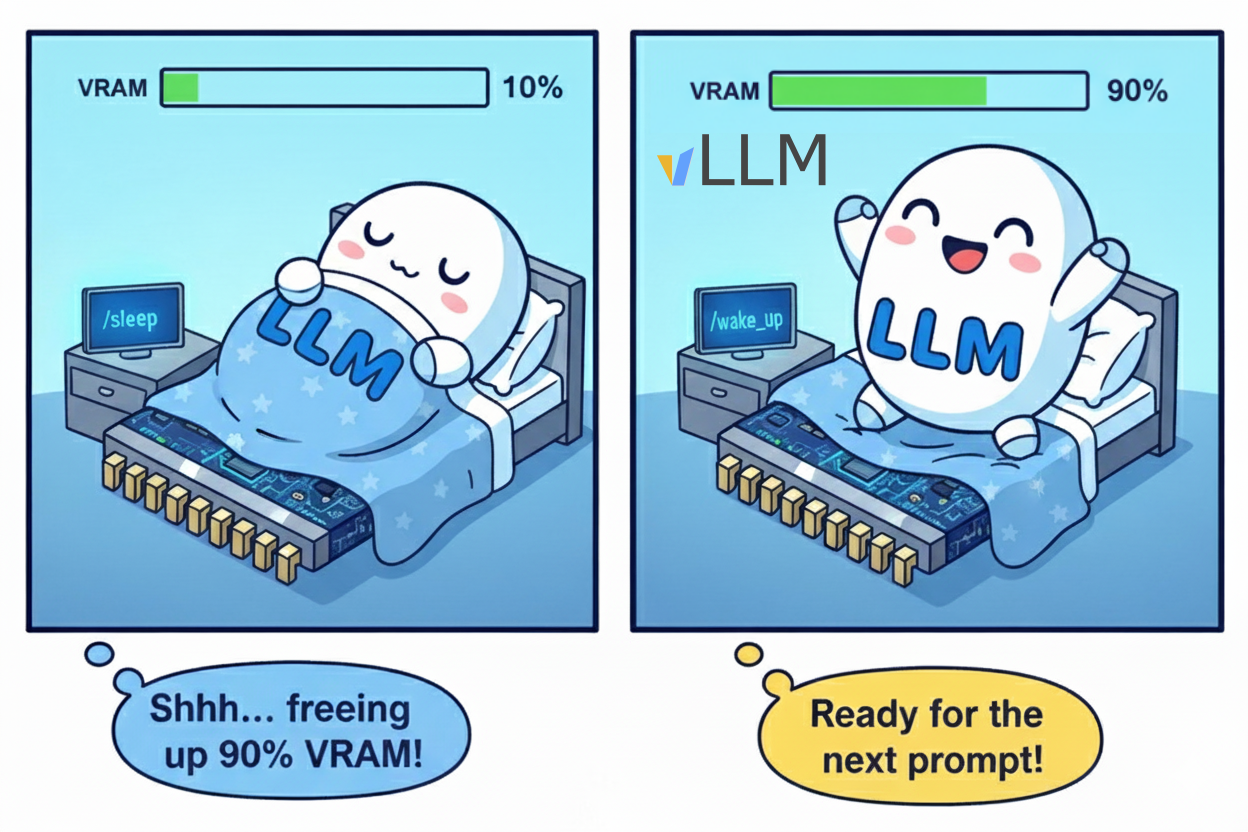

vLLM的睡眠模式通过提供两种睡眠级别,解决了多模型服务中的GPU内存问题,优化了模型切换速度和内存使用。该模式可在几秒内休眠并快速唤醒,显著提升推理速度和效率,避免了传统模型重载带来的高延迟和资源浪费。

关键要点

-

vLLM的睡眠模式通过提供两种睡眠级别,解决了多模型服务中的GPU内存问题。

-

传统解决方案需要在保持两个模型加载和按需重载之间做出权衡。

-

睡眠模式允许模型在几秒内休眠并快速唤醒,提升推理速度和效率。

-

睡眠模式分为两个级别:级别1将权重卸载到CPU RAM,级别2则完全丢弃权重。

-

睡眠模式比传统的快速权重加载更具优势,避免了冷启动的隐性成本。

-

保持进程活跃,睡眠模式保留了基础设施,避免了昂贵的重新初始化。

-

睡眠模式在不同模型大小和GPU上进行了全面基准测试,显示出显著的性能提升。

-

使用睡眠模式的快速启动指南包括如何启动vLLM服务器和管理模型的休眠与唤醒。

-

睡眠模式在模型切换时间上表现出色,唤醒模型的速度比冷启动快18-20倍。

-

在A4000 GPU上,睡眠模式同样有效,展示了在不同硬件和模型大小上的性能提升。

-

选择合适的睡眠级别取决于系统的CPU RAM容量和模型切换的频率。

-

级别1适合有足够CPU RAM的系统,级别2适合RAM有限或需要管理多个模型的情况。

-

睡眠模式在推理速度和模型切换时间上均显著优于无睡眠模式。

-

量化对睡眠模式的性能有影响,FP8量化在某些情况下提供了更快的唤醒时间。

-

vLLM睡眠模式将多模型GPU服务的重载时间从30-100秒缩短到亚秒级切换。

延伸问答

vLLM的睡眠模式如何解决GPU内存问题?

vLLM的睡眠模式通过提供两种睡眠级别,允许模型在几秒内休眠并快速唤醒,从而优化了内存使用和模型切换速度。

vLLM的睡眠模式与传统模型重载相比有哪些优势?

睡眠模式比传统的快速权重加载更具优势,避免了冷启动的隐性成本,推理速度提升61-88%。

如何选择适合的vLLM睡眠级别?

选择适合的睡眠级别取决于系统的CPU RAM容量和模型切换的频率,级别1适合有足够CPU RAM的系统,级别2适合RAM有限的情况。

vLLM睡眠模式的快速启动指南是什么?

快速启动指南包括启动vLLM服务器和管理模型的休眠与唤醒,具体命令可参考文档中的示例。

在不同GPU上使用vLLM睡眠模式的效果如何?

睡眠模式在不同GPU上进行了全面基准测试,显示出显著的性能提升,包括在A4000 GPU上的有效性。

vLLM睡眠模式如何影响推理速度?

使用睡眠模式时,推理速度显著优于无睡眠模式,模型在唤醒后已经预热,避免了冷启动的延迟。