vLLM的Rust前端PR了,预处理吞吐量直接翻了5倍!

迷途小书童

·

使用vLLM + Qwen3.5部署内网AI笔记

tlanyan

·

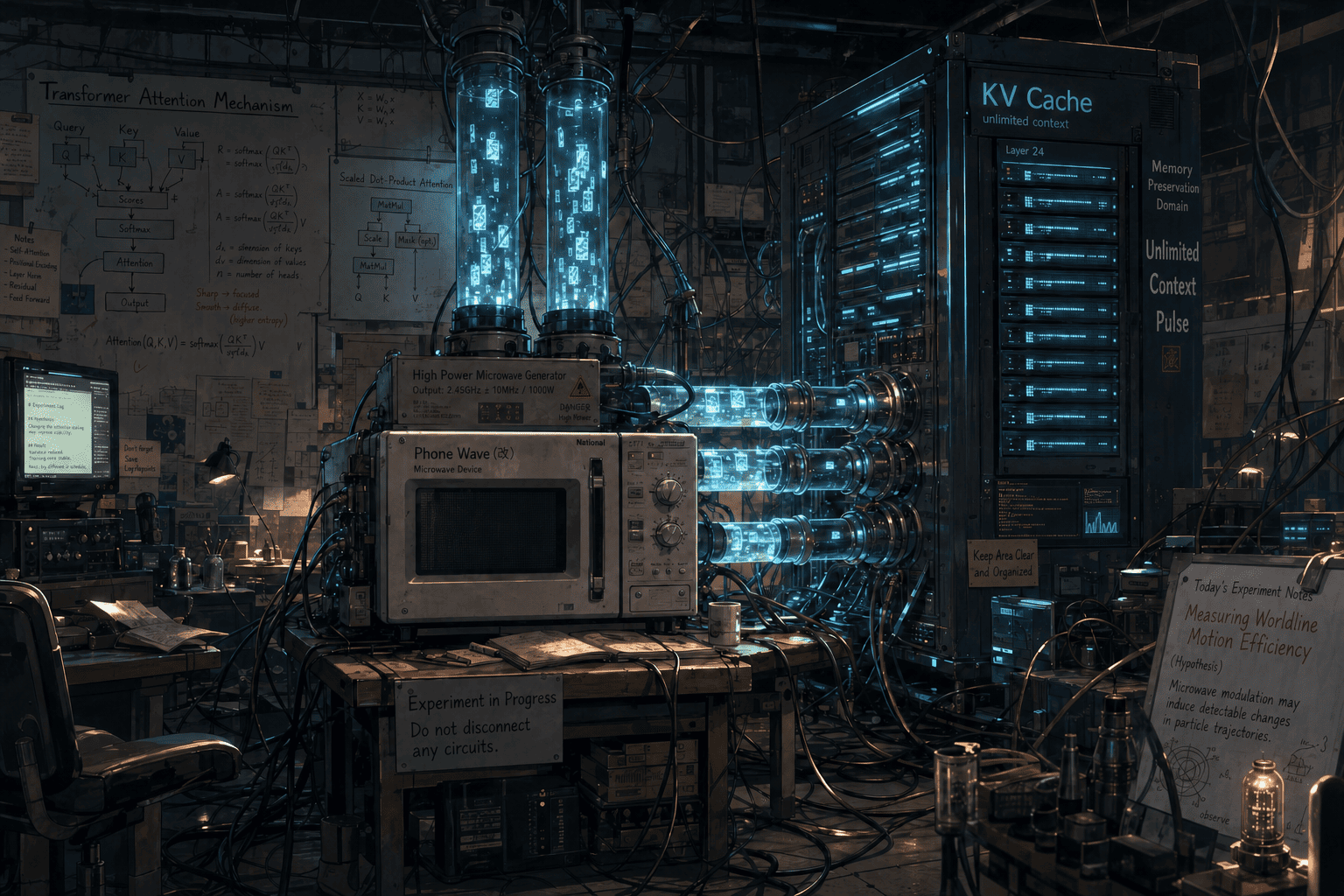

理解 KV Cache:Attention、P/D 分离与 vLLM 的页式显存管理

Steins;Lab

·

vLLM 部署 GLM-5 实践指南

探索云原生

·

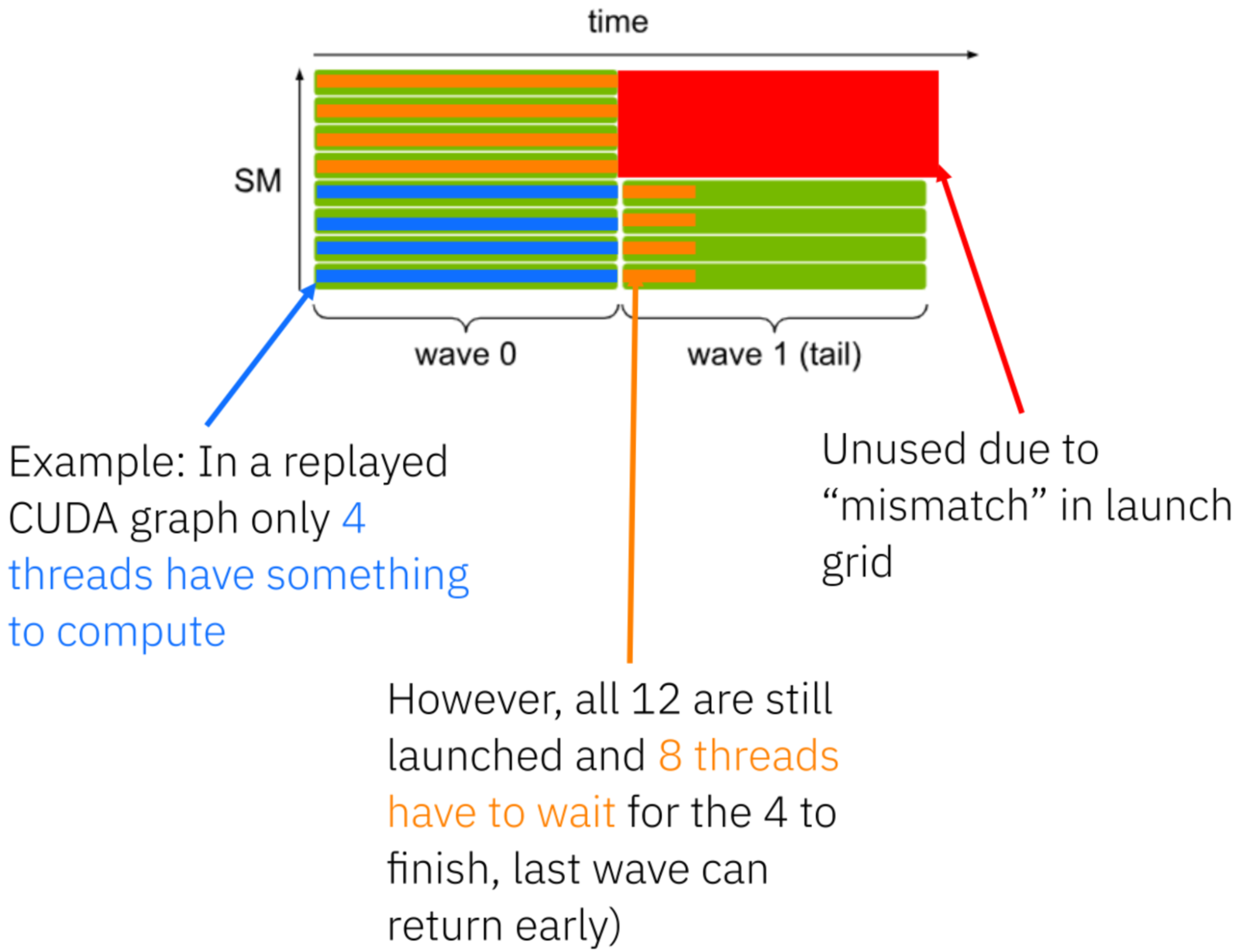

vLLM Triton 注意力后端深度解析

vLLM Blog

·

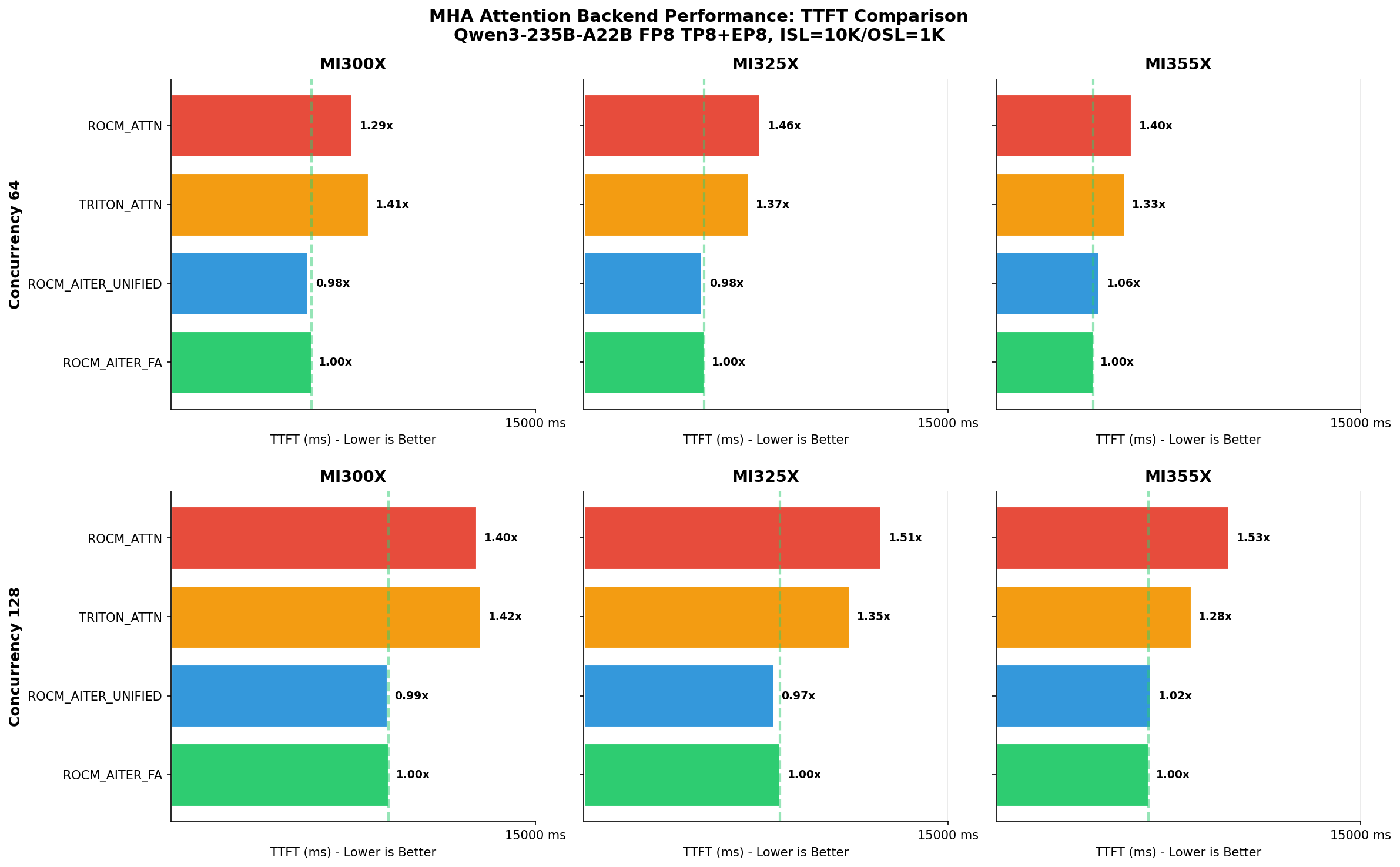

超越移植:vLLM如何在AMD ROCm上协调高性能推理

vLLM Blog

·