💡

原文中文,约1100字,阅读约需3分钟。

📝

内容提要

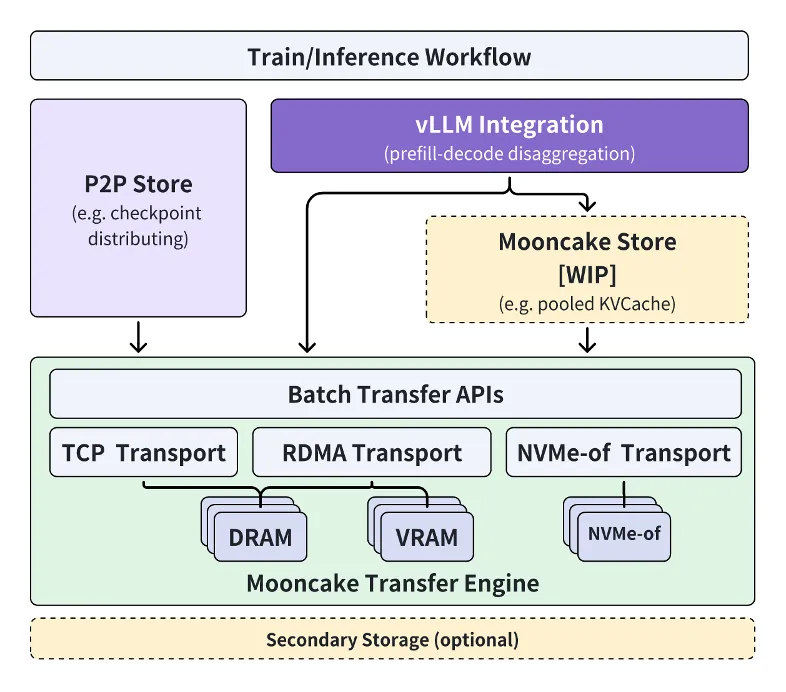

在大模型时代,推理系统面临高负载和成本挑战。月之暗面Kimi与清华大学联合发布的Mooncake推理系统,基于KVCache架构提升推理效率,并已开源,旨在为大模型提供高性能存储标准接口,推动行业发展。

🎯

关键要点

- 在大模型时代,推理系统面临高负载和成本挑战。

- 月之暗面Kimi与清华大学联合发布Mooncake推理系统,基于KVCache架构提升推理效率。

- Mooncake推理系统已开源,旨在为大模型提供高性能存储标准接口。

- 该系统通过以存换算的创新理念减少算力开销,显著提升推理吞吐量。

- 开源项目分阶段进行,逐步推出高性能KVCache多级缓存Mooncake Store的实现。

- 最终目标是为大模型时代打造新型高性能内存语义存储的标准接口。

- 月之暗面Kimi与清华大学的合作旨在推动行业向更高效的推理平台发展。

- 欢迎更多企业和研究机构加入Mooncake项目,共同探索模型推理系统架构创新。

❓

延伸问答

Mooncake推理系统的主要目标是什么?

Mooncake推理系统的主要目标是为大模型时代打造一种新型高性能内存语义存储的标准接口。

Kimi与清华大学的合作有什么意义?

Kimi与清华大学的合作旨在推动行业向更高效的推理平台发展,并共同探索模型推理系统架构的创新。

Mooncake推理系统如何提升推理效率?

Mooncake推理系统基于KVCache架构,通过以存换算的创新理念减少算力开销,显著提升推理吞吐量。

Mooncake开源项目的实施方式是什么?

Mooncake开源项目将采用分阶段的方式,逐步开源高性能KVCache多级缓存Mooncake Store的实现。

Mooncake推理系统的开源时间是什么时候?

Mooncake推理系统的开源时间是2024年11月28日。

Mooncake推理系统对用户体验有什么影响?

Mooncake推理系统提升了Kimi的用户体验,降低了成本,并为处理长文本和高并发需求提供了有效的解决方案。

➡️