💡

原文英文,约600词,阅读约需2分钟。

📝

内容提要

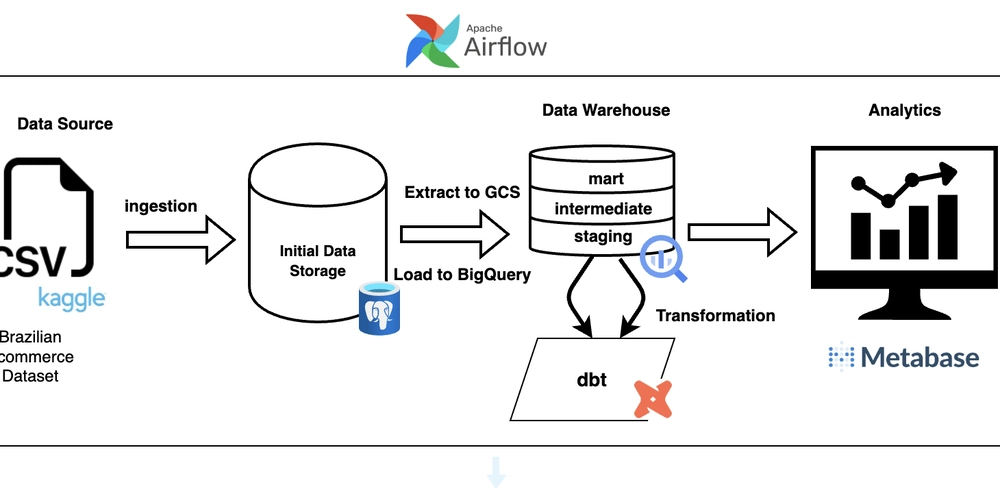

ETL/ELT项目不仅涉及数据迁移,还需设计高效、可扩展的管道。本文分享了使用PostgreSQL、Airflow、BigQuery和dbt构建ELT过程的经验,包括数据处理、自动化、转换和可视化的步骤,以及在处理大数据集和文档编写中的经验教训。

🎯

关键要点

- ETL/ELT项目不仅涉及数据迁移,还需设计高效、可扩展的管道。

- 使用的技术栈包括PostgreSQL、Airflow、BigQuery和dbt。

- 数据来源为巴西电子商务数据集(CSV文件),存储在PostgreSQL中。

- 使用Airflow自动化ETL工作流,确保数据的自动化和可靠移动。

- dbt用于数据转换,模型分为三个阶段:清洗原始数据、连接和重塑、分析最终表。

- 在Metabase中构建仪表板以获取洞察,强调数据结构的重要性。

- 处理大数据集时需考虑性能,避免盲目加载数据。

- dbt在数据转换中具有重要作用,支持模块化转换和自动化测试。

- 文档编写是项目的重要组成部分,清晰的文档使项目可重用。

- 项目增强了问题解决能力、耐心和适应不同工具的能力。

❓

延伸问答

ELT管道的构建涉及哪些主要步骤?

ELT管道的构建主要包括数据摄取、数据编排、数据转换和数据可视化四个步骤。

在这个项目中使用了哪些技术栈?

项目中使用的技术栈包括PostgreSQL、Airflow、BigQuery和dbt。

如何使用Airflow自动化ETL工作流?

使用Airflow创建DAGs,将数据从PostgreSQL移动到BigQuery,确保数据的自动化和可靠移动。

dbt在数据转换中有什么重要作用?

dbt用于模块化数据转换,支持清洗、连接和重塑数据,并提供自动化测试以确保数据完整性。

在处理大数据集时需要注意什么?

处理大数据集时需考虑性能,避免盲目加载数据,建议探索分区、索引或使用其他存储格式如Parquet。

为什么文档编写在项目中很重要?

文档编写使项目可重用,提供清晰的步骤说明,方便未来的维护和理解。

🏷️

标签

➡️