💡

原文中文,约1900字,阅读约需5分钟。

📝

内容提要

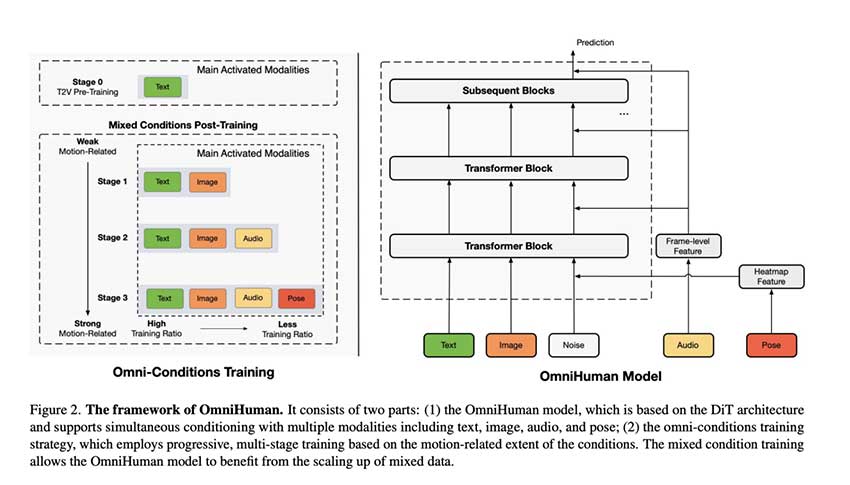

OmniHuman-1是字节跳动推出的基于扩散变换器的AI模型,能够从单一图像生成逼真的人体动画。该模型结合多模态输入,支持音频和视频驱动,适应不同身体比例,提升动作真实感,克服了传统模型的局限性,表现出色,标志着AI人体动画的重大进步。

🎯

关键要点

- OmniHuman-1是字节跳动推出的基于扩散变换器的AI模型,能够从单一图像生成逼真的人体动画。

- 现有模型在动作逼真度、适应性和可扩展性方面存在限制,难以生成流畅的肢体动作。

- OmniHuman-1结合多模态输入,支持音频和视频驱动,适应不同身体比例,提升动作真实感。

- 该模型采用扩散变换器架构,整合多种运动相关条件,增强视频生成能力。

- OmniHuman-1支持多种形式的动作输入,包括音频驱动、视频驱动和多模态融合。

- 模型在多个指标上表现出色,如唇语同步精度、Fréchet Video Distance和手势表现力。

- OmniHuman-1能够适应不同的身体比例和长宽比,具有明显优势。

- 该模型拓宽了创意应用领域,支持卡通、风格化和拟人化的角色动画。

- OmniHuman-1代表了人工智能驱动的人体动画的重大进步,为虚拟影响者、数字化身和游戏开发提供了重要工具。

❓

延伸问答

OmniHuman-1是什么类型的AI模型?

OmniHuman-1是字节跳动推出的基于扩散变换器的AI模型,能够从单一图像生成逼真的人体动画。

OmniHuman-1如何提升动作真实感?

OmniHuman-1结合多模态输入,支持音频和视频驱动,适应不同身体比例,从而提升动作真实感。

OmniHuman-1与传统模型相比有什么优势?

OmniHuman-1在动作逼真度、适应性和可扩展性方面具有明显优势,能够生成流畅的肢体动作。

OmniHuman-1支持哪些类型的动作输入?

OmniHuman-1支持音频驱动、视频驱动和多模态融合的动作输入。

OmniHuman-1在性能测试中表现如何?

OmniHuman-1在唇语同步精度、Fréchet Video Distance和手势表现力等多个指标上表现出色。

OmniHuman-1的应用领域有哪些?

OmniHuman-1可用于虚拟影响者、数字化身、游戏开发和人工智能辅助电影制作等领域。

🏷️

标签

➡️