内容提要

以色列理工学院的研究团队提出了一种名为 Task Tokens 的方法,旨在高效适配行为基础模型(BFM)到特定任务。该方法通过减少可训练参数和提高收敛速度,保持了模型的灵活性和泛化能力。实验表明,Task Tokens 在多种任务中表现优异,尤其在应对环境变化时展现出更强的鲁棒性。

关键要点

-

以色列理工学院的研究团队提出了一种名为 Task Tokens 的方法,旨在高效适配行为基础模型(BFM)到特定任务。

-

Task Tokens 方法通过减少可训练参数和提高收敛速度,保持了模型的灵活性和泛化能力。

-

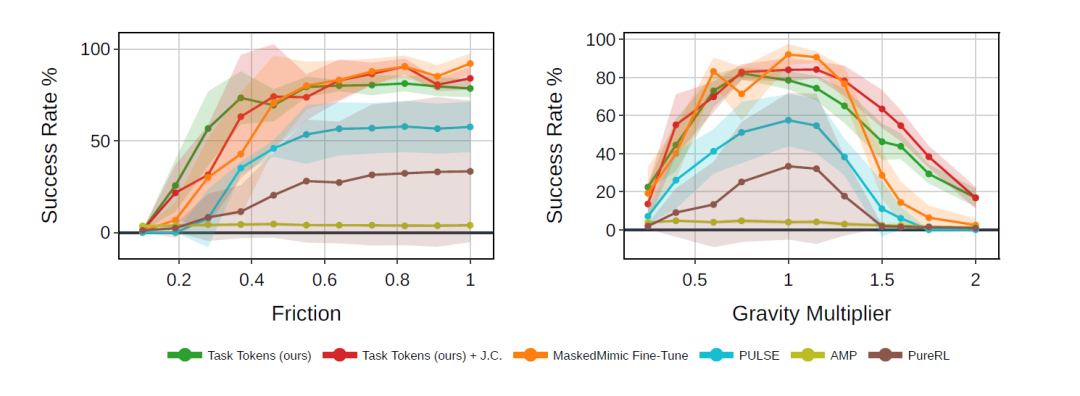

实验表明,Task Tokens 在多种任务中表现优异,尤其在应对环境变化时展现出更强的鲁棒性。

-

Task Tokens 通过 tokenized control 将 MaskedMimic(GC-BFM)适配到特定任务,无需微调基础模型,同时保留其零样本能力。

-

研究人员为每一个新任务训练一个专用的任务编码器,以生成对应的专属 Tokens 表示,增强模型的能力。

-

Task Tokens 在训练过程中仅需约 200K 参数,而其他方法需要更多参数,显示出其高效性。

-

在分布外扰动条件下,Task Tokens 展现出显著增强的鲁棒性,优于其他基线方法。

-

Task Tokens 在效率、动作质量与鲁棒性之间实现了较好的平衡,适合多模态提示的协同效果。

延伸问答

Task Tokens 方法的主要目标是什么?

Task Tokens 方法旨在高效适配行为基础模型(BFM)到特定任务,同时减少可训练参数和提高收敛速度。

Task Tokens 如何提高模型的鲁棒性?

Task Tokens 在应对环境变化时展现出更强的鲁棒性,尤其在分布外扰动条件下表现优于其他基线方法。

使用 Task Tokens 方法的优势是什么?

Task Tokens 方法在训练过程中仅需约 200K 参数,相比其他方法减少了高达 125 倍的可训练参数,显示出其高效性。

Task Tokens 如何适配到特定任务?

Task Tokens 通过 tokenized control 将 MaskedMimic(GC-BFM)适配到特定任务,无需微调基础模型,同时保留其零样本能力。

Task Tokens 在训练过程中表现如何?

Task Tokens 在训练过程中大约在 5000 万步内即可收敛,而其他方法如 PULSE 需要约 3 亿步才能达到相同性能。

Task Tokens 方法的未来研究方向是什么?

未来研究将探索 Task Tokens 在更广泛的 GC-BFM 架构中的通用性,并解决仿真到现实的问题。