💡

原文英文,约3600词,阅读约需13分钟。

📝

内容提要

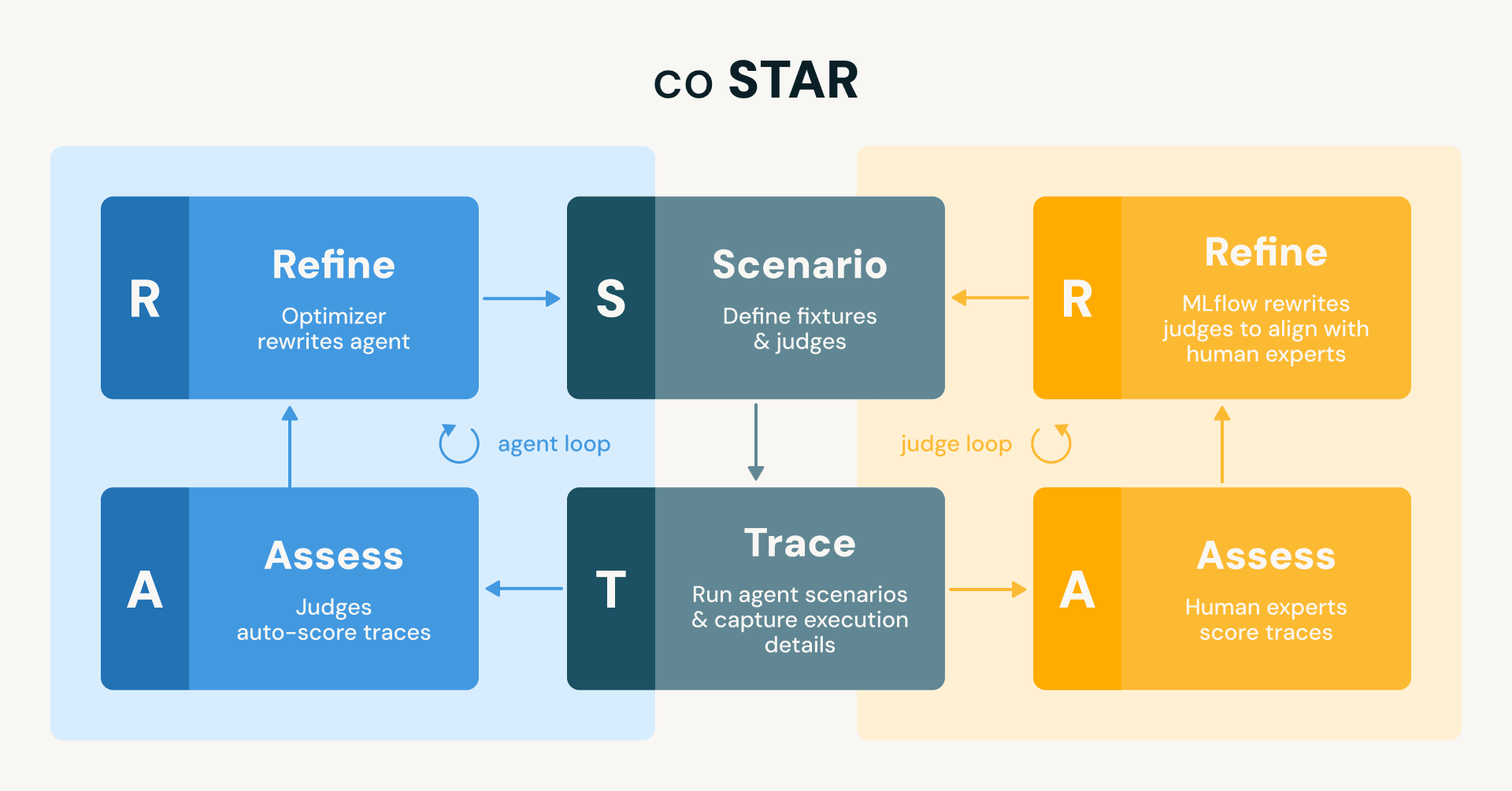

在Databricks,我们开发了coSTAR框架,通过自动化测试和专家评估优化代码助手,解决无测试编码问题,确保代码质量与可靠性。该框架利用场景定义、追踪捕获和评估机制,持续提升代理性能和开发效率。

🎯

关键要点

-

Databricks开发了coSTAR框架,通过自动化测试和专家评估优化代码助手,解决无测试编码问题。

-

coSTAR框架利用场景定义、追踪捕获和评估机制,持续提升代理性能和开发效率。

-

早期开发循环缺乏全面的自动化测试套件,导致代码质量不可靠。

-

coSTAR框架运行两个相互关联的循环:一个与人类专家判断对齐,另一个使用这些可信的判断自动优化代理。

-

场景定义作为测试夹具,追踪捕获记录每次执行的详细信息。

-

评估环节使用代理评估者,判断代理输出的有效性和质量。

-

测试套件随着时间的推移不断演变,初始检查逐渐扩展到更复杂的验证。

-

judge alignment确保评估者与人类专家的判断一致,以提高测试的可靠性。

-

代理的优化过程依赖于评估者的反馈,自动化迭代节省了人工分析的时间。

-

测试不仅限于代理本身,还包括外部工具和基础设施的回归测试。

-

在生产环境中监控代理的表现,及时发现潜在问题。

-

目前的挑战包括场景生成的手动性、评估者对齐的成本和多步骤失败的归因困难。

-

关键要点是:代理开发需要自动化评估,使用工具而非追踪,测试评估者的有效性,建立完整的coSTAR循环。

➡️