💡

原文英文,约3900词,阅读约需15分钟。

📝

内容提要

代理AI系统面临独特的安全挑战,LLM的安全弱点在于无法有效区分指令与数据,增加了敏感数据泄露的风险。为降低风险,应限制对敏感数据的访问,避免不可信内容和外部通信。建议在受控环境中运行LLM,并将任务分解,以确保每个子任务能防范至少一种风险。

🎯

关键要点

- 代理AI系统面临独特的安全挑战,LLM的安全弱点在于无法有效区分指令与数据。

- LLM可能会读取隐藏的指令,从而导致敏感数据泄露的风险。

- 建议在受控环境中运行LLM,并将任务分解,以确保每个子任务能防范至少一种风险。

- 代理AI系统提供了新的软件构建方式,但也带来了严重的安全风险。

- 目前尚无安全的代理AI系统,任何在对抗环境中工作的AI都可能受到提示注入攻击。

- 需要通过研究文章来识别对现代LLM工具有深刻理解的专家,并关注潜在的风险。

- LLM的基本架构是处理文本,而代理架构则扩展了基本模型,增加了内部逻辑和子代理。

- MCP服务器是专为LLM使用设计的API,提供多种功能。

- 一旦允许应用程序执行任意命令,阻止特定任务变得非常困难。

- LLM无法区分内容和指令,可能会执行未授权的命令。

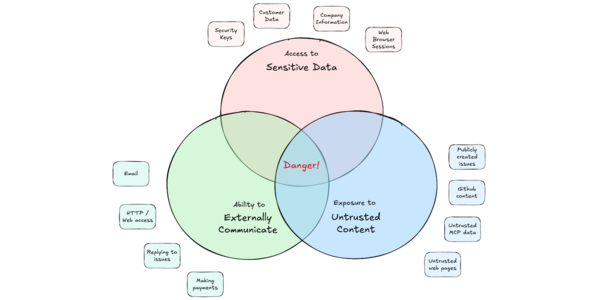

- Simon Willison提出的致命三重奏包括:访问敏感数据、接触不可信内容和外部通信。

- 降低风险的第一步是消除这三种因素中的一个,限制对敏感数据的访问。

- 避免使用可以读取敏感数据的MCP服务器,限制对不可信内容的访问。

- 使用沙箱环境运行LLM应用程序,以控制其访问权限。

- 将LLM应用程序运行在容器中,可以精确锁定其对系统资源的访问。

- 将工作分解为多个阶段,每个阶段只使用三重奏中的一部分,以降低风险。

- 在每个LLM阶段中保持人类参与,确保输出的准确性和安全性。

❓

延伸问答

代理AI系统面临哪些安全挑战?

代理AI系统面临的安全挑战包括无法有效区分指令与数据,导致敏感数据泄露的风险,以及可能受到提示注入攻击的威胁。

如何降低代理AI系统的安全风险?

降低风险的措施包括限制对敏感数据的访问、避免不可信内容和外部通信,以及在受控环境中运行LLM。

什么是致命三重奏,它对代理AI有什么影响?

致命三重奏指的是访问敏感数据、接触不可信内容和外部通信的组合,这三者同时存在时,代理AI面临更高的攻击风险。

LLM在处理文本时存在哪些基本问题?

LLM无法区分内容和指令,可能会执行未授权的命令,这使得它们在处理文本时存在安全隐患。

如何在受控环境中运行LLM以提高安全性?

可以通过使用沙箱环境或容器来运行LLM,从而精确控制其对系统资源的访问,降低安全风险。

为什么需要在LLM的每个阶段保持人类参与?

保持人类参与可以确保输出的准确性和安全性,帮助识别潜在的错误和安全隐患。

➡️