💡

原文中文,约1100字,阅读约需3分钟。

📝

内容提要

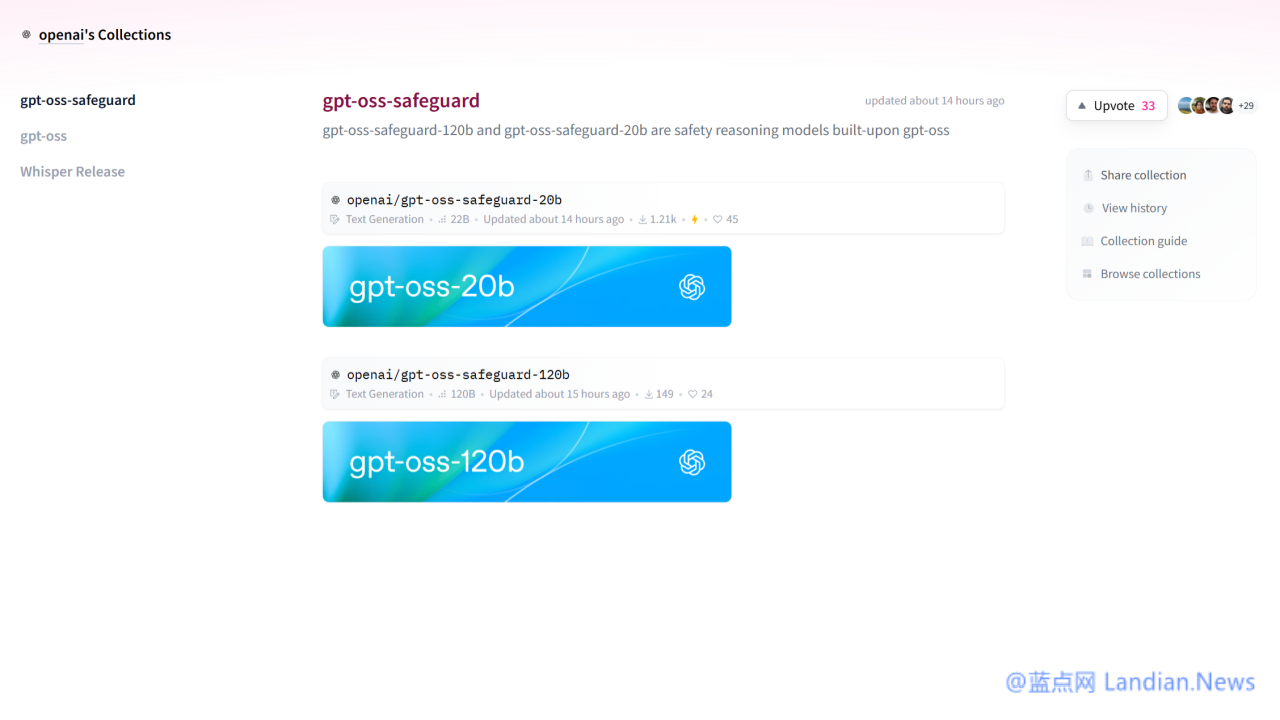

OpenAI 发布了以安全为中心的开源模型 GPT-OSS-SafeGuard-20B/120B,主要用于内容安全分类。开发者可根据需求调整安全边界,模型支持实时解读安全策略。尽管在某些场景下表现良好,但处理复杂问题时传统分类器可能更优。该模型采用 Apache 2.0 许可证,允许自由使用和修改。

🎯

关键要点

- OpenAI 发布了以安全为中心的开源模型 GPT-OSS-SafeGuard-20B/120B,主要用于内容安全分类。

- 该模型采用 Apache 2.0 许可证,允许自由使用和修改。

- 开发者可以根据需求设置不同的安全边界,灵活调整安全策略。

- 模型支持实时解读安全策略,适用于用户消息和聊天记录的安全分类。

- 在处理复杂问题时,传统分类器可能优于 SafeGuard 模型。

- SafeGuard 模型运行速度较慢且资源消耗较大,难以在大平台上广泛应用。

- 开发者可以下载模型以进行使用和修改。

❓

延伸问答

GPT-OSS-SafeGuard模型的主要用途是什么?

该模型主要用于内容安全分类。

开发者如何设置GPT-OSS-SafeGuard的安全边界?

开发者可以根据需求灵活调整安全边界,设置不同的安全策略。

GPT-OSS-SafeGuard模型的许可证是什么?

该模型采用Apache 2.0许可证,允许自由使用和修改。

使用GPT-OSS-SafeGuard模型时有哪些性能限制?

模型运行速度较慢且资源消耗较大,难以在大平台上广泛应用。

在什么情况下传统分类器可能优于SafeGuard模型?

在处理复杂或高风险问题时,传统分类器可能更优。

GPT-OSS-SafeGuard模型支持哪些输入?

模型可以同时接收安全策略和待分类的内容作为输入。

➡️