💡

原文中文,约7100字,阅读约需17分钟。

📝

内容提要

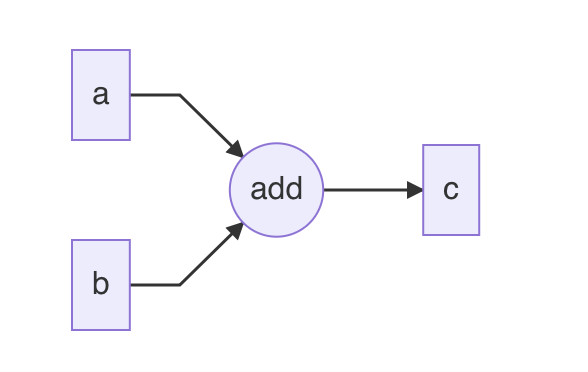

本文探讨了Tensor在使用过程中导致的内存和显存泄漏问题。通过复现代码,分析了不同模型和数据量对泄漏速度的影响,发现Tensor的requires_grad属性会导致额外的AutogradMeta信息被保存,从而引发内存泄漏。理解这一机制有助于算法工程师解决相关问题。

🎯

关键要点

- 本文探讨了Tensor在使用过程中导致的内存和显存泄漏问题。

- 不同模型和数据量对内存泄漏的速度有显著影响。

- Tensor的requires_grad属性会导致额外的AutogradMeta信息被保存,从而引发内存泄漏。

- 通过复现代码,发现内存泄漏的现象与Tensor的运算方式密切相关。

- 在Tensor的requires_grad为True时,每次运算都会保存AutogradMeta信息,导致内存占用增加。

- 增加数据量会使得同一模型在更早的epoch达到内存泄漏的临界点。

❓

延伸问答

Tensor的requires_grad属性如何导致内存泄漏?

当Tensor的requires_grad为True时,每次运算都会保存AutogradMeta信息,导致内存占用增加,从而引发内存泄漏。

不同模型对内存泄漏的影响是什么?

不同模型的内存泄漏速度不同,主要是因为模型的损失函数数量不同,导致内存泄漏的速度也有所差异。

增加数据量会如何影响内存泄漏?

增加数据量会使得同一模型在更早的epoch达到内存泄漏的临界点,因为每个epoch内的迭代次数增多。

如何复现Tensor的内存泄漏问题?

可以通过创建一个固定数据的dataloader并不断训练,观察内存和显存的变化来复现内存泄漏问题。

Tensor在GPU上为何也会导致内存泄漏?

虽然Tensor的数据存储在GPU上,但Tensor的其他信息(如shape和stride)也占用CPU内存,因此会导致内存泄漏。

如何避免Tensor的内存泄漏?

可以通过将Tensor的requires_grad设置为False,或者在运算后使用detach()来避免内存泄漏。

🏷️

标签

➡️