内容提要

Gemma 3 是 Google DeepMind 推出的开放模型系列,旨在解决 AI 部署中的计算资源和安全性问题。它支持多语言和图像处理,具备高效的上下文窗口和硬件兼容性,适合不同开发者使用。

关键要点

-

人工智能领域面临计算资源和安全性挑战,限制了小型组织和个人开发者的使用。

-

Google DeepMind 推出了 Gemma 3,旨在解决这些挑战,支持多种模型大小和预训练变体。

-

Gemma 3 在效率和可移植性方面表现出色,能够在中等硬件上快速运行。

-

支持多模式和多语言功能,能够处理文本和图像,适用于全球多样化受众。

-

拥有扩展的上下文窗口,适合处理大量信息的任务。

-

采用先进的训练技术,结合人类反馈的强化学习,确保模型响应与用户期望一致。

-

针对不同计算环境进行了硬件兼容性优化,降低了高级 AI 应用程序的部署成本和复杂性。

-

早期评估表明,Gemma 3 在其尺寸类别中表现可靠,能够有效处理文本和视觉数据。

-

Gemma 3 强调开放、可访问的人工智能,提供强大性能的同时确保安全使用。

-

允许开发人员将复杂的语言和视觉功能集成到各种应用程序中,重视可访问性和负责任的使用。

延伸问答

Gemma 3 的主要目标是什么?

Gemma 3 的主要目标是解决 AI 部署中的计算资源和安全性问题,提供高效的多模态开放模型。

Gemma 3 支持哪些功能?

Gemma 3 支持多语言和图像处理,能够处理文本和视觉内容,适用于140多种语言。

Gemma 3 在硬件兼容性方面有什么优势?

Gemma 3 针对 NVIDIA GPU 和 Google Cloud TPU 进行了优化,适应不同计算环境,降低了高级 AI 应用程序的部署成本和复杂性。

Gemma 3 的上下文窗口有多大?

Gemma 3 拥有扩展的上下文窗口,最大可达128,000个token,适合处理大量信息的任务。

Gemma 3 如何确保模型的安全性?

Gemma 3 采用了先进的训练技术,结合人类反馈的强化学习,确保模型响应与用户期望一致,同时保持安全性。

Gemma 3 的早期评估结果如何?

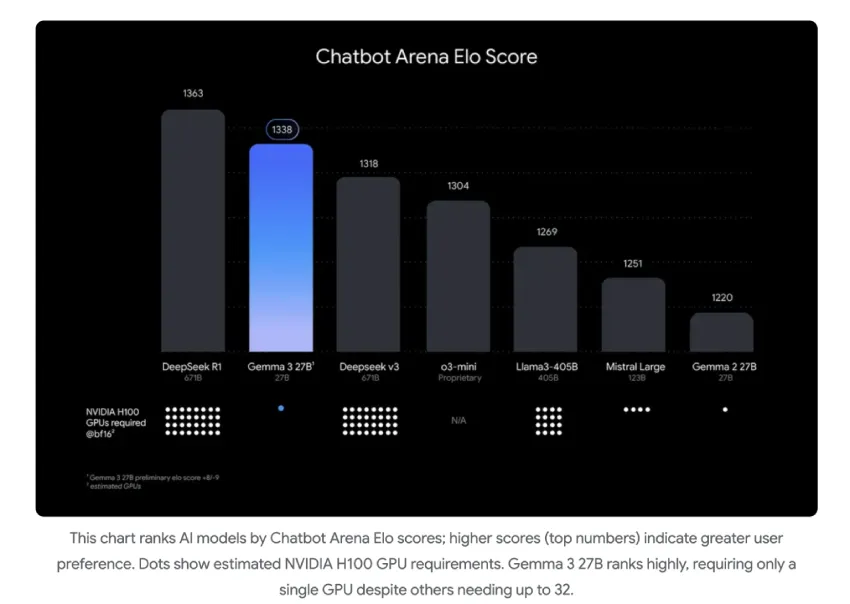

早期评估表明,Gemma 3 在其尺寸类别中表现可靠,能够有效处理文本和视觉数据,27B 变体在相关排行榜上获得了1338分。