💡

原文中文,约2700字,阅读约需7分钟。

📝

内容提要

过去八年,Transformer架构深刻影响了人工智能研究,广泛应用于自然语言处理和计算机视觉等领域。工业界和高校在规模化与理论研究方面不断推进,研究呈现出高度分化与快速演进。HyperAI超神经官网推出“最新论文”板块,推荐了五篇关于Transformer的热门论文,展示了多个研究团队的创新成果。

🎯

关键要点

- 过去八年,Transformer架构重塑了人工智能研究,广泛应用于自然语言处理和计算机视觉等领域。

- Google、OpenAI、Meta、Microsoft等工业界推动Transformer的规模化与工程化,斯坦福、MIT、伯克利等高校在理论分析和结构改进上持续贡献。

- Transformer领域的研究呈现高度分化与快速演进,系统性梳理与精选代表性论文变得尤为必要。

- HyperAI超神经官网推出‘最新论文’板块,推荐了五篇关于Transformer的热门论文。

- 论文推荐1:Engram模型通过可扩展条件记忆模块提升推理任务性能。

- 论文推荐2:STEM架构通过静态稀疏结构提升长上下文性能。

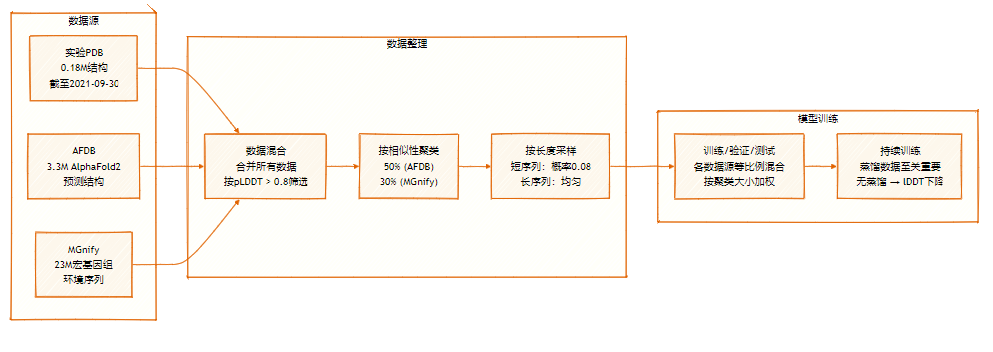

- 论文推荐3:SeedFold模型通过线性三角注意力机制提升生物分子结构预测能力。

- 论文推荐4:研究表明Transformer在时序预测中的有效性需重新评估。

- 论文推荐5:推理模型通过模拟‘思想社会’提升推理性能,强调多样性与角色协调的重要性。

- 欢迎研究团队向HyperAI投稿高质量成果及论文。

❓

延伸问答

Transformer架构在人工智能研究中有哪些影响?

Transformer架构重塑了人工智能研究,广泛应用于自然语言处理和计算机视觉等领域。

哪些机构在Transformer的研究中发挥了重要作用?

Google、OpenAI、Meta、Microsoft等工业界,以及斯坦福、MIT、伯克利等高校在Transformer研究中发挥了重要作用。

HyperAI超神经官网提供了哪些关于Transformer的论文推荐?

HyperAI推荐了五篇关于Transformer的热门论文,涵盖了不同研究团队的创新成果。

Engram模型的主要贡献是什么?

Engram模型通过可扩展条件记忆模块提升推理任务性能,显著提高了多种任务的表现。

STEM架构如何提升长上下文性能?

STEM架构通过静态稀疏结构和可扩展的参数激活来提升长上下文性能。

为什么需要重新评估Transformer在时序预测中的有效性?

研究发现,Transformer的自注意力机制可能损失关键时间信息,简单模型在时序预测中表现更好。

➡️