💡

原文中文,约6300字,阅读约需15分钟。

📝

内容提要

本文介绍了基于Spark的中风数据处理和分析,包括数据清洗预处理、Spark SQL和Spark MLlib的数据分析和机器学习建模,以及使用逻辑回归、决策树和随机森林等算法进行中风预测,解决数据不平衡问题的SMOTE算法,使用ECharts进行可视化,通过Flask构建简单的Web界面实现中风预测功能。

🎯

关键要点

- 中风是全球第二大死亡原因,数据分析和预测模型对早期预警和预防具有重要意义。

- 实验环境包括Linux虚拟机、Python、Hadoop和Spark等。

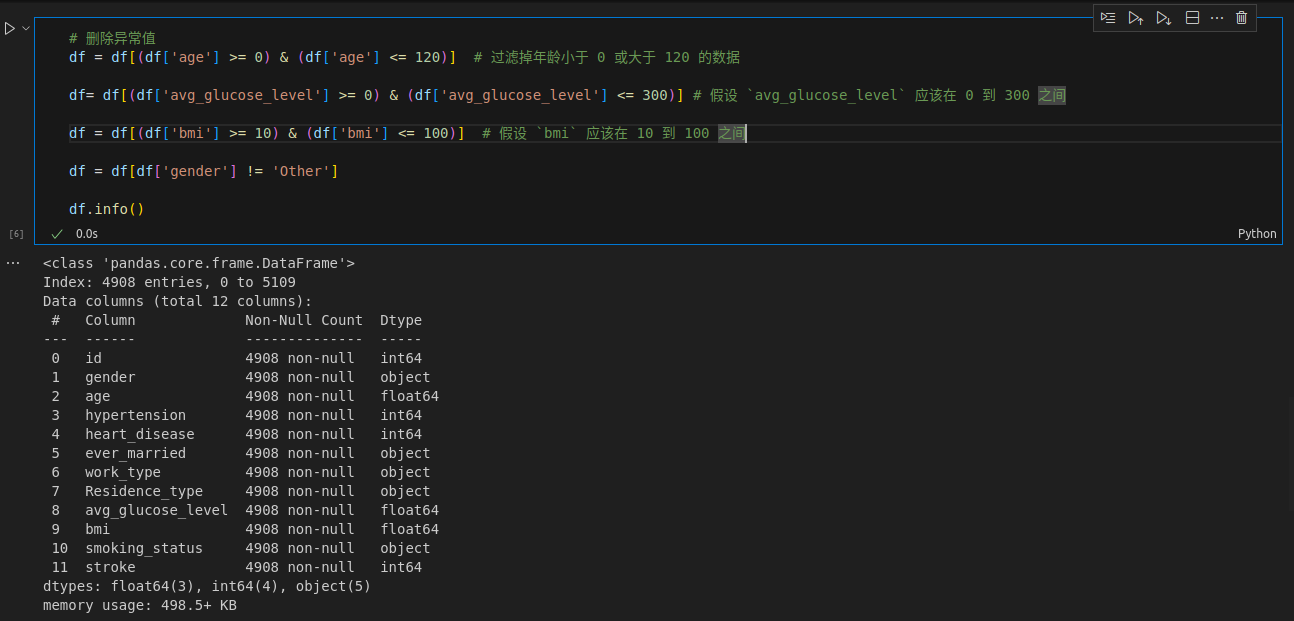

- 数据预处理包括数据集预览、清洗、删除缺失值、重复值和异常值,最终保存为新的csv文件。

- 使用HDFS进行数据的伪分布式存储。

- 基于Spark SQL进行数据分析,统计各字段中风与非中风人数,比较不同人群的BMI和平均血糖水平分布。

- 使用Spark MLlib进行机器学习建模,采用逻辑回归、决策树和随机森林算法进行中风预测,并使用SMOTE算法解决数据不平衡问题。

- 通过相关性分析发现年龄、高血压、心脏病、BMI和平均血糖水平与中风有较强相关性。

- 使用Flask和ECharts进行数据可视化,展示各字段中风人数、BMI分布、平均血糖水平等。

- 构建Web界面实现中风预测功能,用户可输入参数并获取预测结果。

- 总结实验流程,强调数据预处理、分析、建模和可视化的重要性。

❓

延伸问答

中风数据处理的实验目的是什么?

实验目的是通过数据分析和预测模型进行中风的早期预警和预防,提升中风预测的准确性。

在中风数据分析中使用了哪些机器学习算法?

使用了逻辑回归、决策树和随机森林三种机器学习算法进行中风预测。

如何解决中风数据中的不平衡问题?

采用SMOTE算法进行过采样,以平衡中风和非中风样本的数量。

数据预处理的主要步骤有哪些?

主要步骤包括数据集预览、清洗、删除缺失值、重复值和异常值,最后保存为新的csv文件。

如何使用Flask实现中风预测功能?

通过Flask构建Web界面,用户输入参数后,后端利用训练好的模型进行中风预测并返回结果。

中风与哪些因素有较强的相关性?

中风与年龄、高血压、心脏病、BMI和平均血糖水平有较强相关性。

➡️