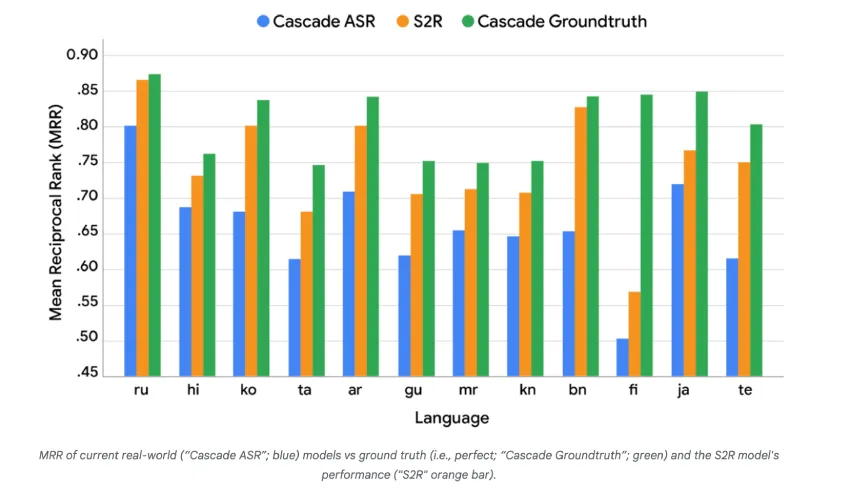

RAG重排序解析:更好的上下文,更好的答案

meilisearch blog

·

在增强检索生成(RAG)语义缓存中减少假阳性:银行案例研究

InfoQ

·

通过Mobile-VideoGPT的创新框架解锁实时视频分析!

DEV Community

·

延迟交互模型,为什么是下一代RAG的标配?

机器之心

·