通过WebSocket加速响应API中的智能工作流程

OpenAI

·

通往响应迅速的基于IntelliJ的IDE之路

The JetBrains Blog

·

GPT-5.3 Instant 系统卡

OpenAI

·

使用Valkey加速应用程序的指南:缓存数据库查询和会话

Percona Database Performance Blog

·

如何降低大型语言模型令牌成本并加快AI应用速度

Redis Blog

·

更多的安全工具正在拖慢您的事件响应速度

The New Stack

·

面向更快、更智能LLM应用的语义缓存

Redis Blog

·

Gemini 3 Flash来了,为Gemini应用带来了‘巨大的’升级

The Verge

·

自动提示缓存加速代理响应

Heroku

·

砖石布局:你将不再需要库的东西

Articles on Smashing Magazine — For Web Designers And Developers

·

提升响应速度,守护生命安全——天气预警API

APISpace

·

如何压缩提示以降低大型语言模型的成本

freeCodeCamp.org

·

人工智能驱动的安全自动化投资回报:重要指标

The New Stack

·

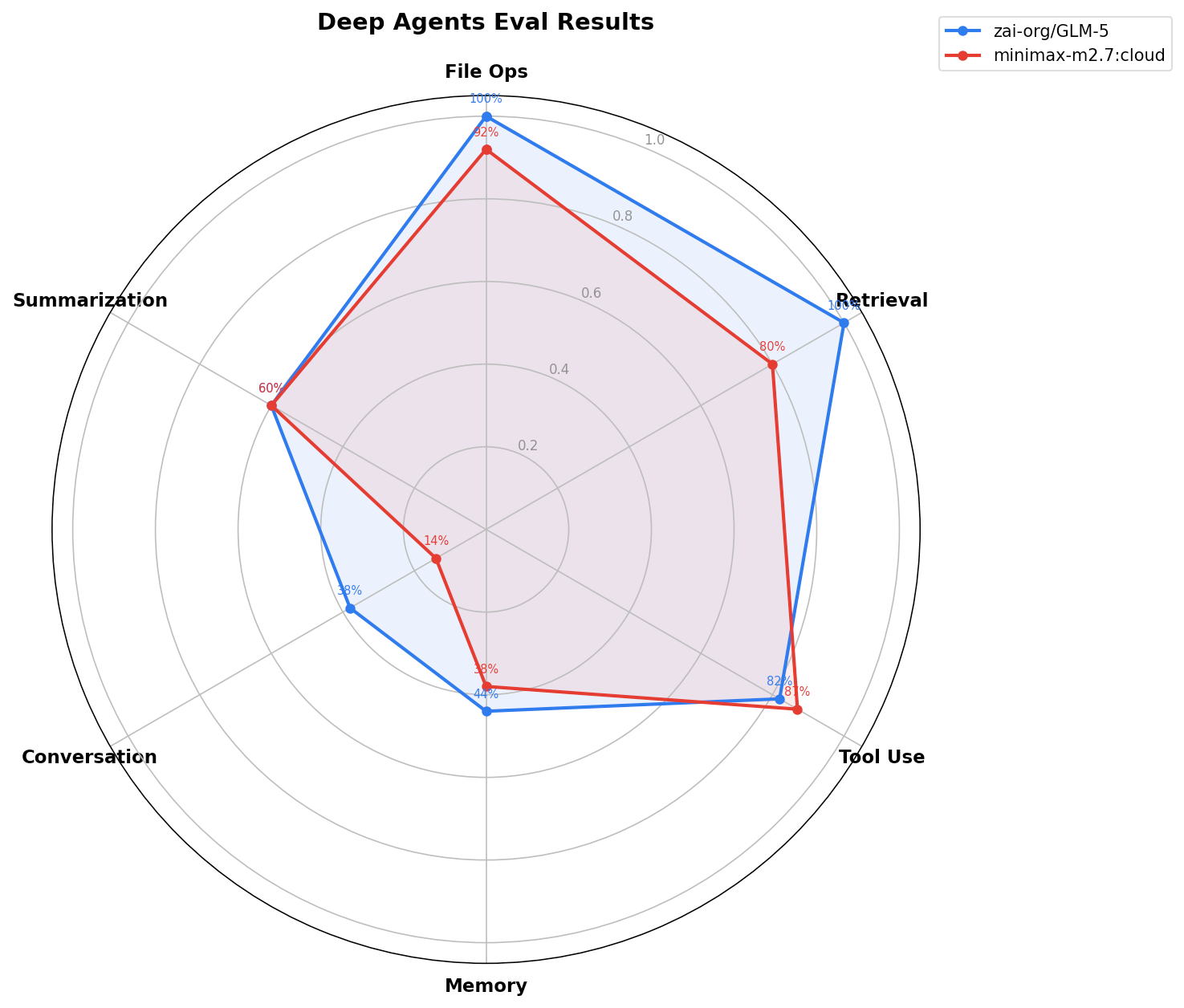

.png)

美国国防和情报部门是时候提升端点安全了

Elastic Blog - Elasticsearch, Kibana, and ELK Stack

·

介绍Copilot自动模型选择功能(预览)

Visual Studio Blog

·

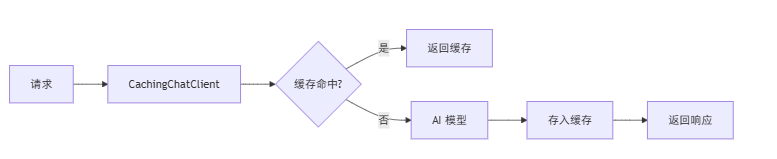

.NET+AI | MEAI | 会话缓存(5)

dotNET跨平台

·