内容提要

会话缓存机制通过 Microsoft.Extensions.AI 提升 AI 应用响应速度 10-100 倍,降低 API 成本,支持流式与非流式响应,适用于 FAQ 系统和文档查询等场景。

关键要点

-

会话缓存机制通过 Microsoft.Extensions.AI 提升 AI 应用响应速度 10-100 倍。

-

缓存机制显著降低 API 成本,支持流式与非流式响应。

-

核心价值包括成本优化、性能飞跃和全场景支持。

-

在生产环境中,API 调用存在高成本和延迟问题。

-

典型应用场景包括 FAQ 系统、文档查询和批量处理。

-

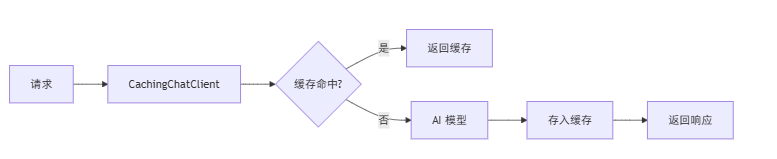

关键组件包括 CachingChatClient 和 DistributedCachingChatClient。

-

快速开始需要安装依赖包并启用缓存。

-

缓存效果验证显示首次请求与缓存命中响应时间差异显著。

-

流式响应缓存支持通过 CoalesceStreamingUpdates 控制行为。

-

生产环境推荐使用 Redis 作为缓存存储。

-

缓存键分区管理可通过 CacheKeyAdditionalValues 创建独立缓存分区。

-

企业级最佳实践包括自定义缓存策略和识别何时不应使用缓存。

-

FAQ 客服系统示例展示了缓存的实际效果和成本节省。

-

注意事项包括 JSON 序列化限制和缓存版本管理。

-

总结强调简单集成、显著收益和灵活配置。

延伸问答

会话缓存机制如何提升 AI 应用的响应速度?

会话缓存机制通过智能存储和复用 AI 响应,将响应速度提升至 10-100 倍。

使用会话缓存机制有哪些典型应用场景?

典型应用场景包括 FAQ 系统、文档查询和批量处理。

如何在生产环境中实现会话缓存?

在生产环境中,推荐使用 Redis 作为缓存存储,并通过简单的代码启用缓存。

会话缓存机制如何降低 API 成本?

通过避免重复 API 调用,直接返回缓存结果,从而显著降低 API 成本。

会话缓存机制的核心组件有哪些?

核心组件包括 CachingChatClient 和 DistributedCachingChatClient。

在使用会话缓存时需要注意哪些事项?

注意事项包括 JSON 序列化限制和缓存版本管理,确保兼容性。