💡

原文英文,约1500词,阅读约需6分钟。

📝

内容提要

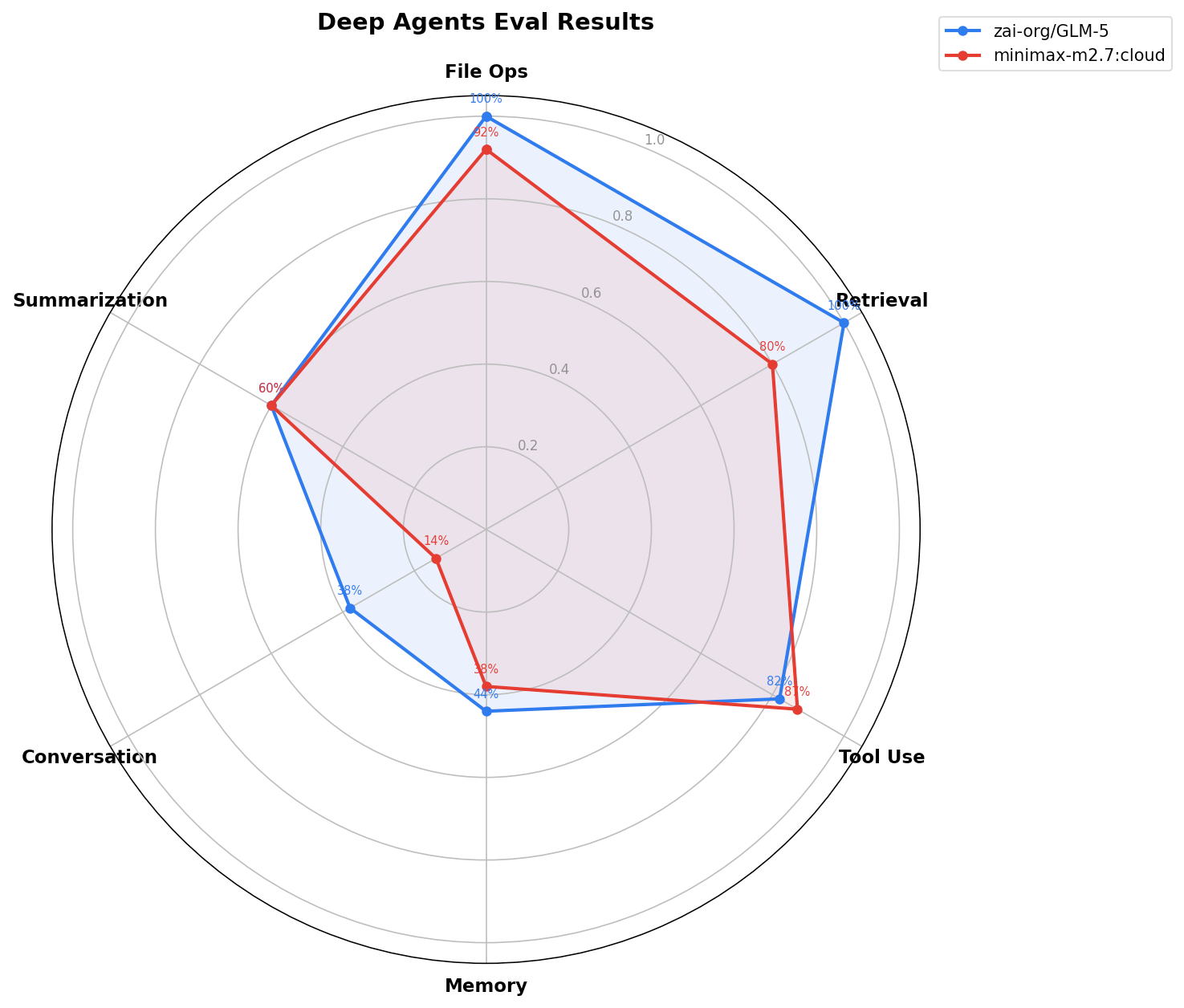

开放模型如GLM-5和MiniMax M2.7在核心任务上与封闭模型相当,且成本和延迟更低。评估显示,开放模型在文件操作、工具使用和指令跟随等方面表现良好,适合生产环境,成为开发者的理想选择。

🎯

关键要点

- 开放模型如GLM-5和MiniMax M2.7在核心任务上与封闭模型相当,且成本和延迟更低。

- 开放模型在文件操作、工具使用和指令跟随等方面表现良好,适合生产环境。

- 开放模型的成本显著低于封闭模型,例如MiniMax M2.7的每日成本约为12美元,而封闭模型如Opus 4.6约为250美元。

- 开放模型通常较小,能够在专用推理基础设施上加速,提供更低的延迟。

- 评估显示开放模型在多个任务类别中表现出色,包括文件操作、工具使用和对话等。

- 开发者可以通过简单的代码更改在Deep Agents中使用开放模型,支持多种提供商。

- Deep Agents CLI支持运行时模型切换,允许在会话中根据需要更换模型。

❓

延伸问答

开放模型与封闭模型相比有哪些优势?

开放模型在核心任务上与封闭模型相当,但成本和延迟更低,适合生产环境。

MiniMax M2.7的使用成本是多少?

MiniMax M2.7的每日成本约为12美元。

开放模型在文件操作和工具使用方面的表现如何?

开放模型在文件操作、工具使用和指令跟随等方面表现良好,适合实际应用。

如何在Deep Agents中使用开放模型?

只需简单的代码更改即可在Deep Agents中使用开放模型,例如使用`create_deep_agent`函数。

开放模型的延迟表现如何?

开放模型通常较小,能够在专用推理基础设施上加速,提供更低的延迟。

Deep Agents CLI支持哪些功能?

Deep Agents CLI支持运行时模型切换,允许在会话中根据需要更换模型。

🏷️

标签

➡️