微软最新的Phi-4推理模型认为,规模并非一切

The New Stack

·

一个小型自回归程序合成系统,支持受控实验

Apple Machine Learning Research

·

你无法解雇一个机器人:关于AI生成内容和你工作的直言不讳的真相

The New Stack

·

演讲:语言人工智能的生态与经济实践

InfoQ

·

JavaScript库在浏览器中运行机器学习模型

The New Stack

·

为什么红帽认为人工智能的未来是小型语言模型

The New Stack

·

DeepSeek推出后,移动端AI风向要变

机器之心

·

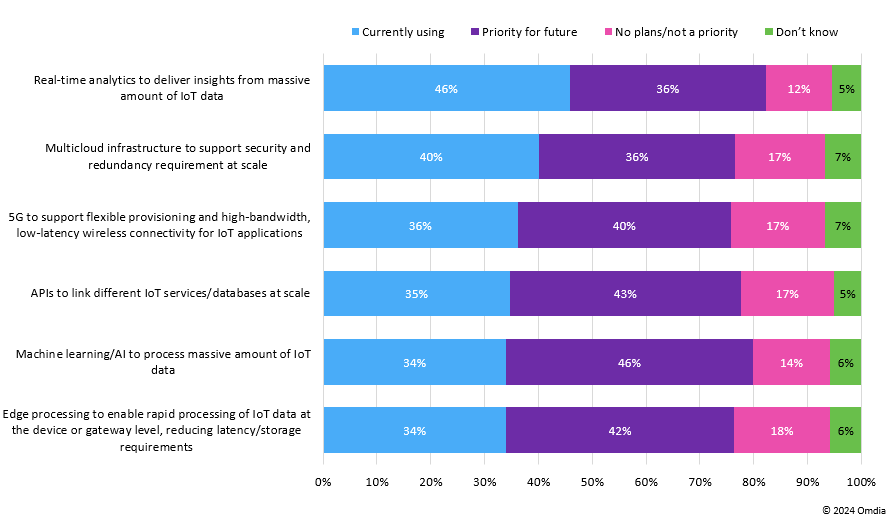

DeepSeek 对边缘 AIoT 的影响

实时互动网

·

开源人工智能已经开始投入生产

The GitHub Blog

·

从大型语言模型提炼细粒度情感理解

BriefGPT - AI 论文速递

·